Google hat heute die Einführung einer aktualisierten Gemini-Modellreihe angekündigt, darunter Gemini-1.5-Pro-002 und Gemini-1.5-Flash-002. Dieses Update bietet nicht nur eine deutliche Leistungssteigerung, sondern auch überraschend günstige Preise und wird die AI-Entwicklungswelt sicherlich aufmischen.

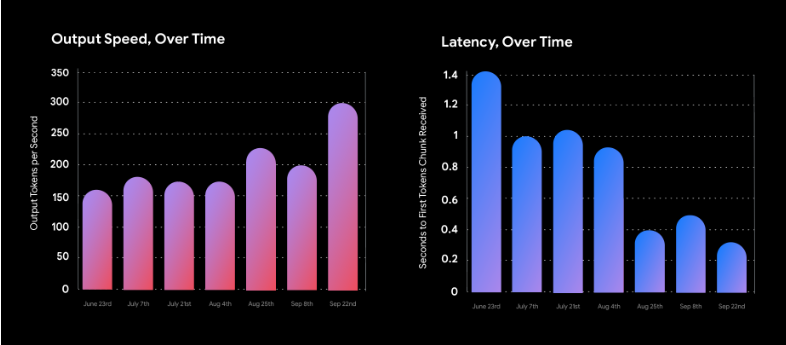

Am auffälligsten ist die massive Preissenkung. Die Nutzungskosten der neuen Modelle wurden halbiert – eine Reduktion von über 50 %. Gleichzeitig wurde die Leistung erheblich verbessert. Die Verarbeitungsgeschwindigkeit von Gemini 1.5 Flash hat sich verdoppelt, während die von 1.5 Pro sich fast verdreifacht hat. Dies bedeutet für Entwickler schnellere Ergebnisse, kürzere Wartezeiten und höhere Effizienz bei geringeren Kosten.

Die neuen Gemini-Modelle zeigen eine umfassende Leistungssteigerung, insbesondere in Mathematik, der Verarbeitung langer Texte und visuellen Aufgaben. So können die Modelle jetzt problemlos PDFs mit über 1000 Seiten verarbeiten, Fragen zu zehntausenden Codezeilen beantworten und sogar nützliche Informationen aus einstündigen Videos extrahieren. Im anspruchsvollen MMLU-Pro-Benchmark erzielten die neuen Modelle eine Leistungssteigerung von etwa 7 %. Besonders beeindruckend sind die Verbesserungen bei MATH und HiddenMath mit einer Steigerung von bis zu 20 %.

Google hat auch die Qualität der Modellantworten optimiert. Die neuen Versionen liefern hilfreichere und prägnantere Antworten bei gleichzeitiger Gewährleistung der inhaltlichen Sicherheit. Bei Aufgaben wie Zusammenfassungen, Fragen und Antworten sowie Informationsgewinnung wurden die Ausgaben um 5 % bis 20 % verkürzt, was die Effizienz steigert und die Kosten weiter senkt.

Für Unternehmen bietet die Fähigkeit von Gemini 1.5 Pro zur Verarbeitung langer Texte (bis zu 2 Millionen Wörter) und seine Multimodalität ganz neue Anwendungsmöglichkeiten. Ab dem 1. Oktober 2024 werden die Preise für Input-Tokens, Output-Tokens und Incremental-Cache-Tokens um 64 %, 52 % bzw. 64 % gesenkt, was die Kosten für die Nutzung von KI für Unternehmen deutlich reduziert.

Auch bei den Nutzungsbeschränkungen hat Google erhebliche Anpassungen vorgenommen. Die Ratenbegrenzung für die kostenpflichtige Nutzung von Gemini 1.5 Flash wurde auf 2000 Anfragen pro Minute erhöht, die von 1.5 Pro auf 1000 Anfragen. Dies bietet Entwicklern mehr Flexibilität.

Sicherheit ist für Google nach wie vor ein Schwerpunkt. Die neuen Modelle wurden unter Beibehaltung der Benutzeranweisungen in Bezug auf die Sicherheit weiter verbessert. Google hat auch die Standardfiltereinstellungen angepasst und Entwicklern mehr Autonomie eingeräumt.

Zusätzlich hat Google ein verbessertes Gemini 1.5 Flash-8B-Experimentalmodell vorgestellt, das in Text- und Multimodalanwendungen hervorragende Ergebnisse liefert. Diese Version ist bereits in Google AI Studio und der Gemini API verfügbar und bietet Entwicklern mehr Auswahlmöglichkeiten.

Gemini Advanced-Nutzer können bald die speziell für Chats optimierte Version Gemini 1.5 Pro-002 nutzen.