Google hat am Freitagmorgen offiziell das neue Edge-Modell Gemma3n mit mehreren Modi veröffentlicht und geöffnet. Dieses wegweisende Produkt bringt starke multimodale Funktionen auf Endgeräten wie Smartphones, Tablets und Laptops, die bislang nur in der Cloud verfügbar waren.

Kernmerkmale: Kleiner Umfang, große Leistung

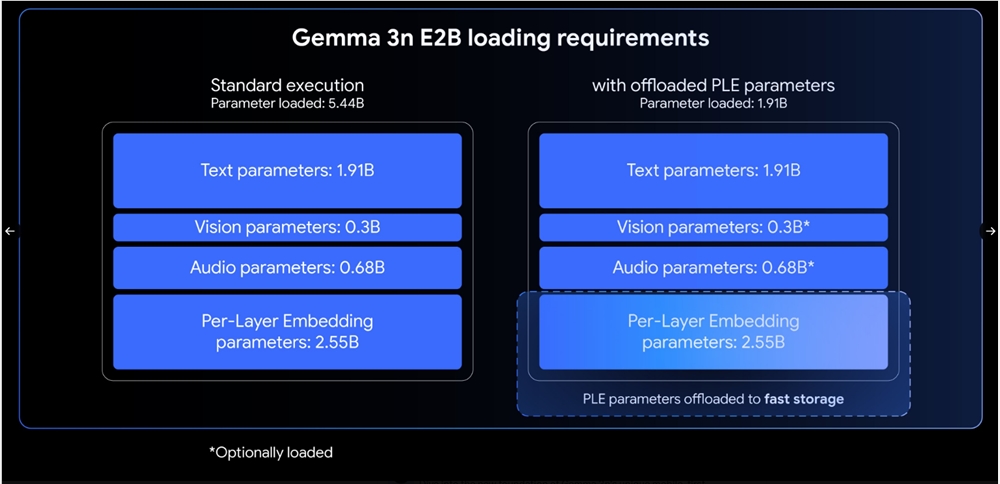

Gemma3n bietet zwei Versionen: E2B und E4B. Obwohl die ursprüngliche Anzahl der Parameter 5B und 8B beträgt, reduziert durch Architekturinnovationen der Speicherbedarf auf etwa 2B und 4B-Modelle. Es benötigt jeweils nur 2 GB und 3 GB RAM, um zu laufen. Das Modell unterstützt nativ mehrere multimodale Eingaben wie Bilder, Audio, Video und Text und versteht 140 Textsprachen sowie 35 Sprachen für multimodale Inhalte.

Interessanterweise erreichte die E4B-Version bei den Bewertungen von LMArena über 1300 Punkte und wurde zum ersten Modell unter 100 Milliarden Parametern, das dieses Niveau erreicht hat. In Bezug auf Mehrsprachigkeit, Mathematik, Codierung und Schlussfolgerung gab es deutliche Verbesserungen.

Technologische Innovationen: Vier wegweisende Architekturen

MatFormer-Architektur: Gemma3n verwendet eine neue Matryoshka Transformer-Architektur, die wie ein russisches Matrjoschka-Puppen-System verschiedene Größen in einem Modell ermöglicht. Während des Trainings des E4B-Modells werden gleichzeitig auch die E2B-Untermodelle optimiert, was Entwicklern flexible Leistungsentscheidungen bietet. Durch die Mix-n-Match-Technologie können Benutzer zwischen E2B und E4B benutzerdefinierte Modellgrößen erstellen.

Pro-Schicht-Einbettung (PLE)-Technologie: Diese Innovation ermöglicht es, die meisten Parameter auf dem CPU zu laden und zu berechnen, wobei nur die Kerne des Transformer-Gewichts im Accelerator-Speicher gespeichert werden müssen. Dies verbessert die Speichereffizienz erheblich, ohne die Modellqualität zu beeinträchtigen.

KV-Cache-Teilung: Für die Verarbeitung langer Inhalte optimiert, verbessert die Technologie der Schlüssel-Wert-Cache-Teilung die Vorbelegungsleistung um das Doppelte im Vergleich zu Gemma34B und beschleunigt signifikant die Erzeugung des ersten Tokens bei langen Sequenzen.

Fortgeschrittener Encoder: Bei der Audioverarbeitung wird ein Encoder basierend auf dem allgemeinen Sprachmodell (USM) eingesetzt, der automatisierte Spracherkennung und Sprachübersetzung unterstützt und bis zu 30 Sekunden lange Audioschnitte verarbeiten kann. Im visuellen Bereich ist ein MobileNet-V5-300M-Encoder vorhanden, der verschiedene Eingangsauflösungen unterstützt und auf Google Pixel eine Verarbeitungsgeschwindigkeit von 60 Bildern pro Sekunde erreicht.

Praktische Funktionen und Anwendungsfälle

Gemma3n zeigt herausragende Leistungen in der Sprachübersetzung, insbesondere bei der Umwandlung zwischen Englisch und Spanisch, Französisch, Italienisch und Portugiesisch. Der visuelle Encoder MobileNet-V5 erreicht durch fortschrittliche Verdampfungstechnik eine 13-fache Beschleunigung gegenüber dem Basismodell, reduziert die Parameter um 46 % und den Speicherbedarf um das Vierfache, während die Genauigkeit höher bleibt.

Open-Source-Ökosystem und Zukunftsperspektiven

Google hat das Modell und die Gewichte auf der Plattform Hugging Face geöffnet und bietet detaillierte Dokumentation und Entwicklungsanleitungen an. Seit der Veröffentlichung des ersten Gemma-Modells letztes Jahr betrug die kumulative Download-Zahl der Serie bereits über 160 Millionen Mal, was auf ein starkes Entwicklerökosystem hinweist.

Die Veröffentlichung von Gemma3n markiert eine neue Phase in der Entwicklung von Edge-KI und senkt die multimodalen Fähigkeiten der Cloud auf die Endgeräte der Nutzer, wodurch unzählige Möglichkeiten für mobile Anwendungen und intelligente Geräte entstehen.