マイクロソフトは最近、Windowsオペレーティングシステム向けの大規模言語モデルOmniParserのアップグレード版であるOmniParser-v2.0を発表しました。このモデルはデスクトップとウィンドウの要素を認識し、それらと対話できるため、AIエージェント技術がパソコンの完全自動化に向けて大きく前進したことを示しています。

OmniParser-v2.0の重要な機能は、デスクトップ環境の認識と対話能力です。つまり、このモデルと連携することで、AIエージェントはユーザーの指示を理解するだけでなく、特定のウィンドウを開く、ボタンの位置を特定してクリックする、テキストを入力するなど、Windowsオペレーティングシステムレベルで直接操作を実行できます。

注目すべきは、OmniParser-v2.0がDeepSeek-R1などの他のモデルと連携できる点です。この拡張性により、より強力で柔軟なAIエージェントの構築が可能になります。

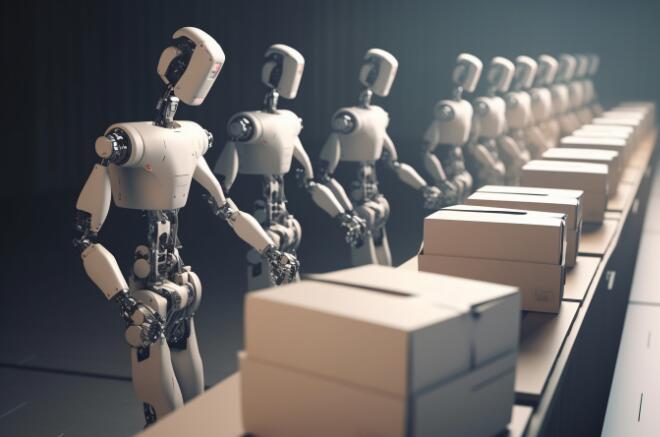

業界関係者は、OmniParser-v2.0などのツールの登場により、AIエージェントの下流ツールチェーンがますます充実しつつあると指摘しています。ブラウザの操作からオペレーティングシステムの操作まで、AIエージェントの能力範囲は拡大を続け、今後AIが自動化されたオフィスワークやパーソナルアシスタントなどの分野で大きな役割を果たすことを示唆しています。私たちは、AIによって推進される、よりスマートで効率的なコンピューティング時代へと着実に近づいています。