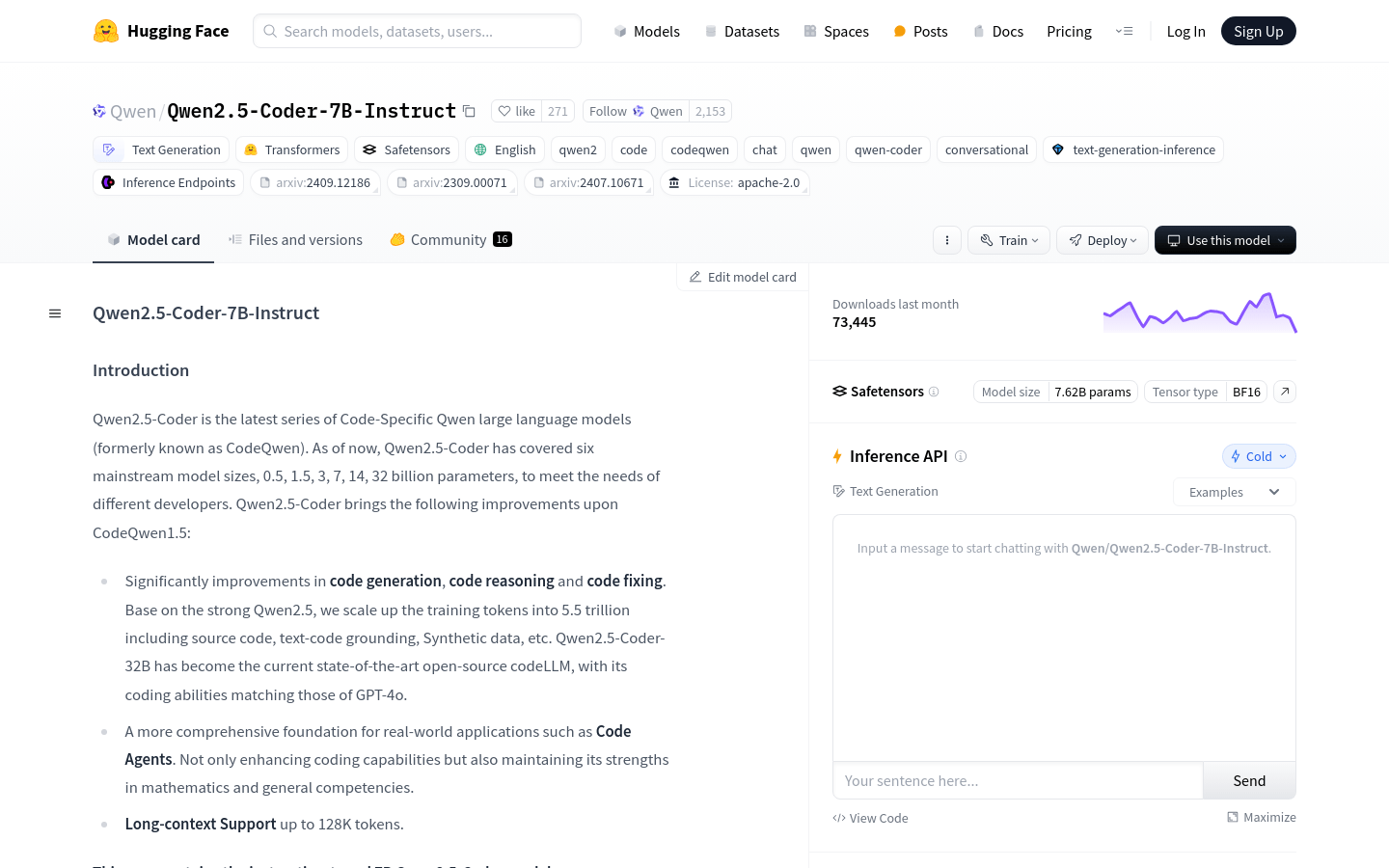

Qwen2.5-Coder-7B-Instruct

Ein 7B-Parameter-Sprachmodell zur Codegenerierung

Qwen2.5-Coder-7B-Instruct Neueste Verkehrssituation

Monatliche Gesamtbesuche

25296546

Absprungrate

43.31%

Durchschnittliche Seiten pro Besuch

5.8

Durchschnittliche Besuchsdauer

00:04:45