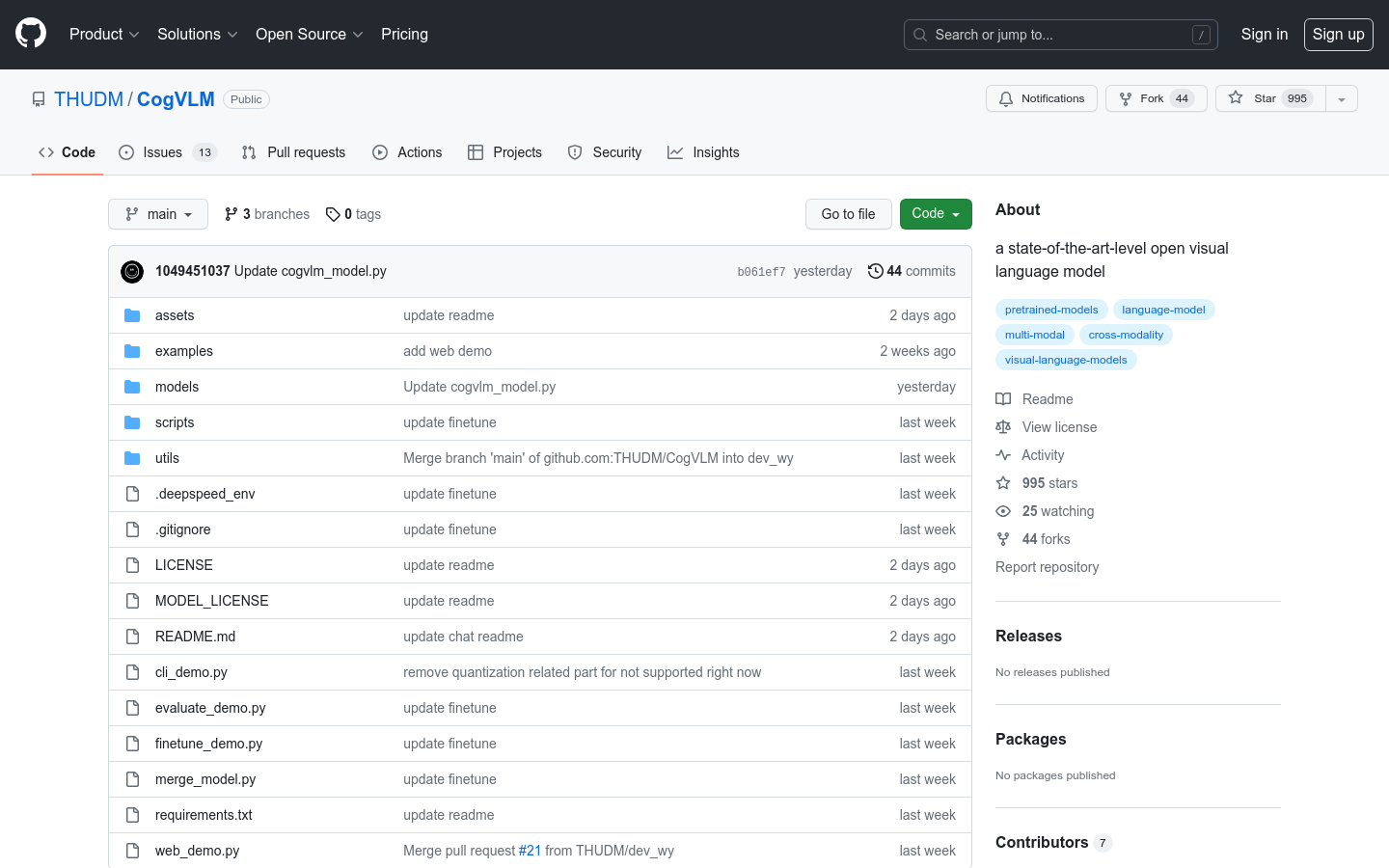

CogVLM

Modelo de linguagem visual de código aberto poderoso

CogVLM Situação do Tráfego Mais Recente

Total de Visitas Mensais

492133528

Taxa de Rejeição

36.20%

Média de Páginas por Visita

6.1

Duração Média da Visita

00:06:33

CogVLM Tendência de Visitas

CogVLM Distribuição Geográfica das Visitas

Sem Dados de Distribuição Geográfica