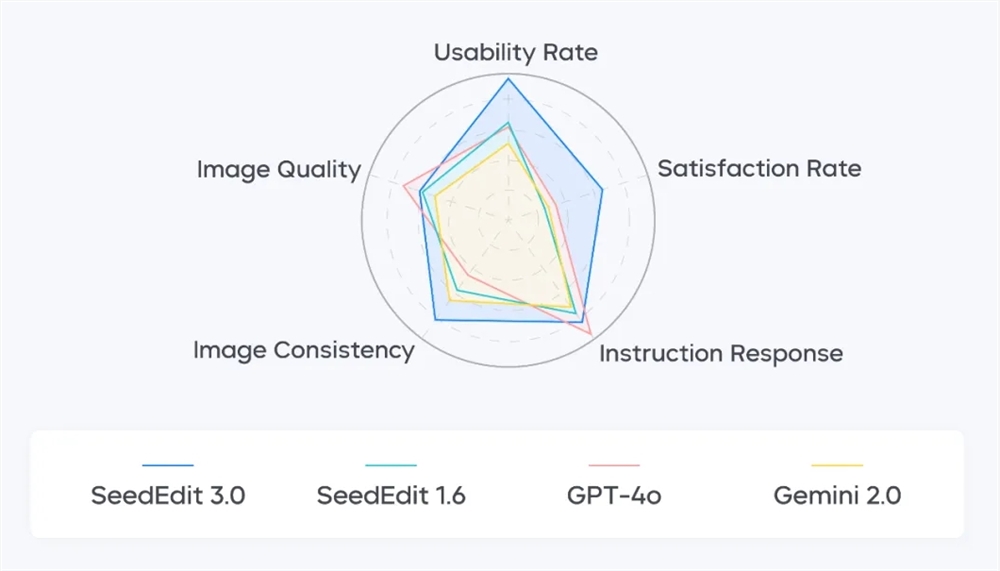

El 6 de junio, el equipo Seed de ByteDance lanzó oficialmente el modelo de edición de imágenes SeedEdit3.0. Esta nueva versión del modelo de edición de imágenes ha logrado avances significativos en la conservación del sujeto de la imagen, el procesamiento de detalles de fondo y el cumplimiento de instrucciones, lo que ha mejorado considerablemente la utilidad y eficiencia de la edición de imágenes.

SeedEdit3.0 se desarrolló basándose en el modelo generativo de texto a imagen Seedream3.0, introduciendo métodos diversos de fusión de datos y modelos específicos de recompensas para resolver las deficiencias anteriores de los modelos de edición de imágenes en términos de conservación del sujeto y el fondo, y el cumplimiento de instrucciones. Este modelo puede manejar e generar imágenes con una resolución de 4K, destacando en el procesamiento detallado de la región editada y la alta fidelidad de la conservación de la región no editada. En particular, en escenarios complejos como la edición de retratos, el cambio de fondo, la conversión de perspectiva y luz, SeedEdit3.0 muestra una capacidad excepcional.

Por ejemplo, en la tarea de eliminar personas innecesarias de las imágenes, SeedEdit3.0 no solo puede identificar y eliminar personas irrelevantes con precisión, sino que también puede eliminar sus sombras, mostrando una gran capacidad para el procesamiento de detalles. En la tarea de convertir dibujos 2D en modelos de pasarela, el modelo puede mantener bien los detalles de vestimenta y accesorios como sombreros y bolsos, generando imágenes que tienen un sentido realista y moderno. Además, SeedEdit3.0 puede manejar transformaciones complejas de luz y sombra, desde las casas cercanas hasta las ondas de agua lejanas, conservando todos los detalles y ajustándolos "pixel a pixel" según los cambios de luz.

Para lograr estas capacidades, el equipo Seed propuso durante el desarrollo una estrategia eficiente de fusión de datos y construyó varios modelos de recompensa especializados. Al entrenar estos modelos de recompensa junto con modelos de difusión, el equipo mejoró específicamente la calidad de edición en tareas clave como alineación facial y renderización de texto. Al mismo tiempo, SeedEdit3.0 también optimizó la aceleración de inferencia, permitiendo una inferencia rápida en aproximadamente 10 segundos.

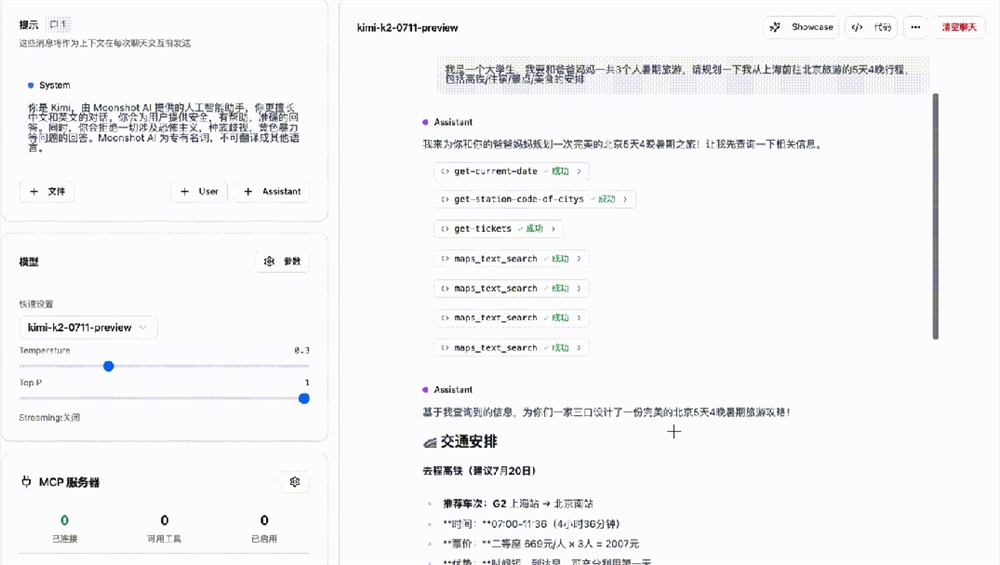

Cuando evaluaron el rendimiento de SeedEdit3.0, el equipo recopiló cientos de imágenes de prueba reales y sintéticas y creó 23 subtareas de edición que incluyen estilos, adiciones, sustituciones, eliminaciones y acciones instruccionales como movimiento de la cámara, desplazamiento de objetos y cambio de escena. Los resultados de las pruebas automáticas muestran que SeedEdit3.0 supera a versiones anteriores y otros modelos similares tanto en efectos de conservación de edición como en la capacidad de respuesta a instrucciones. Los resultados de la evaluación humana también indican que la capacidad de conservación de imágenes de SeedEdit3.0 es destacada, con una utilidad del 56.1%, un aumento significativo con respecto a versiones previas.

El lanzamiento de SeedEdit3.0 marca otro importante avance en la tecnología de edición de imágenes en el campo de la inteligencia artificial. El modelo no solo ha logrado varias innovaciones técnicas, sino que también muestra una alta practicidad y eficiencia en aplicaciones prácticas. Actualmente, el informe técnico de SeedEdit3.0 ya está disponible al público, y el modelo está abierto a pruebas en la plataforma web Jiyimeng y próximamente estará disponible en la aplicación DouBao. Los usuarios pueden experimentar esta potente herramienta de edición de imágenes cargando imágenes de referencia y proporcionando modificaciones a través de Prompt.

Página principal del proyecto:

https://seed.bytedance.com/seededit

Informe técnico:

https://arxiv.org/pdf/2506.05083

Entrada de experiencia:

Plataforma web Jiyimeng - Generación de imágenes - Carga de imagen de referencia - Selección del modelo 3.0 - Ingreso de Prompt de modificación (prueba en gris);

Aplicación DouBao - Generación de imágenes AI - Agregar imagen de referencia - Ingreso de Prompt de modificación (próximamente disponible).