Hunyuan-A13B es un nuevo modelo de lenguaje de gran tamaño abierto por Tencent, que logra un rendimiento poderoso con una escala relativamente pequeña de parámetros activos gracias a su innovadora filosofía de diseño, especialmente adecuado para entornos con recursos limitados.

Este modelo utiliza una arquitectura MoE (Mezcla de Expertos) de grano fino, tiene 13 mil millones de parámetros activos, pero el número total de parámetros alcanza los 800 mil millones. Este diseño le permite mantener la eficiencia y escalabilidad, al mismo tiempo que ofrece capacidades avanzadas de razonamiento y soporte para aplicaciones generales.

Las características principales del Hunyuan-A13B incluyen:

Modo de razonamiento híbrido que admite pensamiento rápido y lento: Este mecanismo de razonamiento único permite al modelo ajustar flexiblemente la profundidad del pensamiento según las necesidades de la tarea, mejorando la eficiencia en el procesamiento de problemas complejos.

Capacidad nativa de comprensión de contexto extremadamente largo (256K): Esto significa que el modelo puede manejar entradas de texto muy largas, destacando en tareas que requieren mucha información de fondo.

Excelente desempeño en tareas de agentes inteligentes: El Hunyuan-A13B demuestra una gran capacidad al realizar diversas tareas relacionadas con agentes (Agent).

Para lograr un razonamiento eficiente, el Hunyuan-A13B utiliza la tecnología Grouped Query Attention (GQA) y admite varios formatos de cuantización. Actualmente, el modelo ya ha abierto el código de preentrenamiento, ajuste de instrucciones, versión FP8 y cuantización INT4, facilitando el uso para desarrolladores.

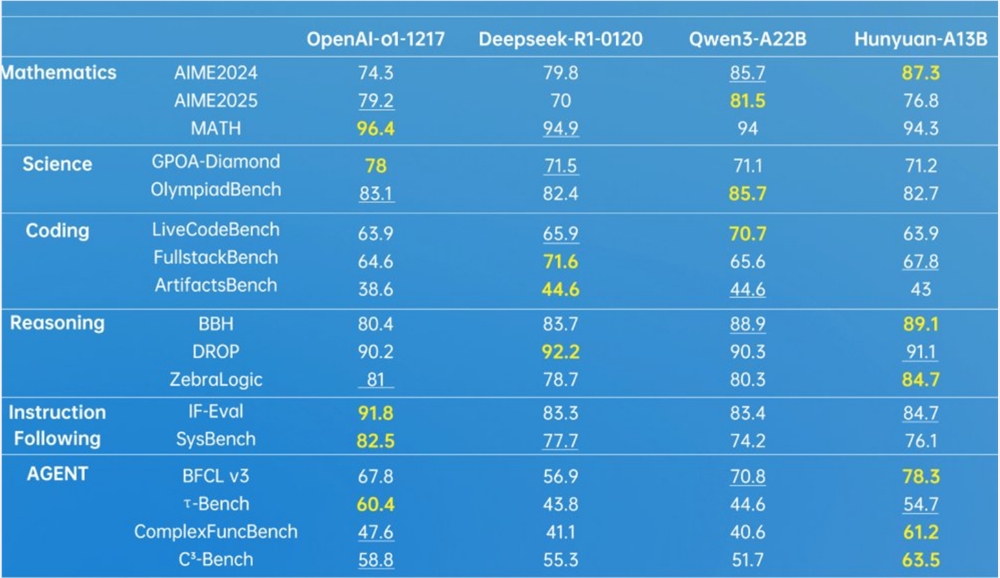

En diversos benchmarks, el Hunyuan-A13B muestra una fuerte competitividad, especialmente en matemáticas, ciencias, programación, razonamiento y tareas de agentes.

Tencent brinda apoyo integral a los desarrolladores, incluyendo guías detalladas para interactuar y entrenar modelos mediante Hugging Face Transformers. Además, para la implementación del modelo, el Hunyuan-A13B también ofrece soporte a través de TensorRT-LLM, vLLM y SGLang, proporcionando imágenes Docker preconstruidas y soluciones de implementación de modelos cuantizados, simplificando significativamente el proceso de implementación.

La apertura del Hunyuan-A13B abre nuevas posibilidades para la aplicación de grandes modelos en entornos con recursos limitados, y también impulsa nuevas fuentes de innovación en la comunidad de IA.

Ubicación del código abierto: https://huggingface.co/tencent/Hunyuan-A13B-Instruct

github: https://github.com/Tencent-Hunyuan/Hunyuan-A13B?tab=readme-ov-file