La empresa china de inteligencia artificial DeepSeek anunció el lanzamiento de DeepGEMM, una biblioteca de código abierto que admite la multiplicación de matrices generales (GEMM) FP8, durante el tercer día de su "Semana del código abierto". Esta herramienta está diseñada para operaciones de matrices intensivas y de expertos mixtos (MoE), proporcionando un potente soporte para el entrenamiento e inferencia de los modelos DeepSeek V3 y R1. El anuncio oficial, realizado a través de la plataforma X, generó una gran respuesta en la comunidad tecnológica.

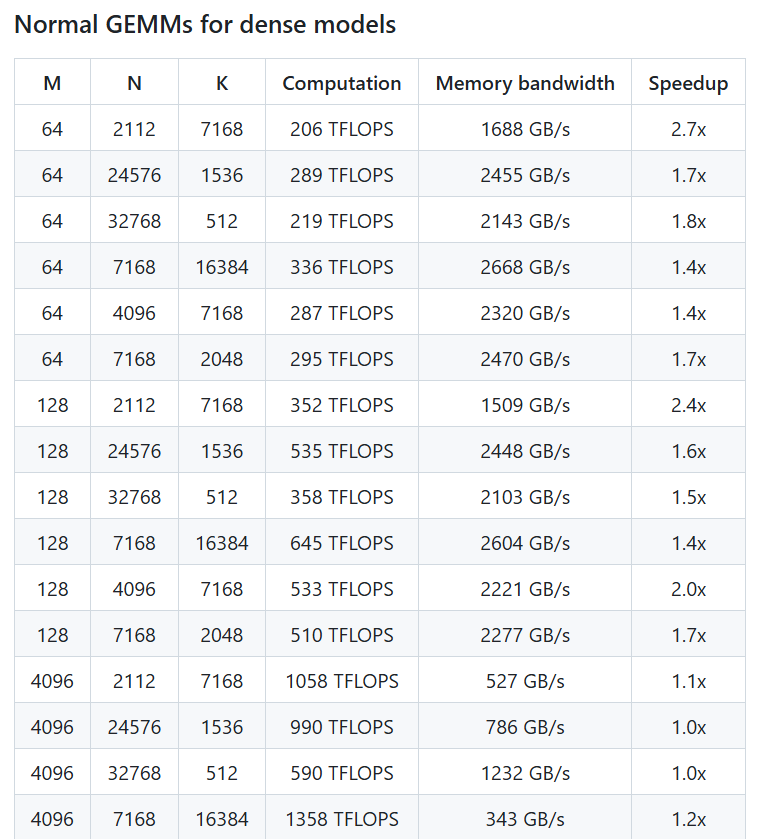

Según la publicación de la cuenta oficial de DeepSeek, DeepGEMM puede alcanzar un rendimiento de cálculo FP8 de más de 1350 TFLOPS en las GPU NVIDIA Hopper. Su lógica central consta de aproximadamente 300 líneas de código, pero supera a los núcleos optimizados por expertos en la mayoría de los tamaños de matrices, demostrando una eficiencia y simplicidad excepcionales. La biblioteca no requiere dependencias complejas, utiliza una técnica de compilación Just-In-Time (JIT), admite diseños densos y dos diseños MoE, y está diseñada con una "limpieza similar a un tutorial", facilitando su aprendizaje y uso.

El usuario de X @TechBitDaily comentó: "El lanzamiento de DeepGEMM es un gran hito en la Semana del código abierto de DeepSeek; su rendimiento FP8 y su diseño sencillo son impresionantes". Otro usuario, @AIObserverCN, señaló que la biblioteca tiene una ventaja significativa en el entrenamiento eficiente de modelos MoE, y que podría impulsar una mayor innovación en la comunidad de IA en la arquitectura Hopper.

Como parte de la Semana del código abierto, el lanzamiento de DeepGEMM continúa con el compromiso de DeepSeek de promover la transparencia de la tecnología de IA y la colaboración comunitaria. En los dos días anteriores, la empresa ya había lanzado las herramientas FlashMLA y DeepEP, centradas en la arquitectura de modelos lingüísticos rápidos y la comunicación paralela de expertos, respectivamente. La presentación de DeepGEMM muestra aún más su capacidad técnica en la construcción de infraestructura de IA. Los expertos del sector opinan que esta biblioteca no solo mejorará el rendimiento de los modelos propios de DeepSeek, sino que también proporcionará a los desarrolladores de todo el mundo una herramienta de cálculo matricial eficiente y fácil de usar, con un futuro prometedor. Los usuarios ya pueden obtener DeepGEMM a través de GitHub para explorar su potencial en el entrenamiento e inferencia de IA.

Dirección del proyecto: https://github.com/deepseek-ai/DeepGEMM