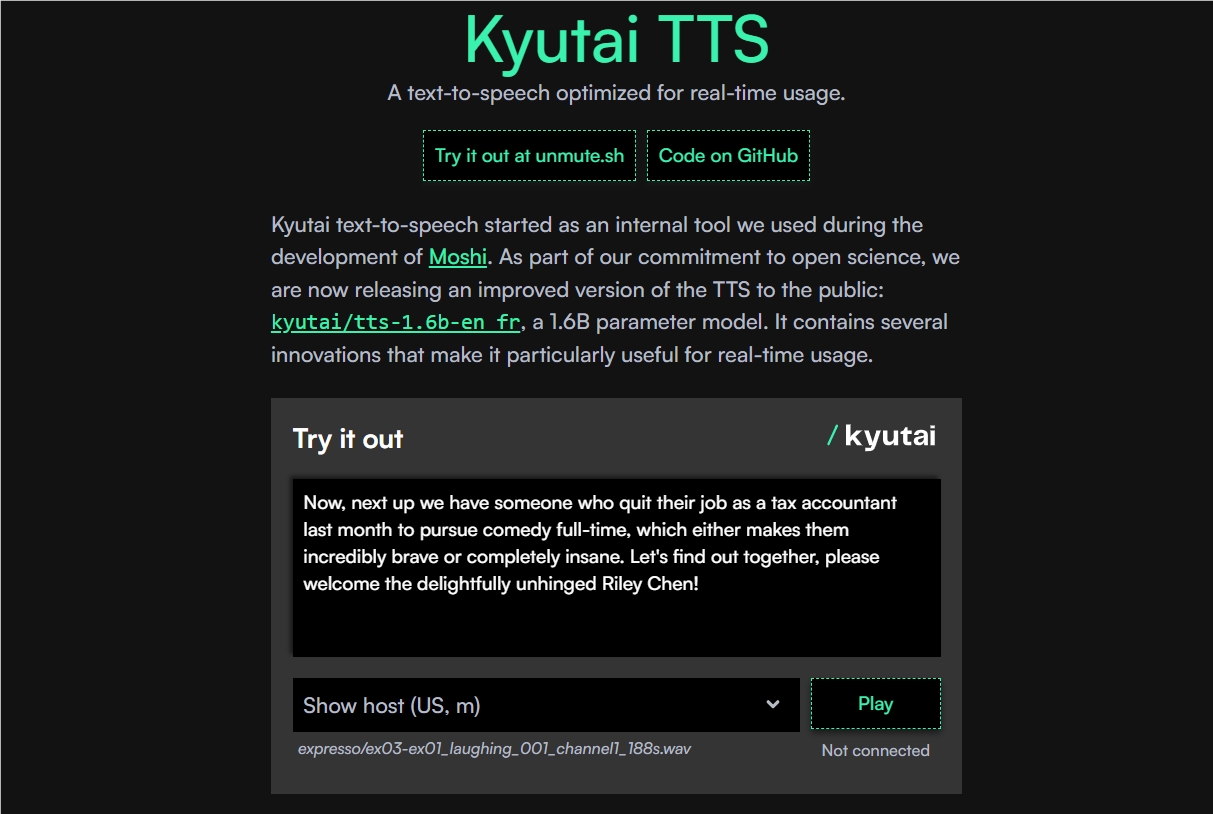

Récemment, le laboratoire français d'IA Kyutai a annoncé que son nouveau modèle de synthèse vocale texte-voix, Kyutai TTS, est désormais open source, offrant aux développeurs et chercheurs du monde entier une solution de synthèse vocale performante et à faible latence. Cette publication révolutionnaire ne seulement favorise le développement des technologies d'IA open source, mais ouvre également de nouvelles possibilités pour les applications d'interactions vocales multilingues. AIbase vous propose une analyse exclusive de cette innovation technologique et de son impact potentiel.

Très faible latence, nouvelle expérience d'interaction en temps réel

Kyutai TTS attire l'attention du secteur grâce à ses performances exceptionnelles. Ce modèle permet le transfert en flux de texte et peut générer rapidement une voix naturelle et fluide. Grâce au soutien puissant de la carte graphique L40S, Kyutai TTS peut traiter jusqu'à 32 demandes simultanément avec une latence aussi basse que 350 millisecondes, offrant ainsi une solide garantie technique pour l'interaction vocale en temps réel. Que ce soit pour des assistants virtuels, la génération de sous-titres en direct ou les plateformes éducatives en ligne, cette caractéristique de très faible latence améliorera significativement l'expérience utilisateur.

Sortie vocale précise, détails soignés

Kyutai TTS excelle non seulement dans la rapidité, mais sa précision dans la génération vocale est également remarquable. Le taux d'erreur de mots (WER) du modèle est respectivement de 2,82 et 3,29 en anglais et en français, démontrant une très haute précision vocale. De plus, la similarité du locuteur atteint 77,1 % en anglais et 78,7 % en français, générant ainsi une voix qui non seulement est naturelle et fluide, mais reproduit également fidèlement les caractéristiques vocales du locuteur cible. En outre, Kyutai TTS peut produire des balises temporelles exactes pour chaque mot, offrant un soutien puissant pour les scénarios nécessitant une synchronisation précise, tels que la génération de sous-titres ou la doublage.

Adresse de l'open source : https://kyutai.org/next/tts

Prise en charge multilingue, nombreuses applications possibles

Actuellement, Kyutai TTS prend en charge deux langues, l'anglais et le français, et peut générer des textes longs en voix. Cela lui confère un grand potentiel d'application dans divers domaines tels que l'éducation, la production médiatique, ou encore la navigation vocale. Par exemple, dans le domaine de l'éducation, Kyutai TTS peut fournir un service de lecture de texte de haute qualité aux personnes aveugles ; dans l'industrie médiatique, sa faible latence et sa voix de haute fidélité peuvent être utilisées pour générer rapidement des podcasts ou des livres audio. À l'avenir, le laboratoire Kyutai prévoit d'élargir davantage la prise en charge linguistique grâce aux contributions de la communauté, renforçant ainsi la capacité d'application mondiale du modèle.

Open source, innovation pilotée par la communauté

En tant que modèle totalement open source, Kyutai TTS est publié sous licence CC-BY-4.0, permettant aux développeurs d'utiliser librement, de modifier et de redistribuer le modèle. Cette stratégie ouverte réduit non seulement les barrières d'accès à la technologie, mais offre également une ressource précieuse à la communauté mondiale d'IA. Le laboratoire Kyutai appelle les utilisateurs de la communauté à contribuer des données vocales pour aider le modèle à ajouter davantage de styles vocaux et de prises en charge linguistiques, collaborant ainsi à l'avancement des technologies de synthèse vocale.

Perspectives futures : une nouvelle étape pour les technologies vocales d'IA