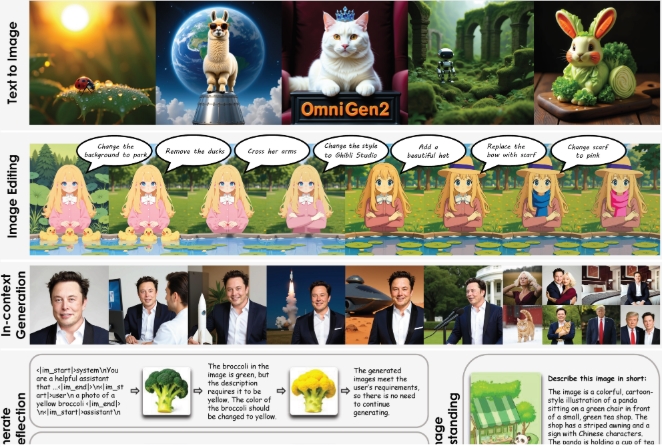

最近、北京人工知能研究院は新しいオープンソースシステム「OmniGen2」をリリースしました。このシステムはテキストから画像生成を行うこと、画像編集およびコンテキスト画像の作成に特化しています。

2024年にリリースされた第一世代のOmniGenと比較して、OmniGen2はテキスト生成用と画像生成用の2つの独立したデコードパスを採用しており、それぞれが独自のパラメータと分離された画像タグジェネレーターを持っています。このような設計により、モデルはテキスト生成能力を維持しながらも、マルチモーダル言語モデルの性能を効果的に向上させています。

OmniGen2のコアは、Qwen2.5-VL-3B変換器に基づく大規模なマルチモーダル言語モデル(MLLM)です。画像生成においては、約40億のパラメータを持つカスタム拡散変換器を使用しています。モデルが特殊な「<|img|>」タグに遭遇すると自動的に画像生成モードに切り替わります。また、OmniGen2はさまざまなプロンプトやアートスタイルに対応できますが、生成される写実的な画像の明瞭度にはまだ改善の余地があります。

OmniGen2のトレーニングには、オープンソースデータセットと専有データセットからの約1億4,000万枚の画像が使用されました。さらに、研究チームは動画内の類似フレーム(例:笑顔と非笑顔の顔)を抽出し、言語モデルを使ってそれに基づいた編集指示を生成するための新技術を開発しました。

OmniGen2のもう一つの大きな特徴は、自己評価機能で、モデルが生成した画像を自ら評価し、複数のラウンドで改善を行えるようにしています。このシステムは生成された画像に含まれる欠点を発見し、具体的な修正案を提案できます。

このシステムの性能を評価するために、研究チームはOmniContextベンチマークテストを導入しました。これはキャラクター、オブジェクト、シーンの3つのカテゴリに分類され、各カテゴリには8つのサブタスクとそれぞれ50個のサンプルが含まれています。評価はGPT-4.1を用いて行われ、主なスコアリング基準にはプロンプトの正確性とテーマの一貫性が含まれます。OmniGen2の総合スコアは7.18で、他のすべてのオープンソースモデルを上回りました。一方、GPT-4oのスコアは8.8でした。

OmniGen2は複数のベンチマークテストで優れた結果を示しましたが、いくつかの課題もあります。英語のプロンプトの方が中国語のプロンプトよりも効果的であり、身体の形態の変化は比較的複雑で、出力品質は入力画像に影響されます。曖昧な複数画像プロンプトに対しては、明確なオブジェクト配置の指示が必要です。

研究チームは、モデル、トレーニングデータ、構築パイプラインをHugging Faceプラットフォームに公開する予定です。

ポイント:

🌟 OmniGen2は、独立したテキストおよび画像デコードパスを備えたオープンソースの画像・テキスト生成システムです。

🎨 さまざまなアートスタイルの画像生成に対応し、自己反省および改善機能を備えています。

📈 OmniGen2は複数のベンチマークテストで優れた性能を発揮し、特に画像編集において新たなオープンソースモデルの記録を樹立しました。