O Google lançou oficialmente e abriu o código-fonte da nova grande modelo multimodal de lado do dispositivo, Gemma3n, nesta sexta-feira de madrugada. Este produto revolucionário traz para dispositivos como smartphones, tablets e laptops funções multimodais poderosas que antes só podiam ser experimentadas na nuvem.

Características principais: pequeno tamanho, grande capacidade

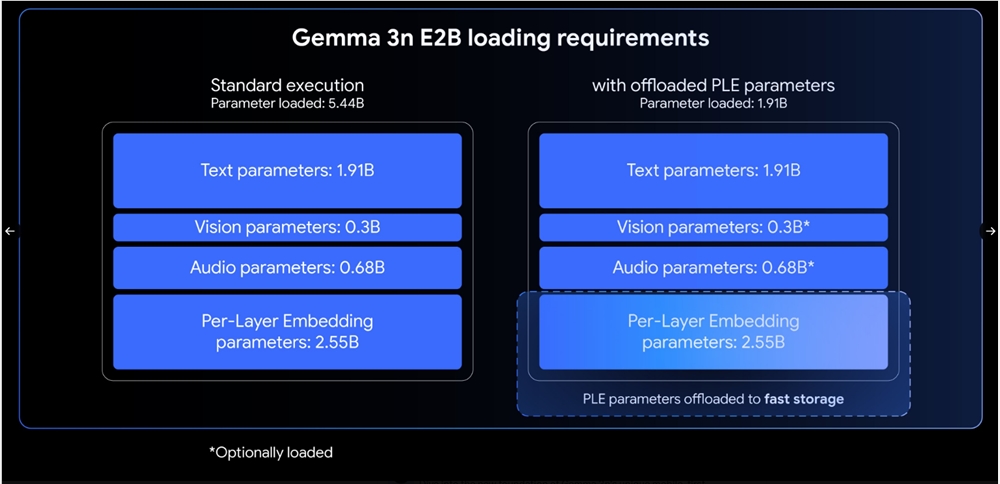

A Gemma3n oferece duas versões, E2B e E4B. Embora os parâmetros originais sejam de 5B e 8B respectivamente, através de inovações na arquitetura, seu uso de memória é equivalente a modelos tradicionais de 2B e 4B, sendo possível executá-lo com apenas 2GB e 3GB de memória. O modelo suporta nativamente o processamento de entradas multimodais, incluindo imagens, áudio, vídeo e texto, e oferece compreensão multimodal em 140 idiomas de texto e 35 idiomas.

Destaca-se que a versão E4B obteve mais de 1300 pontos no teste LMArena, tornando-se o primeiro modelo abaixo de 10 bilhões de parâmetros a atingir esse benchmark, com melhorias significativas nas habilidades multilíngues, matemática, codificação e raciocínio.

Inovações técnicas: quatro arquiteturas revolucionárias

Arquitetura MatFormer: A Gemma3n adota uma nova arquitetura Matryoshka Transformer, que permite, como um boneco russo, conter vários tamanhos em um único modelo. Durante o treinamento do modelo E4B, o submodelo E2B também é otimizado simultaneamente, oferecendo aos desenvolvedores opções flexíveis de desempenho. Com a tecnologia Mix-n-Match, os usuários podem criar modelos de tamanho personalizado entre E2B e E4B.

Tecnologia PLE (Embedding por Camada): Esta inovação permite que a maioria dos parâmetros seja carregada e calculada na CPU, enquanto apenas os pesos centrais da Transformer precisam estar armazenados na memória do acelerador, aumentando significativamente a eficiência da memória sem afetar a qualidade do modelo.

Compartilhamento de Cache KV: Otimizado para o processamento de conteúdo longo, a tecnologia de compartilhamento de cache de chave-valor aumenta em duas vezes o desempenho de pré-preenchimento em comparação com a Gemma34B, acelerando significativamente o tempo de geração do primeiro token em sequências longas.

Codificadores avançados: No áudio, utiliza um codificador baseado no modelo de voz universal (USM), suportando reconhecimento automático de fala e tradução de fala, capaz de processar fragmentos de áudio de até 30 segundos. Na visão, possui um codificador MobileNet-V5-300M, suportando várias resoluções de entrada, com velocidade de processamento de até 60 quadros por segundo no Google Pixel.

Funcionalidades práticas e cenários de aplicação

A Gemma3n destaca-se no tradutor de voz, especialmente na conversão entre inglês e espanhol, francês, italiano e português. O codificador visual MobileNet-V5, por meio de tecnologia avançada de distilação, obtém 13 vezes mais velocidade em comparação com o modelo base, reduzindo em 46% os parâmetros e em 4 vezes o uso de memória, mantendo uma maior taxa de precisão.

Ecosistema de código aberto e perspectivas de desenvolvimento

O Google já abriu o código-fonte do modelo e pesos no Hugging Face, fornecendo documentação detalhada e orientações para desenvolvedores. Desde o lançamento do primeiro modelo Gemma no ano passado, a série teve mais de 160 milhões de downloads, demonstrando um forte ecossistema de desenvolvedores.

O lançamento da Gemma3n marca uma nova fase no desenvolvimento de inteligência artificial em dispositivos. Leva as capacidades multimodais de nível de nuvem para os dispositivos dos usuários, trazendo infinitas possibilidades para aplicações móveis, hardware inteligente e outros campos.