Llama 3.1のオープンソース化のニュースがまだ記憶に新しい中、OpenAIが新たな話題を提供しました。本日より9月23日まで、毎日200万トークンの無料微調整モデルトレーニングが提供されます。これは開発者への惜しみない支援であると同時に、AI技術の進歩を大胆に推し進める試みです。

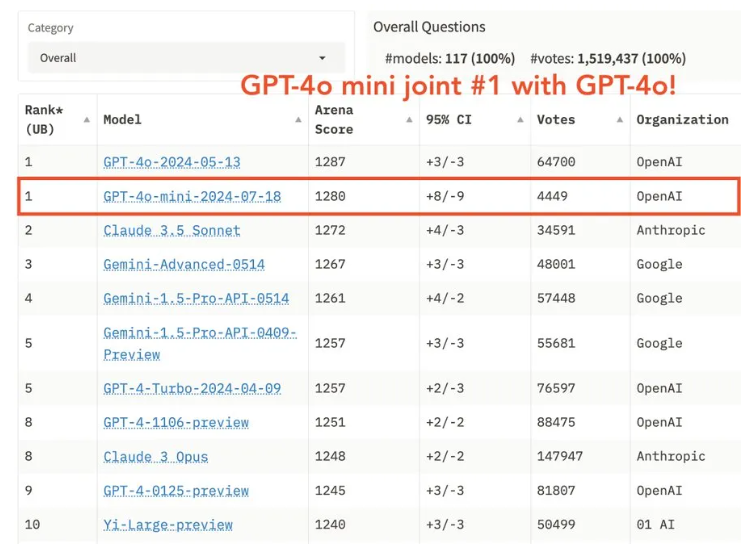

GPT-4o miniの登場は、多くの開発者を興奮させました。大規模言語モデル競技場LMSYSランキングでGPT-4oと並んで第1位を獲得し、その高い性能と、GPT-4oの20分の1という価格が注目されています。OpenAIのこの取り組みは、AI分野にとって大きな追い風となるでしょう。

メールを受け取った開発者たちは、この好機を逃すまいと大喜びで情報を共有しています。OpenAIは、7月23日から9月23日までの期間、開発者が毎日200万トークンを無料で使用できると発表しました。これを超える分については、100万トークンにつき3ドルの料金がかかります。

よりお得に:GPT-4o miniの入力トークン費用はGPT-3.5 Turboより90%安く、出力トークン費用は80%安くなっています。無料期間後も、GPT-4o miniのトレーニングコストはGPT-3.5 Turboの半分です。

より長いコンテキスト:GPT-4o miniのトレーニングコンテキストの長さは65kトークンで、GPT-3.5 Turboの4倍です。推論コンテキストの長さは128kトークンで、GPT-3.5 Turboの8倍です。

より賢く、より強力に:GPT-4o miniはGPT-3.5 Turboよりも賢く、ビジュアル機能もサポートしています(ただし、現時点では微調整はテキストのみ)。

GPT-4o miniの微調整機能は、企業顧客とTier 4およびTier 5の開発者に開放され、今後アクセス権限が段階的に拡大され、すべてのレベルのユーザーに提供される予定です。OpenAIは既に微調整ガイドを公開しており、開発者は簡単に使い始めることができます。

一部のネットユーザーは、これがOpenAIによるデータ収集、AIモデルのトレーニングと改良のための施策だと懐疑的な見方を示しています。一方、他のユーザーは、GPT-4o miniの成功は、AIが十分に賢くなり、私たちを欺くことさえできるようになったという実質的な証拠だと考えています。

GPT-4o miniのリリースと無料微調整ポリシーは、AI技術の更なる発展と普及を間違いなく促進するでしょう。開発者にとって、これは非常に貴重な機会であり、より低いコストでより強力なアプリケーションを構築できます。そしてAI技術自体にとって、これは新たなマイルストーンを意味するのでしょうか?今後の展開に注目しましょう。

微調整ドキュメント: https://platform.openai.com/docs/guides/fine-tuning/fine-tuning-integrations