人工知能分野において、バイトダンス商業化技術チームの最新成果であるInfinityモデルは、その卓越した性能と革新的な技術で、自己回帰型テキストツーイメージ生成分野の新たな王者となりました。この新しくオープンソース化されたモデルは、画像生成品質においてStable Diffusion 3を凌駕するだけでなく、推論速度においても顕著な優位性を示しています。

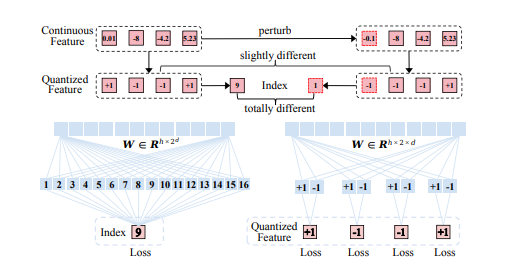

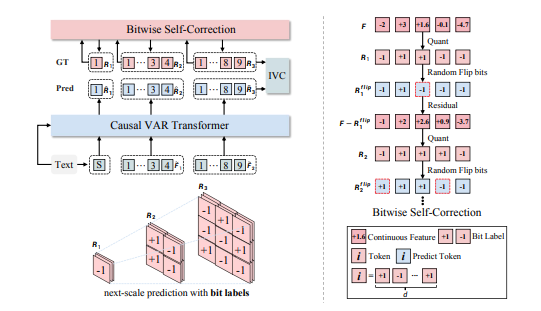

Infinityモデルの中核となる革新は、Bitwise Tokenの自己回帰フレームワークを採用している点にあります。このフレームワークは、次のレベルの解像度を構成する+1または-1からなる細粒度の「Bitwise Token」を予測することにより、モデルの高周波数信号の捕捉能力を大幅に向上させ、より詳細な画像を生成します。さらに、Infinityモデルは語彙を無限大に拡張することで、Image tokenizerの表現空間を大幅に拡大し、自己回帰型テキストツーイメージ生成の性能上限を向上させています。

性能比較において、Infinityモデルは自己回帰方式の中で際立ったパフォーマンスを示し、HART、LlamaGen、Emu3などの手法をはるかに凌駕しています。また、人間の評価においてもHARTモデルを約90%の勝率で上回りました。同時に、PixArt-Sigma、SD-XL、SD3-MediumなどのSOTA拡散モデルに対しても、75%、80%、65%の勝率で勝利し、同規模モデルにおける優位性を証明しました。

Infinityモデルのもう一つの大きな特徴は、優れたスケーリング特性です。モデルのサイズが大きくなり、トレーニングリソースの投入が増えるにつれて、検証セットの損失は着実に減少し、検証セットの精度は安定して向上します。さらに、Infinityはビット自己修正技術を提案し、モデルの自己修正能力を高め、自己回帰推論時の累積誤差問題を軽減しています。

推論速度においては、InfinityはVARの速度の優位性を継承しており、2Bモデルで1024x1024の画像を生成するのにわずか0.8秒しかかかりません。これは同規模のSD3-Mediumの3倍、12BのFlux Devの14倍の速さです。8Bモデルは同規模のSD3.5よりも7倍速く、20Bモデルで1024x1024の画像を生成するのに3秒かかり、12BのFlux Devよりも約4倍速いです。

現在、Infinityモデルのトレーニングと推論コード、デモ、モデルウェイトはGitHubリポジトリで公開されており、ウェブサイトでの体験版も提供されているため、ユーザーは簡単にモデルを試用して評価できます。

プロジェクトページ:https://foundationvision.github.io/infinity.project/