2025年1月20日、DeepSeekは、強化学習(RL)によってトレーニングされた最初の推論モデルDeepSeek-R1を発表しました。このモデルは、複数の推論ベンチマークテストにおいて、OpenAI-o1-1217と同等の性能を達成しました。DeepSeek-R1はDeepSeek-V3-Baseモデルをベースにしており、多段階トレーニングとコールドスタートデータを採用することで、推論能力を向上させています。

DeepSeekの研究者たちはまず、大規模な強化学習によって完全にトレーニングされたモデルであるDeepSeek-R1-Zeroを開発しました。これは、教師あり微調整の予備ステップなしでトレーニングされました。DeepSeek-R1-Zeroは、AIME2024試験におけるpass@1スコアが15.6%から71.0%に向上するなど、推論ベンチマークテストで優れた性能を示しました。しかし、DeepSeek-R1-Zeroには、可読性の低さや言語の混在など、いくつかの問題もありました。

これらの問題を解決し、推論性能をさらに向上させるために、DeepSeekチームはDeepSeek-R1を開発しました。DeepSeek-R1は、強化学習の前に多段階トレーニングとコールドスタートデータを取り入れています。具体的には、研究者たちはまず、数千個のコールドスタートデータを集めてDeepSeek-V3-Baseモデルを微調整しました。その後、DeepSeek-R1-Zeroのトレーニングと同様に、推論指向の強化学習を行いました。強化学習のプロセスが収束に近づくと、強化学習のチェックポイントから棄却サンプリングによって新しい教師あり微調整データを作成し、DeepSeek-V3のライティング、ファクト問答、自己認識などの分野における教師ありデータと組み合わせ、DeepSeek-V3-Baseモデルを再トレーニングしました。最後に、すべてのシナリオのプロンプトを使用して、微調整されたチェックポイントに対して追加の強化学習を行いました。

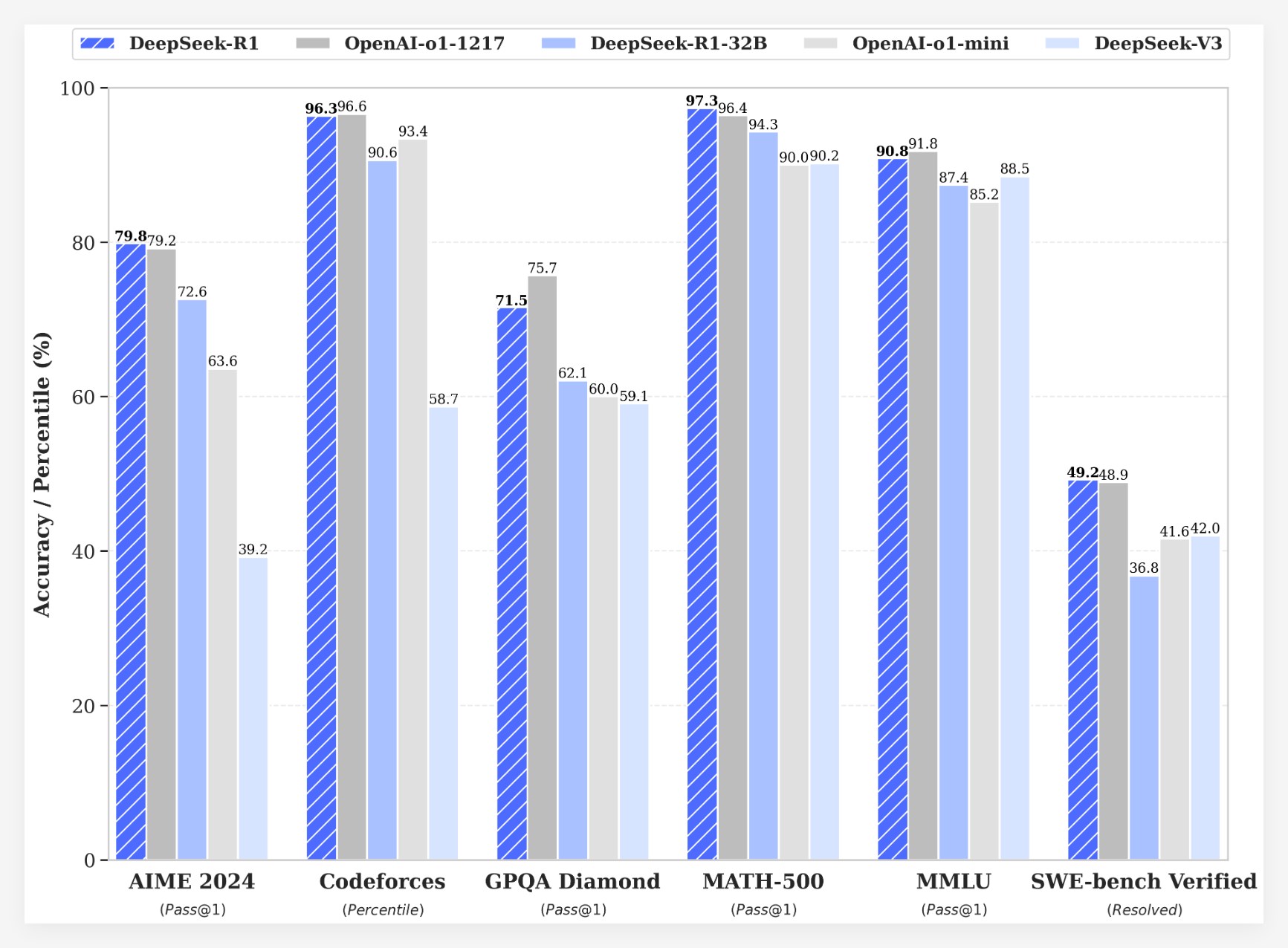

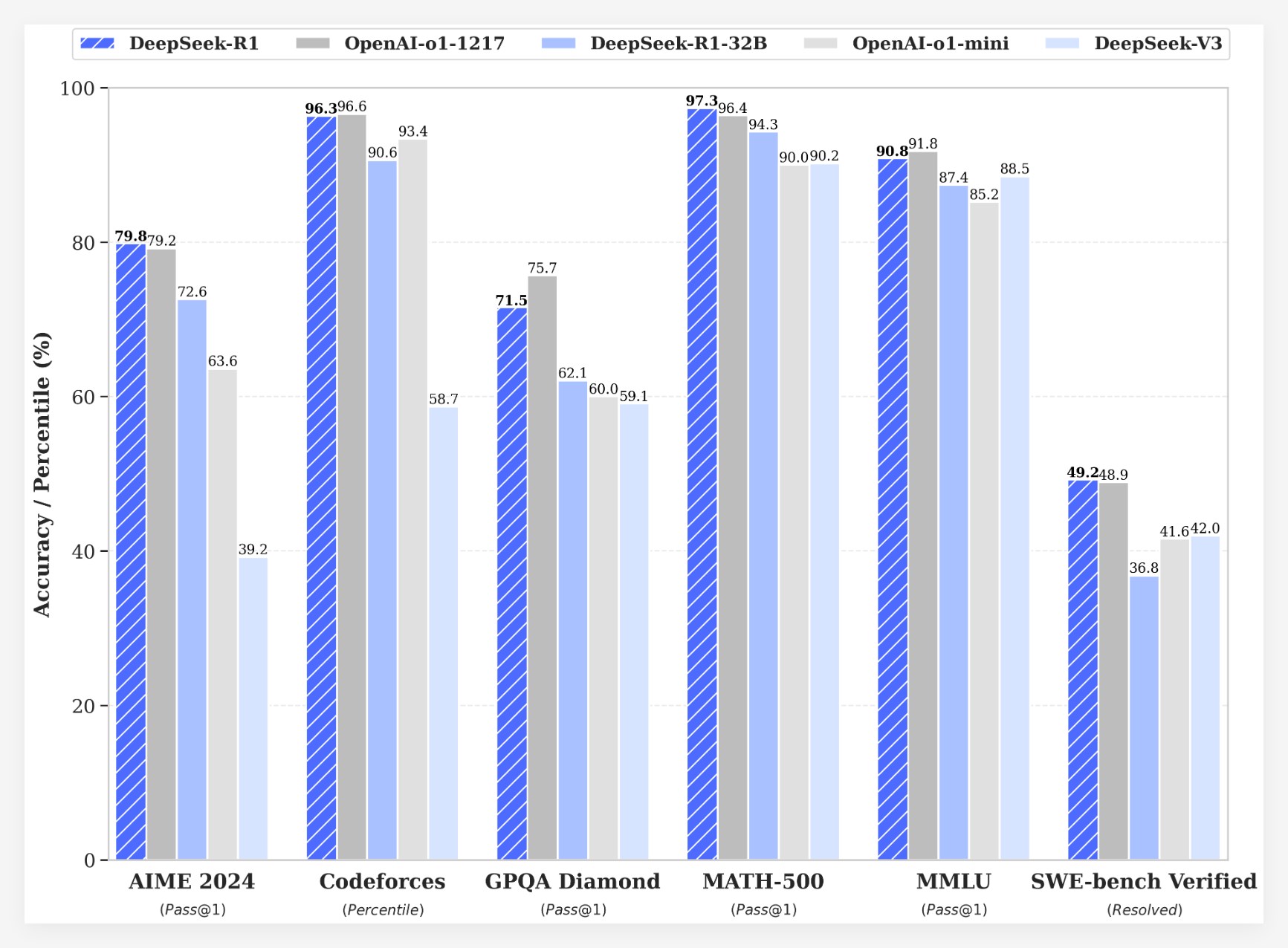

DeepSeek-R1は複数のベンチマークテストで注目すべき成果を上げています。

•AIME2024試験において、DeepSeek-R1のpass@1スコアは79.8%に達し、OpenAI-o1-1217をわずかに上回りました。

•MATH-500試験において、DeepSeek-R1のpass@1スコアは97.3%に達し、OpenAI-o1-1217と同等でした。

•コーディングコンテストタスクにおいて、DeepSeek-R1はCodeforcesで2029のEloレーティングを獲得し、96.3%の人間参加者を上回りました。

•知識ベンチマークテスト(MMLU、MMLU-Pro、GPQA Diamondなど)において、DeepSeek-R1のスコアはそれぞれ90.8%、84.0%、71.5%であり、DeepSeek-V3を大幅に上回りました。

•その他のタスク(クリエイティブライティング、一般的な質問応答、編集、要約など)でも、DeepSeek-R1は優れたパフォーマンスを示しました。

さらに、DeepSeekは、DeepSeek-R1の推論能力をより小さなモデルに蒸留することについても研究しました。研究の結果、小型モデルに強化学習を適用するよりも、DeepSeek-R1から直接蒸留する方が効果的であることがわかりました。これは、大規模基礎モデルによって発見された推論パターンが、推論能力の向上に非常に重要であることを示しています。DeepSeekは、DeepSeek-R1-Zero、DeepSeek-R1、およびDeepSeek-R1から蒸留された6つの密なモデル(1.5B、7B、8B、14B、32B、70B)(QwenとLlamaベース)をオープンソース化しました。DeepSeek-R1の発表は、強化学習が大規模言語モデルの推論能力の向上において大きな進歩を遂げたことを示しています。

コストメリット

コスト面では、DeepSeek-R1は非常に競争力のある価格戦略を提供しています。APIアクセス価格は、100万入力トークンあたり0.14ドル(キャッシュヒット)と0.55ドル(キャッシュミス)、出力トークンは100万あたり2.19ドルです。この価格戦略は、他の同類製品と比較して魅力的で、「ゲームチェンジャー」と評されています。現在、公式ウェブサイトとAPIが公開されています!https://chat.deepseek.comにアクセスしてDeepThinkを体験してください!

コミュニティのフィードバックと将来展望

DeepSeek-R1の発表は、コミュニティで活発な議論を引き起こしました。多くのユーザーは、モデルのオープンソース特性とコストメリットを高く評価し、開発者に多くの選択肢と自由を提供すると考えています。しかし、モデルのコンテキストウィンドウサイズについて疑問を呈し、将来のバージョンでさらに最適化されることを期待するユーザーもいます。

DeepSeekチームは、モデルの性能とユーザーエクスペリエンスの向上に引き続き取り組むとともに、AGI(汎用人工知能)に対するユーザーの期待に応えるために、高度なデータ分析など、将来さらに多くの機能を導入する計画です。