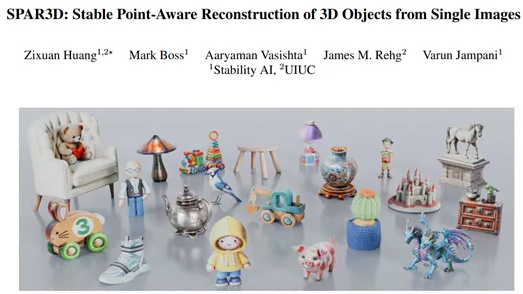

En el campo de la visión por computador, la tecnología de reconstrucción 3D a partir de una sola imagen se ha convertido en un área de investigación muy destacada, debido a su capacidad para recuperar la forma y estructura de objetos tridimensionales a partir de imágenes bidimensionales. Recientemente, la plataforma de modelos de gran tamaño de código abierto Stability-AI lanzó un modelo innovador llamado SPAR3D, que logra una velocidad de implementación inigualable de 0,7 segundos, lo que representa un cambio significativo para la industria.

La reconstrucción 3D a partir de una sola imagen enfrenta muchos desafíos, y las principales líneas técnicas se dividen en métodos basados en regresión y métodos de modelado generativo. Los métodos basados en regresión tienen una alta eficiencia al inferir superficies visibles, pero a menudo presentan problemas de estimación inexacta de superficie y textura en áreas ocultas. Por otro lado, los métodos generativos pueden manejar mejor las áreas de incertidumbre, pero tienen un alto costo computacional y sus resultados de generación a menudo no están alineados bien con las superficies visibles.

SPAR3D combina las ventajas de estos dos métodos, evitando eficazmente sus limitaciones respectivas y mejorando significativamente la velocidad y precisión de la reconstrucción.

Arquitectura de SPAR3D: Muestreo eficiente de puntos y generación de mallas

La arquitectura de SPAR3D consta de dos etapas principales: la etapa de muestreo de puntos y la etapa de generación de mallas.

Etapa de muestreo de puntos : El núcleo de esta etapa es el modelo de difusión de puntos, que puede generar nubes de puntos dispersas que incluyen información de coordenadas XYZ y colores RGB, a partir de una imagen bidimensional. Se utiliza el marco DDPM (Modelos Probabilísticos de Difusión para Eliminación de Ruido), que aprende a recuperar ruido de una nube de puntos contaminada mediante la adición de ruido gaussiano y el proceso inverso del eliminador de ruido. Durante la inferencia, se utilizan el muestreador DDIM (Modelos Implícitos de Difusión para Eliminación de Ruido) para generar muestras de nubes de puntos y el guiado sin clasificador (CFG) para mejorar la fidelidad del muestreo.

Etapa de generación de mallas : El objetivo de esta etapa es generar una malla 3D con textura a partir de una imagen y una nube de puntos de entrada. SPAR3D utiliza un gran Transformer de tres planos, que puede predecir características de tres planos a partir de la imagen y la nube de puntos, y luego estimar la forma geométrica, textura y iluminación del objeto. Durante el entrenamiento, se supervisa el modelo utilizando pérdidas de renderizado a través de un renderizador diferenciable, asegurando así la autenticidad y calidad de los resultados generados.

Desempeño destacado: Superando los métodos tradicionales

En las pruebas en los conjuntos de datos GSO y OmniObject3D, SPAR3D supera significativamente a los métodos de base tradicionales de regresión y generación en varios indicadores de evaluación. Por ejemplo, en el conjunto de datos GSO, el valor CD (Distancia de Chamfer) de SPAR3D es de 0,120, FS@0,1 es de 0,584 y el PSNR (Relación Pico-Senal-Ruido) es de 18,6, mientras que otros métodos muestran un rendimiento relativamente débil. En el conjunto de datos OmniObject3D, SPAR3D también demuestra un excelente desempeño, con un valor CD de 0,122, FS@0,1 de 0,587 y un PSNR de 17,9.

Estos resultados demuestran plenamente el extraordinario desempeño de SPAR3D en cuanto a la forma geométrica y la calidad de la textura, mostrando su potencial en aplicaciones prácticas.

Conclusión: El futuro de la tecnología de código abierto

A medida que avanza la tecnología y se amplían las aplicaciones, SPAR3D desempeñará sin duda un papel importante en el campo de la visión por computador y la reconstrucción 3D. Para desarrolladores e investigadores, la característica de código abierto de SPAR3D significa más oportunidades de innovación y aplicación.

Dirección del código abierto: https://github.com/Stability-AI/stable-point-aware-3d

Huggingface: https://huggingface.co/stabilityai/stable-point-aware-3d