GLM-4.5, el nuevo modelo de punta de la empresa Zhipu AI, ha sido oficialmente lanzado hoy. Se trata de un modelo base diseñado específicamente para aplicaciones de agentes inteligentes y ahora está disponible como código abierto en las plataformas Hugging Face y ModelScope, con los pesos del modelo bajo la licencia MIT.

Desempeño SOTA en código abierto, modelos nacionales a la cabeza

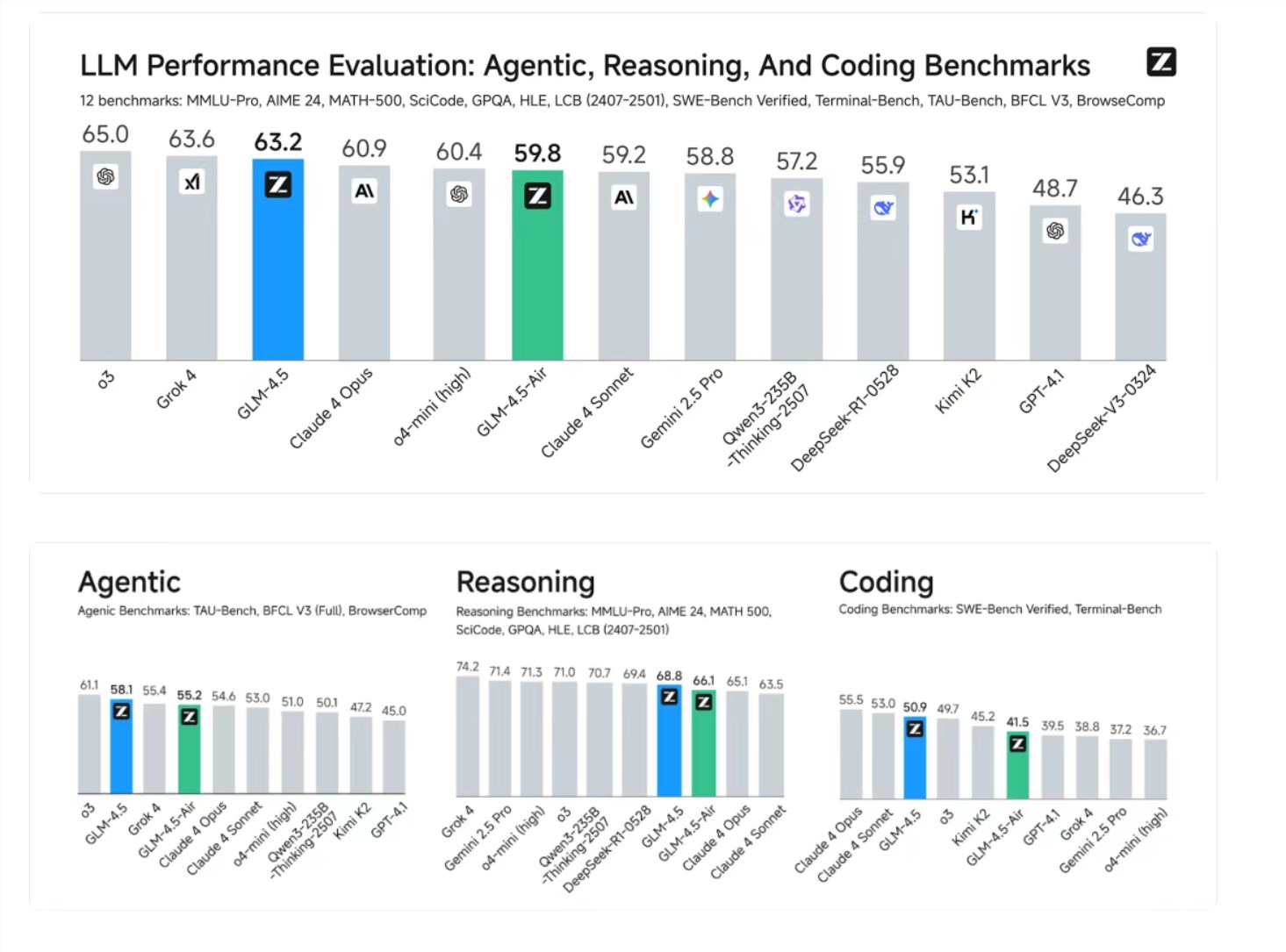

GLM-4.5 alcanza el nivel SOTA en código abierto en cuanto a capacidades integradas de razonamiento, programación y agentes. En pruebas comparativas manuales con agentes de código real, demostró ser el mejor en el país. Al evaluar de manera integral 12 benchmarks representativos, incluyendo MMLU Pro, AIME24, MATH500, SciCode, entre otros, GLM-4.5 obtuvo resultados excelentes: tercer lugar a nivel mundial, primer lugar entre modelos nacionales y primer lugar entre modelos de código abierto.

Integración nativa de tres capacidades clave

GLM-4.5 logra por primera vez la integración nativa de capacidades de razonamiento, codificación y agente dentro de un solo modelo, satisfaciendo las complejas necesidades de las aplicaciones de agentes inteligentes. Este avance tecnológico representa la completa manifestación por parte de Zhipu AI del principio fundamental de AGI: fusionar más capacidades generales de inteligencia sin perder las capacidades existentes.

Estructura MoE con alta eficiencia de parámetros

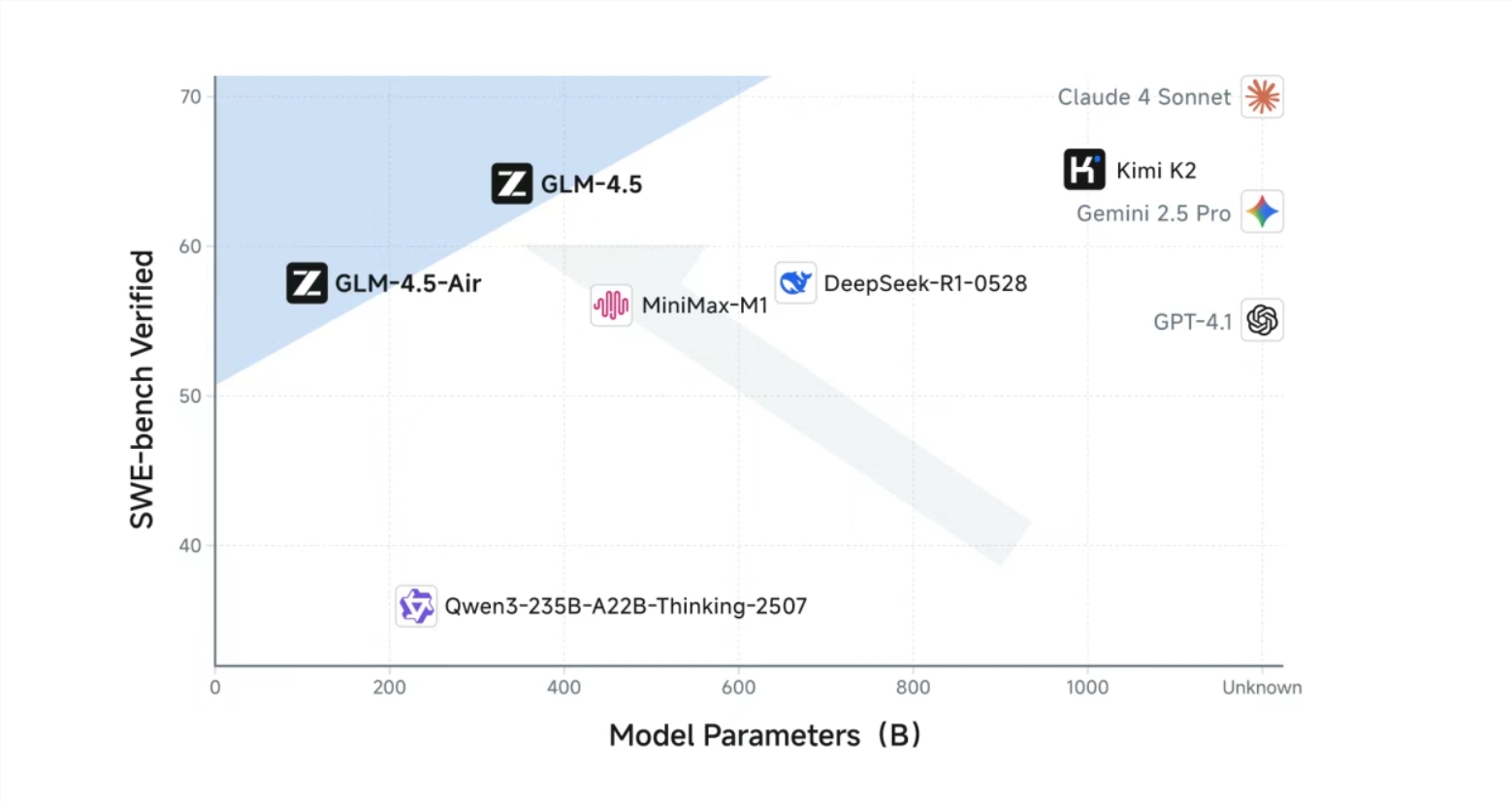

GLM-4.5 utiliza una arquitectura de mezcla de expertos (MoE), ofreciendo dos versiones: GLM-4.5 tiene un total de 355 mil millones de parámetros, con 32 mil millones activados; GLM-4.5-Air tiene un total de 106 mil millones de parámetros, con 12 mil millones activados. Destaca el hecho de que el número de parámetros de GLM-4.5 es solo la mitad de DeepSeek-R1 y un tercio de Kimi-K2, pero su desempeño es superior en varios benchmarks estándar, ubicándose en la frontera de Pareto de rendimiento/parámetro en la lista SWE-bench Verified.

Diseño de doble modo y proceso de entrenamiento

El modelo admite dos modos de operación: un modo de pensamiento para razonamientos complejos y uso de herramientas, y un modo no pensante para respuestas inmediatas. El proceso de entrenamiento incluye una preentrenamiento en datos generales de 15 billones de tokens, seguido de un entrenamiento específico en datos de 8 billones de tokens en áreas como código, razonamiento y agentes, y finalmente se mejora mediante aprendizaje por refuerzo.

Costo-efectividad extrema que rompe los precios del sector

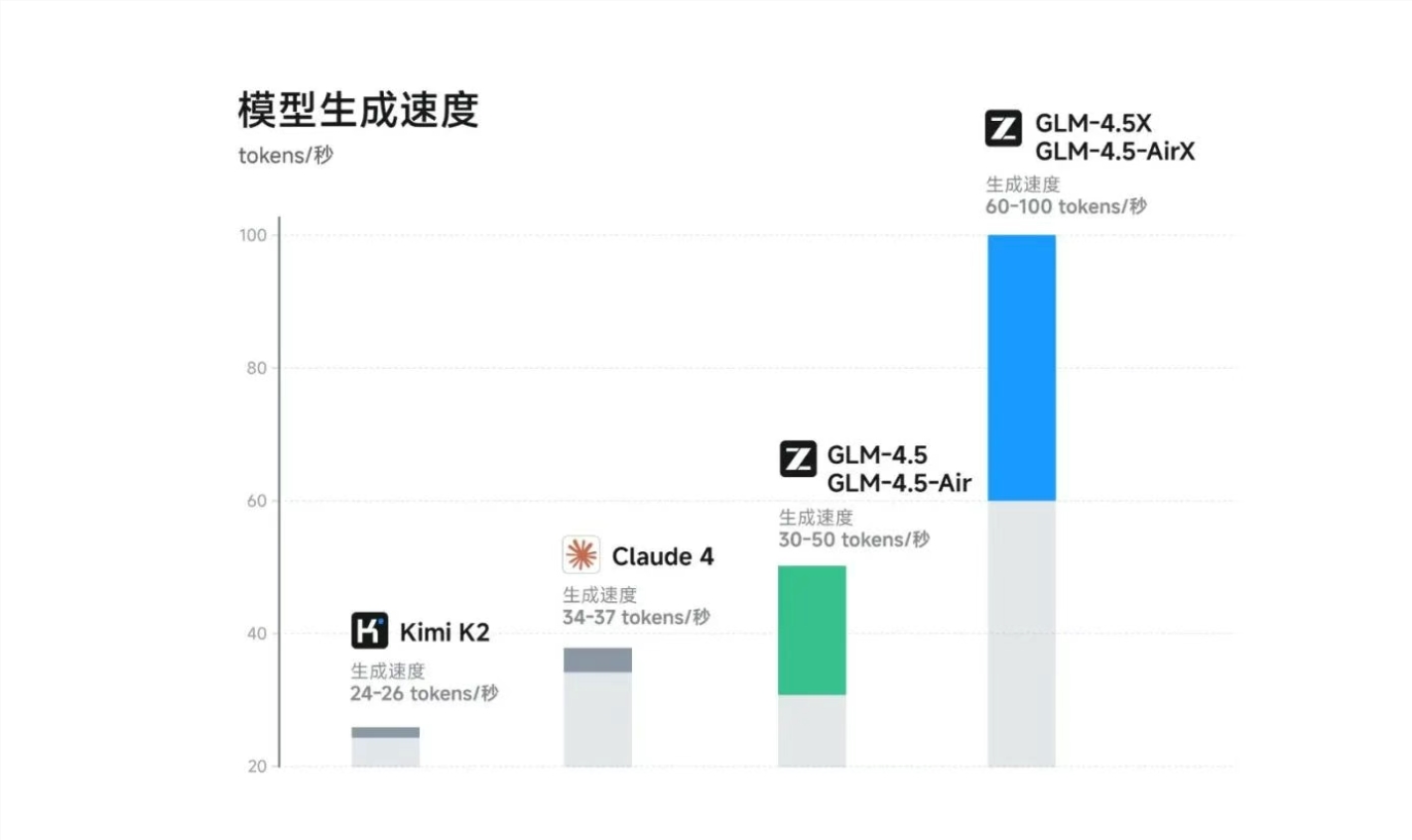

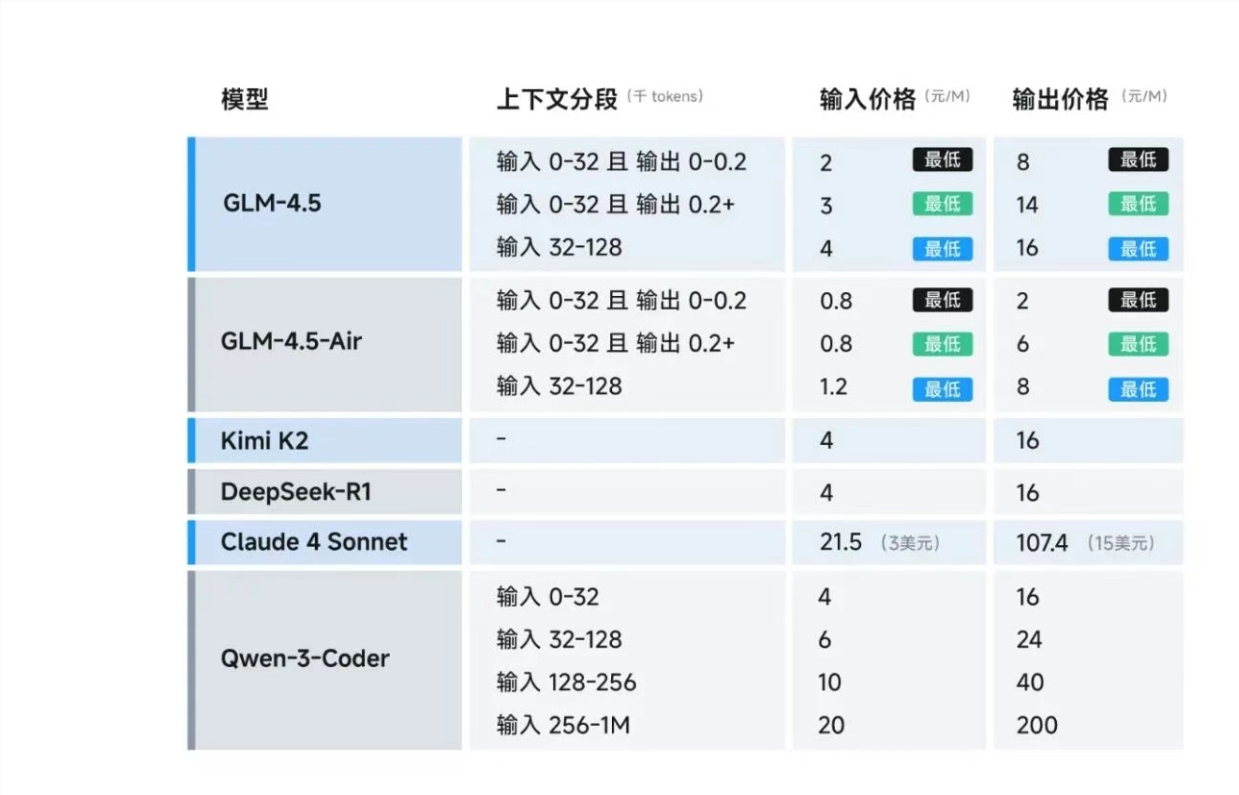

La serie GLM-4.5 ha logrado importantes avances en costos y eficiencia. El precio de la API es mucho menor que el de los modelos principales: solo 0,8 yuanes por millón de tokens de entrada y 2 yuanes por millón de tokens de salida. La versión de alta velocidad alcanza una velocidad de generación máxima de 100 tokens por segundo, admitiendo requisitos de implementación con baja latencia y alta concurrencia.

Capacidad de desarrollo completo y compatibilidad ecológica

La serie GLM-4.5 puede realizar tareas completas de desarrollo, incluyendo escritura de sitios web front-end, gestión de bases de datos back-end y soporte de interfaces de llamada a herramientas. El modelo optimiza profundamente el desarrollo completo y la llamada a herramientas, siendo compatible con marcos de agentes de código principales como Claude Code, Cline y Roo Code, y compatibilidad directa con el marco Claude Code.

Experiencia en múltiples plataformas y evaluaciones transparentes

Los usuarios pueden llamar a la API a través de la plataforma BigModel.cn, o probar gratuitamente todas las funciones en Zhizhiqingyan (chatglm.cn) y z.ai. Para garantizar la transparencia en las evaluaciones, Zhipu AI publicó 52 preguntas y trayectorias de agentes para que la industria pueda verificar y reproducirlas.

El lanzamiento de GLM-4.5 marca el surgimiento de una nueva base tecnológica para el desarrollo de aplicaciones de agentes inteligentes. Sus capacidades centrales integradas de forma nativa, su excelente relación costo-beneficio y su amplia compatibilidad ecológica podrían impulsar la aplicación a gran escala de la tecnología AGI en diversos sectores y la realización de su valor comercial.