आर्टिफिशियल इंटेलिजेंस प्रौद्योगिकी के तेजी से विकास के साथ, चीन के एक अनुसंधान संस्थान चीन विज्ञान अकादमी के गणितीय तकनीक विभाग में प्राकृतिक भाषा प्रोसेसिंग टीम ने एक नामक "स्ट्रीम-ओम्नी" टेक्स्ट-विज़ुअल-ऑडियो मल्टीमोडल बड़ा मॉडल लॉन्च किया है। इस मॉडल का मुख्य आकर्षण यह है कि यह विभिन्न मोड के बीच बातचीत के लिए एक साथ समर्थन कर सकता है, जो उपयोगकर्ता को अधिक लचीला और समृद्ध अनुभव प्रदान करता है।

एक बहु-मोड बातचीत के लिए पूर्ण समर्थन

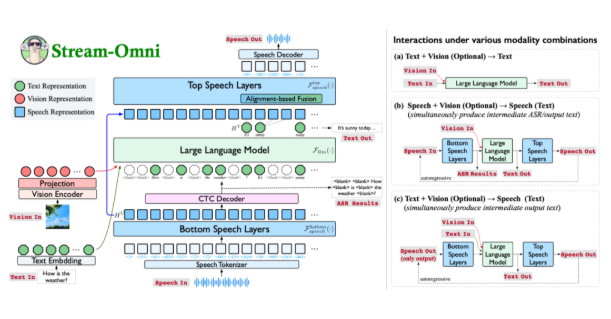

स्ट्रीम-ओम्नी एक GPT-4o आर्किटेक्चर पर आधारित बहु-मोडल बड़ा मॉडल है, जो टेक्स्ट, विज़ुअल और ऑडियो तीन मोड में अद्वितीय क्षमता दिखाता है। ऑनलाइन ऑडियो सेवा के माध्यम से, उपयोगकर्ता न केवल ऑडियो बातचीत कर सकते हैं, बल्कि इस प्रक्रिया में वास्तविक समय पर मध्यवर्ती टेक्स्ट परिणाम भी प्राप्त कर सकते हैं, जो बातचीत का अनुभव अधिक प्राकृतिक बनाता है, जैसे कि "देखते रहे और सुनते रहे"।

नवाचार के मोड अनुरूपता तरीका

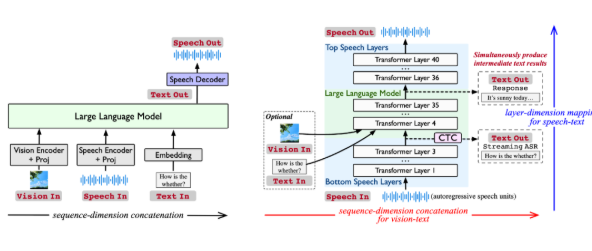

वर्तमान में मल्टीमोडल बड़े मॉडल अक्सर विभिन्न मोड के प्रतिनिधित्व को एक साथ जोड़कर, बड़े भाषा मॉडल में डालते हैं जिससे उत्तर बनता है। हालांकि, इस तरीके के लिए बहुत बड़ी मात्रा में डेटा की आवश्यकता होती है और इसकी लचीलापन कम होती है। स्ट्रीम-ओम्नी विशिष्ट रूप से मोड संबंधों के मॉडलिंग के माध्यम से, बड़े तीन-मोड डेटा के आधार पर निर्भरता कम करता है। यह ऑडियो और टेक्स्ट के बीच अर्थ के संगतता पर जोर देता है और विज़ुअल सूचना को टेक्स्ट के साथ अर्थ में पूरक बनाता है, जिससे अधिक कुशल मोड अनुरूपता होती है।

मजबूत ऑडियो बातचीत क्षमता

स्ट्रीम-ओम्नी के विशिष्ट ऑडियो मॉडलिंग तरीके के कारण, यह ऑडियो बातचीत के दौरान टेक्स्ट ट्रांस्क्रिप्शन परिणाम के साथ-साथ जेनरेट कर सकता है, जैसा कि GPT-4o में होता है। यह डिज़ाइन उपयोगकर्ता को अधिक पूर्ण मल्टीमोडल बातचीत अनुभव प्रदान करता है, विशेष रूप से ऑडियो से टेक्स्ट वास्तविक समय पर परिवर्तन की आवश्यकता वाले परिदृश्य में, जो दक्षता और सुविधा में वृद्धि करता है।

किसी भी मोड संयोजन के लिए लचीली बातचीत

स्ट्रीम-ओम्नी के डिज़ाइन के कारण, विज़ुअल कोडर, ऑडियो लेयर और बड़े भाषा मॉडल के लचीले संयोजन के माध्यम से, विभिन्न मोड संयोजन के बातचीत के समर्थन करता है। इस लचीलापन के कारण, उपयोगकर्ता अलग-अलग परिस्थितियों में इनपुट विधि के चयन में स्वतंत्र हो सकते हैं, चाहे वे टेक्स्ट, ऑडियो या विज़ुअल हों, उन्हें एक ही उत्तर प्राप्त होता है।

अनेक परीक्षणों में, स्ट्रीम-ओम्नी की दृश्य अवधारणा विशेष रूप से एक ही आकार के दृश्य बड़े मॉडल के समान है, जबकि इसकी ऑडियो बातचीत क्षमता वर्तमान तकनीक से बहुत बेहतर है। इस प्रकार आरेख आधारित ऑडियो-टेक्स्ट मैपिंग तंत्र, ऑडियो और टेक्स्ट के बीच अर्थ के सटीक अनुरूपता सुनिश्चित करता है, जिससे विभिन्न मोड के उत्तर अधिक संगत होते हैं।

स्ट्रीम-ओम्नी बहु-मोड बातचीत में एक नई दृष्टि प्रदान करता है और अपनी लचीलापन और दक्षता के कारण, टेक्स्ट, दृश्य और ऑडियो प्रौद्योगिकी के गहरे एकीकरण को आगे बढ़ाता है। हालाँकि, इसके मानव जैसे प्रदर्शन और ध्वनि विविधता में सुधार की आवश्यकता है, लेकिन यह संदेह बिना भविष्य के बहु-मोड बुद्धिमान बातचीत के लिए एक ठोस आधार प्रदान करता है।

पेपर लिंक: https://arxiv.org/abs/2506.13642

ओपन सोर्स कोड: https://github.com/ictnlp/Stream-Omni

मॉडल डाउनलोड: https://huggingface.co/ICTNLP/stream-omni-8b