Google a récemment lancé un cadre innovant appelé BlenderFusion, conçu pour améliorer les capacités d'édition et de génération de synthèse en 3D. Ce nouvel outil répond aux besoins du domaine de la génération d'images, notamment dans le traitement des scènes complexes. Les réseaux antagonistes génératifs classiques et les modèles de diffusion se sont montrés efficaces pour générer des images globales, mais limités dans le contrôle précis de plusieurs éléments visuels. La création de BlenderFusion offre une nouvelle solution à ce défi.

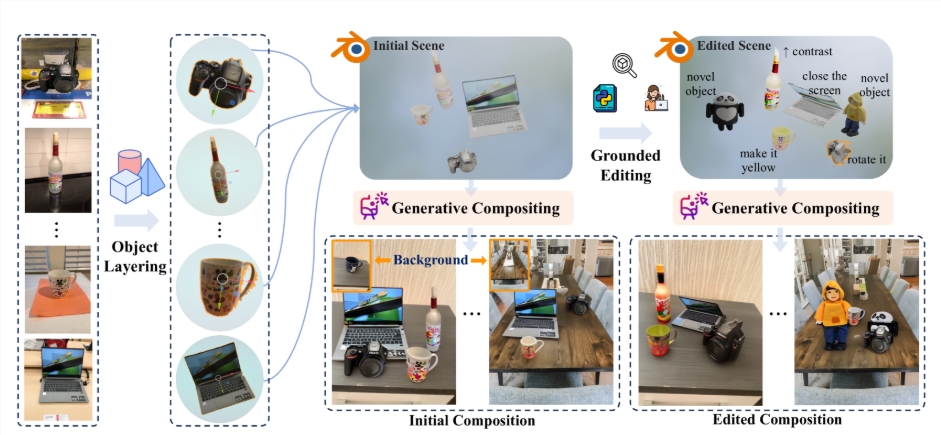

Le processus de travail de BlenderFusion se divise principalement en trois étapes : la hiérarchisation, l'édition et la synthèse. Tout d'abord, lors de l'étape de hiérarchisation, BlenderFusion extrait des objets 3D éditables à partir d'une image 2D en entrée. Les chercheurs ont utilisé plusieurs modèles de base visuelle avancés, tels que SAM2 et DepthPro, afin d'identifier plus précisément les objets dans l'image. Grâce à ces modèles, le système peut générer des nuages de points 3D des objets, posant ainsi les bases pour l'édition ultérieure.

Ensuite, pendant l'étape d'édition, les fonctionnalités puissantes de Blender s'expriment pleinement. Les utilisateurs peuvent effectuer diverses opérations sur les entités 3D importées, comme le déplacement, la rotation ou le zoom, voire ajuster finement l'apparence et les matériaux des objets. Ce processus permet aux utilisateurs de traiter chaque élément du scénario de manière flexible, de sorte que chaque modification soit reflétée efficacement dans le rendu final.

Dans l'étape de synthèse, BlenderFusion intègre le scénario 3D modifié avec le fond pour produire l'image finale. Cette étape repose sur un générateur de synthèse puissant, capable de traiter les informations détaillées provenant de différentes entrées, garantissant ainsi une qualité et une cohérence élevées dans le résultat final. L'équipe de recherche a optimisé les modèles de diffusion existants pour qu'ils intègrent efficacement les informations d'édition et de scénario source, améliorant ainsi la qualité de la synthèse.

Avec BlenderFusion, Google n'a pas seulement démontré son innovation technologique dans le domaine de l'édition visuelle 3D, mais a également offert aux utilisateurs un nouveau outil de création, rendant les tâches visuelles complexes plus intuitives et efficaces. Le lancement de ce cadre apportera certainement des avantages aux travailleurs designers et créateurs.

Projet : https://blenderfusion.github.io/

Points clés :

🌟 BlenderFusion intègre des outils d'édition 3D avancés et des modèles de diffusion, réalisant ainsi une édition et une synthèse visuelles 3D efficaces.

🛠️ Le processus de travail de ce cadre comprend trois étapes : la hiérarchisation, l'édition et la synthèse, permettant aux utilisateurs d'éditer facilement les objets 3D et de générer l'image finale.

📈 Google's BlenderFusion améliore les capacités de traitement des scènes complexes grâce à l'optimisation des modèles, aidant ainsi les designers à concrétiser leurs idées.