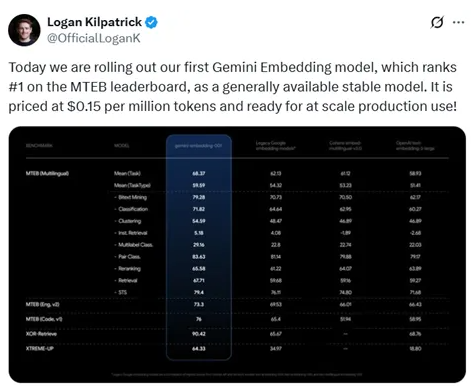

2023年7月15日、グーグルは午前1時に初めてのGeminiエントリーモデルを正式にリリースしました。このモデルは、マルチテキストエントリーベンチマークテストプラットフォーム(MTEB)で68.37という高いスコアで第1位となり、OpenAIの58.93点を上回りました。この成績は、グーグルがエントリーテクノロジーにおいて先頭を走っていることを示すだけでなく、独立したクリエイターおよびフリーランスにとってより経済的な選択肢も提供しています。Geminiエントリーモデルの使用コストは、100万トークンあたり0.15ドルです。

Geminiエントリーモデルの強力な機能

テスト結果によると、Geminiエントリーモデルは二語抽出、分類、クラスタリング、指示検索、多ラベル分類、ペア分類、並べ替え、検索および文脈的テキスト類似性などの複数のタスクで優れた性能を発揮し、現在最も強力なエントリーモデルとなっています。その多言語対応能力により、世界中のアプリケーションにおける可能性が広がり、特に英語ネイティブではないユーザーが多くいる地域での応用が期待されています。

モデル構造と技術革新

Geminiエントリーモデルは、双方向Transformerエンコーダーの構造に基づいて設計され、Geminiモデルの双方向アテンションメカニズムを維持しています。これにより、予測された言語理解能力が最大限に引き出されています。このモデルは、下位の32層のTransformerを基盤として、入力シーケンスの各トークンの埋め込みを集約し、単一の埋め込みベクトルを生成するためのプーリング層を追加しています。採用されている平均プーリング戦略はシンプルかつ効果的であり、モデルの適応性を高めています。

トレーニング方法とデータ品質管理

トレーニング中に、Geminiエントリーモデルは多段階のトレーニング戦略を採用しており、プリファインチューニングとファインチューニングの2つの段階から構成されています。プリファインチューニング段階では、大規模なWebコーパスのデータを使用してモデルをトレーニングし、主な目的は自回帰生成タスクからエンコードタスクへのパラメータの適応化です。ファインチューニング段階では、特定のタスクに特化したデータを使用してさらに詳細なトレーニングを行い、検索、分類、クラスタリングなどのタスクにおけるモデルの効率的な性能を確保します。

データ品質の向上のために、研究チームは合成データ生成戦略を設計し、Geminiを使ってトレーニングデータをフィルタリングし、低品質なサンプルを除去することで、トレーニング中のモデルの有効性を確保しています。

Geminiエントリーモデルのリリースは、グーグルがエントリーテクノロジーにおいて重要な進歩を遂げたことを示しており、人工知能分野での競争力を強化しています。このモデルの普及が進むにつれて、検索やパーソナライズド推薦などさまざまな応用が促進されることが予想されます。

体験アドレス:https://aistudio.google.com/prompts/new_chat