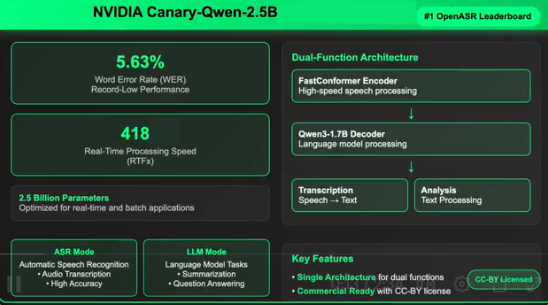

NVIDIAは最近、Canary-Qwen-2.5Bをリリースしました。これは、自動音声認識(ASR)と言語モデル(LLM)を統合した画期的な混合モデルで、Hugging Face OpenASRのランキングで記録的な5.63%の単語誤り率(WER)を達成し、第1位となりました。このモデルはCC-BYライセンスで公開されており、商用利用が可能かつオープンソースであるため、企業向け音声AIの発展に障壁を解消しています。

技術的進歩:音声理解と言語処理の統一

今回のリリースは重要な技術的マイルストーンであり、Canary-Qwen-2.5Bは音声認識と言語理解を1つのモデルアーキテクチャに統合し、音声から直接要約や質問応答などの後続タスクを実行できるようにしています。このイノベーティブなアーキテクチャは従来のASRプロセスを完全に変革し、音声認識と後処理を独立したステップではなく、統一されたワークフローとして統合しました。

主要性能指標

このモデルは複数の次元で新たな記録を樹立しました:

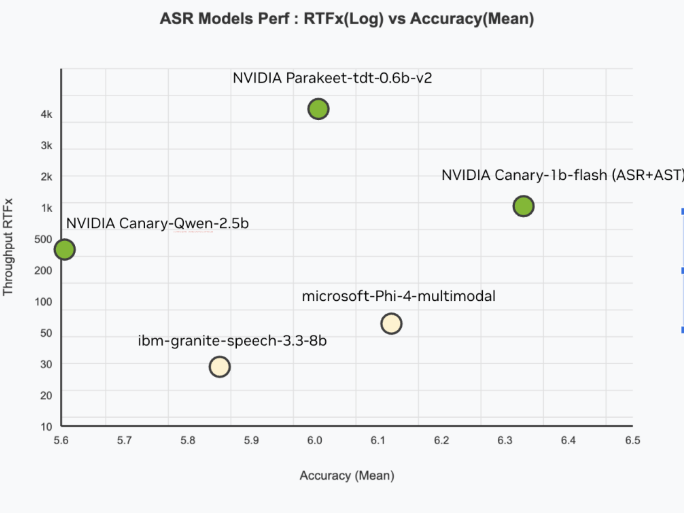

- 正確性:5.63% WER、Hugging Face OpenASRランキングで最低

- 速度:RTFxが418で、リアルタイムより418倍速く音声を処理

- 効率:25億パラメータのみで、性能が劣る大型モデルよりもコンパクト

- トレーニング規模:234,000時間の多様な英語音声データセットに基づいています

イノベーティブな混合アーキテクチャ設計

Canary-Qwen-2.5Bの中心的な革新はその混合アーキテクチャです。これには2つの重要な要素があります:

FastConformerエンコーダーは低遅延と高精度の音声認識に特化しており、Qwen3-1.7B LLMデコーダーは修正なしで事前に学習された大規模言語モデルで、アダプターを通じて音声認識のトークンを受け取ります。

このアダプターの設計により、モジュール性が保証され、Canaryエンコーダーを分離して、Qwen3-1.7Bをテキストベースのタスク用の独立したLLMとして運用することが可能です。1つの配置で口語および書面入力を処理する後続の言語タスクに対応し、マルチモーダルの柔軟性を向上させています。

企業向けの応用価値

多くの研究モデルが非商用ライセンスによって制限されているのとは異なり、Canary-Qwen-2.5BはCC-BYライセンスで公開されており、広範囲な商用アプリケーションを可能にしています:

- 企業向け音声認識サービス

- 音声に基づく知識抽出

- リアルタイム会議要約

- 音声制御のAIエージェント

- 規制に準拠したドキュメント処理(医療、法務、金融)

このモデルのLLM感知デコード機能により、句読点、大文字、文脈の正確性が向上し、これらは従来のASR出力の弱い点でした。

ハードウェア互換性と配備の柔軟性

Canary-Qwen-2.5BはNVIDIA GPUのさまざまなモデルに対して最適化されており、データセンターのA100やH100、ワークステーションのRTX PRO6000、そして消費者向けのGeForce RTX5090など、多様なハードウェアで動作します。このハードウェアカテゴリ間の拡張性により、クラウド推論や内部エッジワークロードにも対応可能です。

オープンソースによる業界発展促進

このモデルとそのトレーニングプロセスをオープンソース化することで、NVIDIAの研究チームはコミュニティ主導の音声AIの進歩を促進することを目指しています。開発者はNeMoと互換性のある他のエンコーダーとLLMを組み合わせ、新領域や言語用の特定タスクの混合モデルを作成できます。

このバージョンでは、LLMを中心としたASRの先駆けとなることを果たしました。ここでは、LLMが後処理機関ではなく、音声からテキストへのプロセスに統合されたコアエージェントとして機能します。この方法は、現実世界のマルチモーダル入力に基づいて包括的な理解と意思決定を行うシステムに向かう、より広範なトレンドを反映しています。

NVIDIAのCanary-Qwen-2.5Bは単なるASRモデルではなく、音声理解と汎用言語モデルを統合するビジョンです。SoTA性能、商用利用可能性、そしてオープンな革新の道を備えているこのバージョンは、企業、開発者、研究者が次の世代の音声優先AIアプリケーションを開くための基盤ツールになることが期待されています。