No mês de julho de 2025, a Bilibili (B站) anunciou que seu modelo de geração de vídeos animados de código aberto AniSora recebeu uma grande atualização e lançou oficialmente a AniSora V3. Como parte do projeto Index-AniSora, a versão V3 otimizou ainda mais a qualidade da geração, a fluidez dos movimentos e a diversidade de estilos em relação à versão anterior, oferecendo ferramentas mais poderosas para criadores de conteúdo de anime, mangá e VTuber. A AIbase analisa profundamente os avanços técnicos, aplicações e impacto na indústria da AniSora V3.

Atualizações Técnicas: Maior Qualidade e Controle Preciso

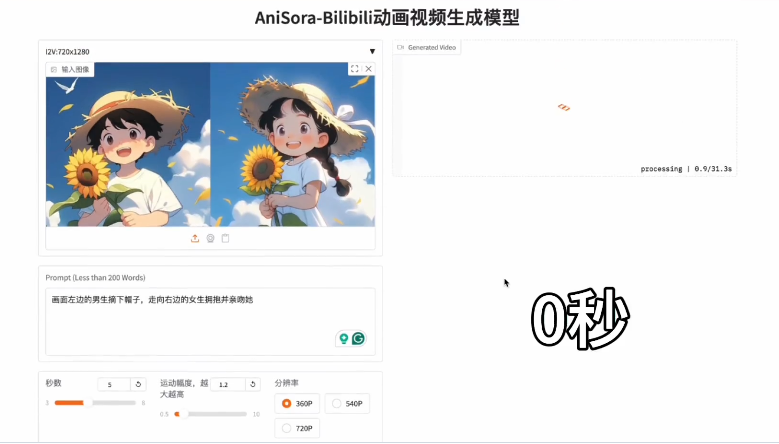

A AniSora V3 é baseada nos modelos anteriores da Bilibili, CogVideoX-5B e Wan2.1-14B, combinando o framework de aprendizado reforçado com feedback humano (RLHF), melhorando significativamente a qualidade visual e a consistência dos movimentos nos vídeos gerados. Ela suporta a geração de vídeos animados em vários estilos com apenas um clique, incluindo trechos de séries animadas, animações nacionais, adaptações de quadrinhos e conteúdo de VTuber.

As principais atualizações incluem:

- Módulo de Máscara Espaço-Temporal (Spatiotemporal Mask Module) otimizado: A versão V3 aprimorou a capacidade de controle espaço-temporal, suportando tarefas mais complexas de animação, como controle detalhado das expressões faciais dos personagens, movimento dinâmico da câmera e geração guiada por imagens locais. Por exemplo, a instrução "cinco garotas dançam enquanto a câmera se aproxima, levantando as mãos esquerdas até a cabeça e abaixando-as até os joelhos" pode gerar uma animação de dança fluida, com a câmera e os movimentos dos personagens sincronizados naturalmente.

- Expansão do conjunto de dados: A V3 continua treinando-se com mais de 10 milhões de fragmentos de vídeo animado de alta qualidade (extraídos de 1 milhão de vídeos originais), adicionando uma nova linha de produção de limpeza de dados, garantindo consistência no estilo e riqueza nos detalhes do conteúdo gerado.

- Otimização de hardware: A V3 agora suporta nativamente a NPU Ascend910B da Huawei, totalmente treinada com chips nacionais, aumentando em aproximadamente 20% a velocidade de inferência, gerando um vídeo de alta definição de 4 segundos em apenas 2 a 3 minutos.

- Aprendizado de múltiplas tarefas: A V3 fortaleceu sua capacidade de processamento de múltiplas tarefas, suportando desde a geração de vídeos a partir de uma única imagem, interpolação de quadros-chave até sincronização labial, sendo especialmente adequada para adaptações de quadrinhos e conteúdo de VTuber.

Nos testes mais recentes, a AniSora V3 atingiu níveis líderes da indústria (SOTA) em consistência de personagens e fluidez de movimentos nos benchmarks VBench e testes subjetivos cegos, especialmente destacando-se em ações complexas (como ações exageradas de anime que violam as leis físicas).

Ecosistema Aberto: Desenvolvimento Comunitário e Transparente

O código completo de treinamento e inferência da AniSora V3 foi atualizado no GitHub em 2 de julho de 2025, permitindo que desenvolvedores acessem os pesos do modelo e o conjunto de dados de avaliação com 948 vídeos animados através do Hugging Face. A Bilibili enfatizou que a AniSora é um "presente aberto ao mundo do anime", incentivando a colaboração comunitária para otimizar o modelo. Os usuários precisam preencher um formulário de solicitação e enviá-lo para o e-mail designado (como yangsiqian@bilibili.com) para obter acesso aos pesos da versão V2.0 e ao conjunto de dados completo.

A V3 também introduziu o primeiro framework de RLHF voltado para a geração de vídeos animados, ajustando o modelo com ferramentas como AnimeReward e GAPO, garantindo que a saída esteja alinhada com os gostos humanos e requisitos de estilo de anime. Desenvolvedores da comunidade já estão começando a criar plug-ins personalizados com base na V3, como melhorar a geração de estilos específicos de anime (como o estilo Ghibli).

Aplicações: Da Criatividade ao Comércio

A AniSora V3 suporta diversos estilos de anime, incluindo anime japonês, animações nacionais originais, adaptações de quadrinhos, conteúdo de VTuber e vídeos satíricos (guchu), cobrindo 90% das aplicações de vídeos animados. As aplicações específicas incluem:

- Transformação de imagem em vídeo: Os usuários carregam uma imagem animada de alta qualidade e, juntamente com dicas de texto (como "o personagem acena enquanto está em um carro em movimento, com o cabelo balançando ao vento"), podem gerar vídeos dinâmicos, mantendo os detalhes e o estilo do personagem consistentes.

- Adaptação de quadrinhos: Gerar animações com sincronização labial e ações a partir de frames de quadrinhos, adequado para produzir rapidamente trailers ou curtas-metragens.

- VTuber e jogos: Suporte à geração em tempo real de animações de personagens, ajudando criadores independentes e desenvolvedores de jogos a testar rapidamente os movimentos dos personagens.

- Saída de alta resolução: Os vídeos gerados suportam até 1080p, garantindo apresentações profissionais em redes sociais e plataformas de streaming.

Testes da AIbase mostraram que a V3 reduziu em aproximadamente 15% os problemas de artefatos em cenas complexas (como interações entre múltiplos personagens e fundos dinâmicos), com tempo médio de geração de 2,5 minutos (para vídeos de 4 segundos).

O lançamento da AniSora V3 reduz ainda mais a barreira para a criação de animações, permitindo que criadores independentes e equipes pequenas realizem produção de animações de alta qualidade a baixo custo. Em comparação com modelos de geração de vídeos genéricos como Sora da OpenAI ou Kling, a AniSora V3 se concentra no setor de anime, preenchendo uma lacuna no mercado. Em comparação com a EX-4D da ByteDance, a AniSora V3 se concentra mais em estilos 2D/2.5D de anime, em vez de geração de múltiplas perspectivas 4D, demonstrando uma abordagem tecnológica diferente.

Projeto: https://t.co/I3HPKPvsBV