A GLM-4.5, a nova plataforma de modelo de base para aplicações de agentes inteligentes, foi oficialmente lançada pela Zhipu AI hoje. O modelo está agora disponível como código aberto nos plataformas Hugging Face e ModelScope, com os pesos do modelo sob a licença MIT.

Desempenho SOTA de código aberto, modelos nacionais liderando

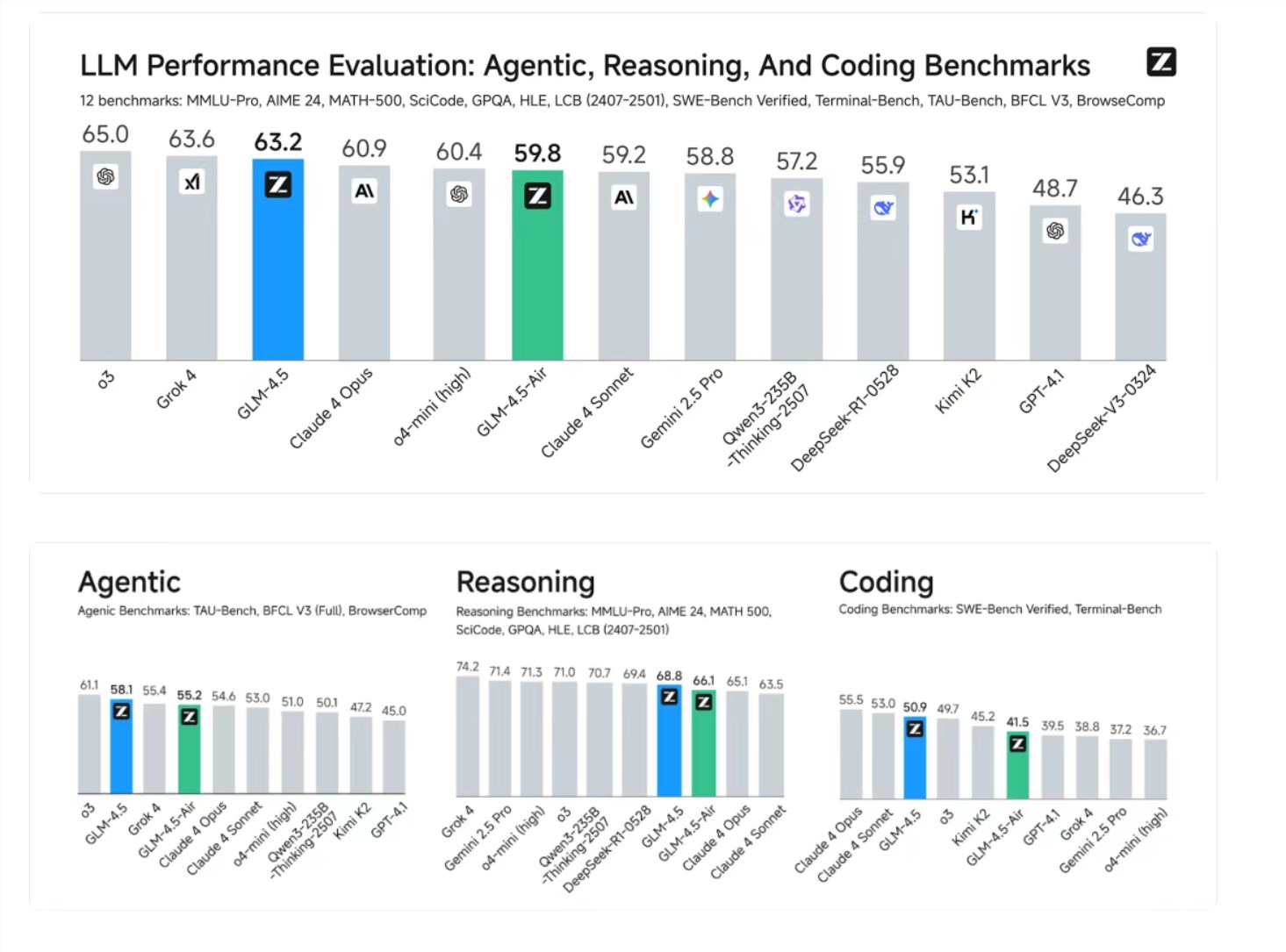

A GLM-4.5 atinge o nível SOTA de código aberto em habilidades combinadas de raciocínio, codificação e agentes. Em avaliações manuais comparativas de agentes de código real, demonstrou desempenho melhor no país. Após uma avaliação abrangente em 12 benchmarks mais representativos, incluindo MMLU Pro, AIME24, MATH500, SciCode, entre outros testes autorizados, a GLM-4.5 obteve excelentes resultados, ficando em terceiro lugar no mundo, primeiro no país e primeiro no código aberto.

Integração nativa das três principais capacidades

A GLM-4.5 é a primeira a integrar naturalmente as capacidades de raciocínio, codificação e agente em um único modelo, atendendo às demandas complexas de aplicações de agentes. Essa inovação tecnológica demonstra a apresentação completa dos princípios fundamentais da AGI pela Zhipu AI: integrar mais capacidades gerais de inteligência sem comprometer as capacidades existentes.

Estrutura MoE com alta eficiência de parâmetros

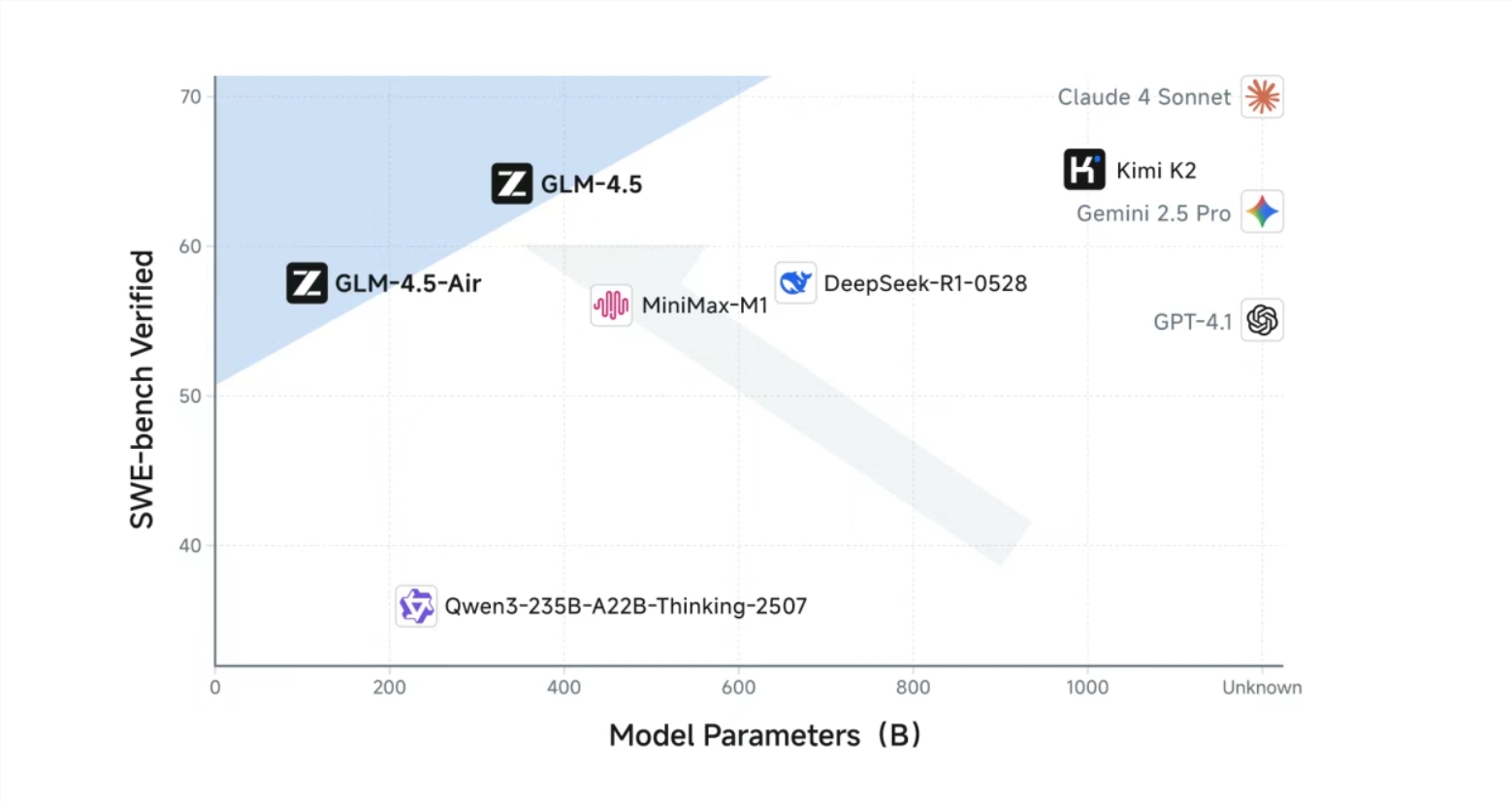

A GLM-4.5 utiliza uma arquitetura Mistura de Especialistas (MoE), oferecendo dois versões: a GLM-4.5 possui 355 bilhões de parâmetros totais e 32 bilhões de parâmetros ativados; a GLM-4.5-Air possui 106 bilhões de parâmetros totais e 12 bilhões de parâmetros ativados. Vale ressaltar que a quantidade de parâmetros da GLM-4.5 é apenas metade da DeepSeek-R1 e um terço da Kimi-K2, mas apresenta desempenho superior em vários benchmarks padrão, estando na fronteira de Pareto de desempenho/parâmetro no ranking SWE-bench Verified.

Design de dois modos e processo de treinamento

O modelo suporta dois modos de operação: o modo de pensamento, usado para raciocínio complexo e uso de ferramentas, e o modo não pensante, usado para respostas imediatas. O processo de treinamento inclui pré-treinamento em dados gerais de 15 trilhões de tokens, seguido por treinamento específico em dados de 8 trilhões de tokens nas áreas de código, raciocínio e agentes, e finalmente reforço por aprendizado de reforço para aprimorar ainda mais as capacidades do modelo.

Excepcional relação custo-benefício, rompendo os preços do setor

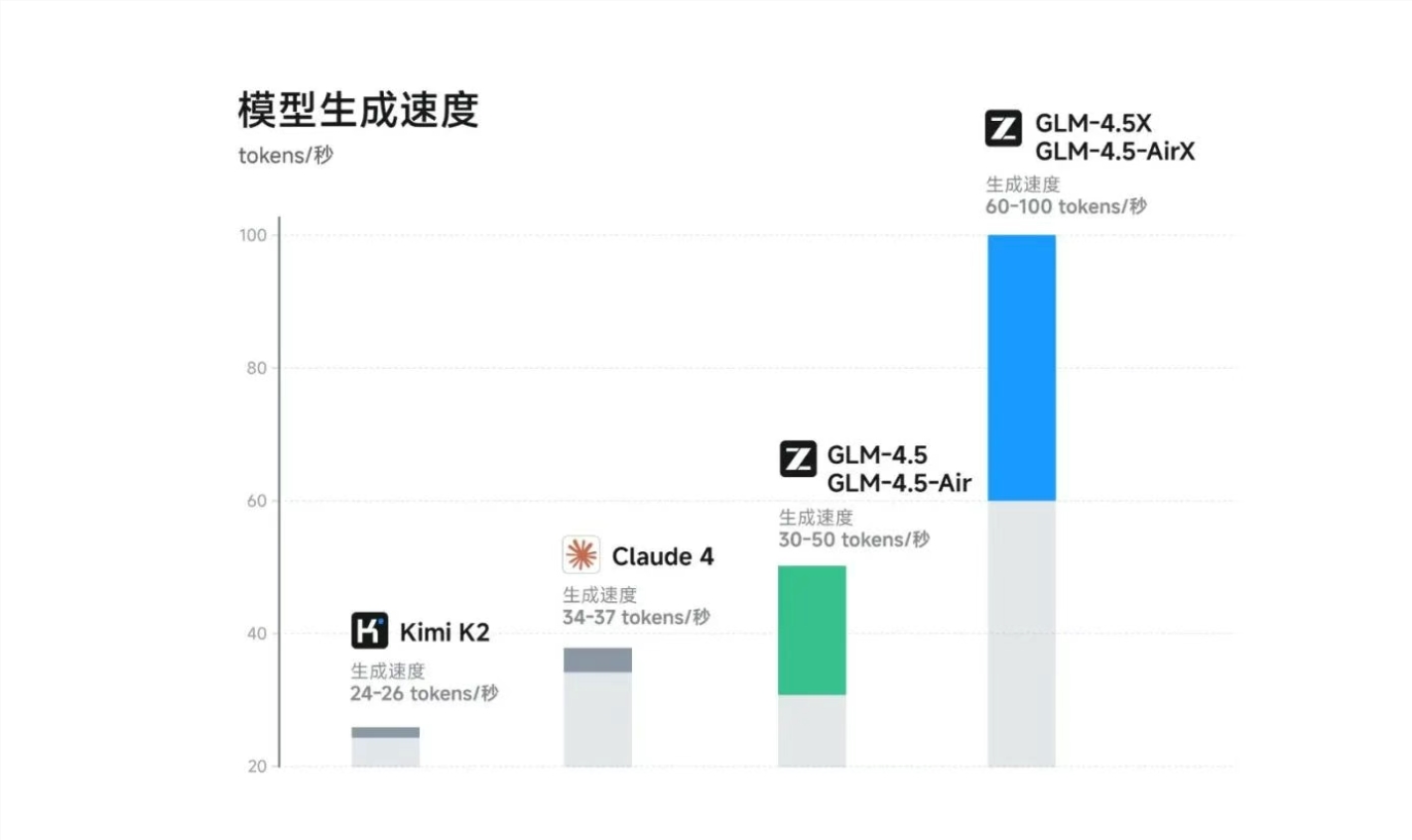

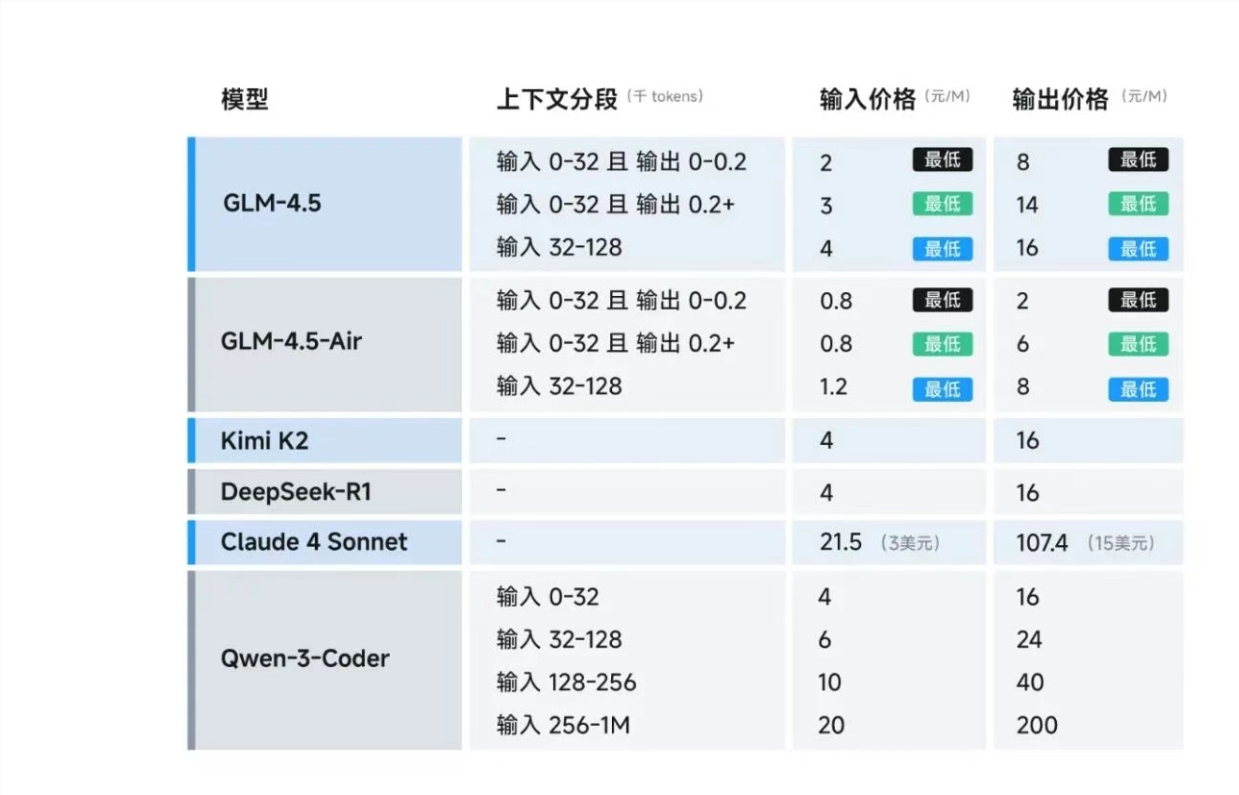

A série GLM-4.5 realiza uma grande ruptura em custo e eficiência, com preço de chamada de API muito inferior aos modelos principais: entrada apenas 0,8 yuan por milhão de tokens e saída 2 yuan por milhão de tokens. A versão de alta velocidade tem uma taxa de geração máxima de até 100 tokens por segundo, atendendo às necessidades de implantação de baixa latência e alto paralelismo.

Capacidade de desenvolvimento completo e compatibilidade ecológica

A série GLM-4.5 pode lidar com tarefas completas de desenvolvimento, tendo capacidades como escrita de sites front-end, gerenciamento de bancos de dados back-end e suporte a interfaces de chamada de ferramentas. O modelo otimiza profundamente o desenvolvimento completo de programação e a chamada de ferramentas, sendo compatível com frameworks de agentes de código como Claude Code, Cline e Roo Code, compatível com o framework Claude Code com um clique.

Experiência em múltiplas plataformas e avaliação transparente

Os usuários podem chamar a API por meio da plataforma BigModel.cn, ou experimentar gratuitamente todas as funcionalidades completas no Zhizhi Qingyan (chatglm.cn) e z.ai. Para garantir transparência nas avaliações, a Zhipu AI publicou 52 perguntas e trajetórias de Agentes para verificação e reprodução pelo setor.

A lançamento da GLM-4.5 marca o surgimento de uma nova base tecnológica para o desenvolvimento de aplicações de agentes inteligentes. Suas capacidades centrais integradas naturalmente, relação custo-benefício extremamente boa e compatibilidade ecológica ampla têm o potencial de impulsionar a aplicação em larga escala e o valor comercial da tecnologia AGI em diversos setores.