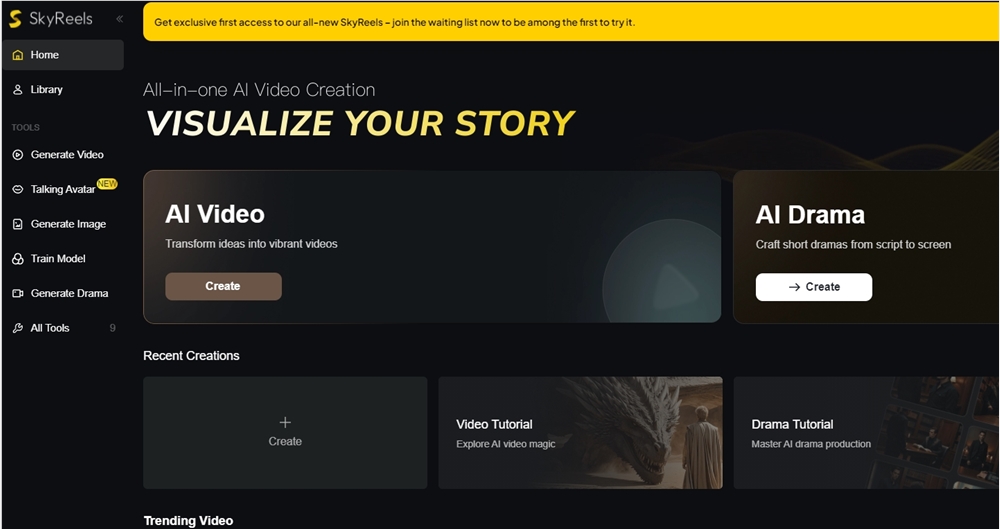

Em 15 de agosto de 2025, o Grupo Kunlun Wanjie anunciou oficialmente a lançamento da versão 7.5 do modelo Mureka, trazendo uma nova ruptura para o campo da criação musical com IA. Essa notícia marca o encerramento bem-sucedido da semana de lançamento das tecnologias SkyWork AI da Kunlun Wanjie. Durante o período de cinco dias do lançamento, a Kunlun Wanjie lançou diariamente um novo modelo, abrangendo tecnologias de ponta em cenários centrais multimodais, incluindo os modelos SkyReels-A3, Matrix-Game2.0, Matrix-3D, Skywork UniPic2.0 e Skywork Deep Research Agent.

A lançamento do Mureka V7.5 foi a peça principal da semana de lançamento tecnológico. Ele demonstrou capacidades notáveis na criação de músicas em chinês. O modelo não apenas alcançou melhorias significativas na timbre e nas técnicas de execução, mas também fez progressos notáveis no diction e na expressão emocional. Com uma compreensão profunda dos estilos musicais chineses e dos elementos relacionados, o Mureka V7.5 pode transmitir com precisão a essência artística e as nuances emocionais da música chinesa. Ele abrange diversos estilos, desde canções folclóricas tradicionais, óperas, clássicos populares da música mandarim até músicas folclóricas contemporâneas, mostrando a diversidade e as características culturais da música chinesa.

Para aprimorar ainda mais a autenticidade e a profundidade emocional das vozes humanas, o Mureka V7.5 otimizou a tecnologia de reconhecimento automático de voz (ASR). Essa tecnologia atua no nível microscópico da interpretação, identificando com precisão as palavras cantadas e analisando o uso de respiração, oscilações emocionais e detalhes técnicos nas interpretações reais. Ao dividir inteligentemente as frases musicais e determinar posições naturais de respiração e pausas, o Mureka V7.5 aumentou significativamente a clareza das frases geradas e a sensação realista da estrutura. Esses detalhes capturados e devolvidos ao modelo gerador aumentaram enormemente a naturalidade da voz humana, a sensação de respiração e a autenticidade da expressão emocional, reduzindo efetivamente o aspecto mecânico e tornando as músicas interpretadas pela IA mais próximas da voz humana, especialmente na manipulação das particularidades rítmicas e de respiração das músicas chinesas.

Em paralelo, a equipe de voz da Kunlun Wanjie também lançou o MoE-TTS — o primeiro framework de síntese de voz baseado em Mixture of Experts (MoE) que permite descrições de personagens. Como um trabalho de pesquisa voltado para cenários de descrição aberta, o MoE-TTS permite que os usuários controlem com precisão as características e o estilo da voz por meio de descrições em linguagem natural. Mesmo usando dados abertos, essa tecnologia pode se comparar ou superar produtos comerciais fechados. O lançamento do MoE-TTS tem o potencial de resolver problemas persistentes no campo da síntese de voz descritiva, como quando as falas geradas desviam-se das expectativas dos usuários ao lidar com metáforas, comparações e outras figuras de linguagem complexas. Esse framework combina a capacidade textual do modelo de linguagem grande pré-treinado (LLM) com módulos especializados em voz, garantindo que cada modalidade seja otimizada independentemente sem interferências, obtendo assim uma capacidade de compreensão geral sem perda de conhecimento. Em conjuntos de testes que abrangem descrições dentro e fora do domínio, o MoE-TTS apresentou excelentes resultados em termos de aderência à expressão de estilo e aderência geral, demonstrando vantagens em sua capacidade de correspondência com descrições complexas.

O lançamento do MoE-TTS não só fornece uma solução de TTS descritiva aberta replicável para a comunidade acadêmica, mas também demonstra o grande potencial da abordagem de "desacoplamento de modos + transferência de congelamento de conhecimento" na síntese de voz. Essa inovação pode impulsionar a indústria a adotar uma nova perspectiva, passando de um controle baseado em etiquetas fechadas para um controle livre baseado em linguagem natural, acelerando a melhoria da experiência em pessoas digitais, assistentes virtuais e criação de conteúdo imersivo. Atualmente, o MoE-TTS está em evolução, e seu plano futuro é integrá-lo à plataforma Mureka-Speech como modelo base para dublagem de personagens, oferecendo aos desenvolvedores e criadores globais capacidades de síntese de voz descritiva aberta, eficiente e personalizável.

O Grupo Kunlun Wanjie, por meio do lançamento do Mureka V7.5 e do MoE-TTS, demonstrou sua forte capacidade e inovação no campo da criação musical com IA e síntese de voz. Essas tecnologias não apenas trazem novas possibilidades para a criação musical e síntese de voz, mas também oferecem novas ideias e direções para pesquisas e desenvolvimentos nesses campos. Os usuários globais podem acessar www.mureka.ai para experimentar a nova versão 7.5 e explorar as infinitas possibilidades da criação musical.