A Alibaba Group lançou recentemente seu mais novo modelo de linguagem multimodal HumanOmniV2, causando grande impacto no setor de IA. Esse modelo, com sua forte capacidade de compreensão do contexto global e raciocínio multimodal, marca mais um grande avanço tecnológico da Alibaba na área de inteligência artificial.

Capacidades principais: Compreensão do contexto global e raciocínio multimodal

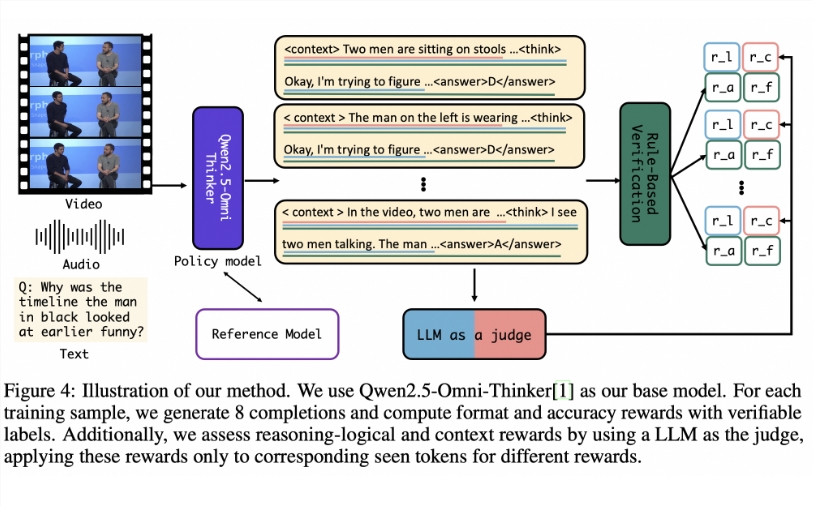

O maior destaque do HumanOmniV2 é sua mecanismo obrigatório de resumo de contexto, que permite raciocínio multimodal com base no contexto global, melhorando significativamente a capacidade do modelo de entender cenários complexos. Em comparação com modelos tradicionais de linguagem, o HumanOmniV2 integra profundamente dados textuais, imagens e outros modos, resolvendo os "problemas de atalho" (shortcut problems) comuns em modelos convencionais, resultando em uma compreensão e saída de raciocínio mais precisa.

Em vários testes de benchmark autoritários, o HumanOmniV2 demonstrou desempenho excepcional. De acordo com informações públicas, o modelo alcançou uma taxa de precisão de 58,47% no conjunto de dados Daily-Omni, 47,1% no conjunto de dados WorldSense e um excelente resultado de 69,33% no teste IntentBench, desenvolvido pela própria Alibaba. Esses dados indicam que o HumanOmniV2 possui vantagens significativas ao lidar com conversas cotidianas, percepção de cenários complexos e compreensão de intenções dos usuários.

Inovação tecnológica: Superando as limitações dos modelos tradicionais

O desenvolvimento do HumanOmniV2 foi liderado pelo Tongyi Lab da Alibaba, focando em melhorar o desempenho do modelo em tarefas multimodais. Modelos tradicionais frequentemente apresentam desvios ao lidar com informações entre modos, por falta de contexto global. O HumanOmniV2 introduz um novo mecanismo de resumo de contexto, garantindo que o modelo possa analisar todas as informações nos dados de entrada, gerando resultados mais alinhados às intenções dos usuários. Essa inovação tecnológica o torna potencialmente aplicável em aplicações para consumidores (como atendimento ao cliente inteligente e criação de conteúdo) e em cenários corporativos (como sistemas de decisão inteligente).

Além disso, o HumanOmniV2 também se destaca na suporte a múltiplos idiomas, permitindo entradas de instruções em diversos idiomas, incluindo chinês e inglês, aumentando significativamente sua aplicabilidade internacional. Essa característica o torna mais competitivo no mercado global de IA.

Impacto na indústria: Redefinindo os limites das aplicações de IA

Com o surgimento de empresas chinesas de IA como a DeepSeek, a Alibaba está reforçando sua posição líder no setor global de IA por meio do HumanOmniV2. Discussões nas redes sociais mostram que a indústria reagiu positivamente à divulgação do HumanOmniV2, acreditando que sua capacidade de raciocínio multimodal impulsionará o uso da IA em áreas como educação, saúde e finanças. Por exemplo, o HumanOmniV2 pode ser usado para gerar vídeos de IA de alta qualidade ou auxiliar médicos na análise de casos complexos em cenários de saúde inteligente.

Ao mesmo tempo, as ações frequentes da Alibaba no setor de IA também geraram atenção. Do Qwen até o Wan2.1VACE, e agora o HumanOmniV2, a Alibaba está acelerando sua disposição no ecossistema de IA, buscando conquistar o mercado com estratégias de abertura e comercialização. No entanto, a competição é intensa, e os modelos de IA de empresas como Huawei e Baidu também estão se desenvolvendo rapidamente. O desempenho subsequente do HumanOmniV2 merece atenção contínua.

O lançamento do HumanOmniV2 não só demonstra a força técnica da Alibaba, mas também reflete a ascensão da indústria de IA chinesa na competição global. A AIbase acredita que, à medida que a tecnologia de IA multimodal se torna cada vez mais madura, o HumanOmniV2 tem potencial para se tornar uma força importante na inovação dos padrões industriais. No futuro, a Alibaba pode abrir mais tecnologias relacionadas, atraindo mais desenvolvedores para seu ecossistema de IA, explorando juntos as infinitas possibilidades da IA multimodal.

github:https://github.com/HumanMLLM/HumanOmniV2

huggingface:https://huggingface.co/PhilipC/HumanOmniV2