Tencent veröffentlichte das Technologiebericht der TurboS-Technologie und offenbarte die wesentlichen Innovationen und starke Leistungsfähigkeit des Flaggschiff-Großsprachmodells TurboS.

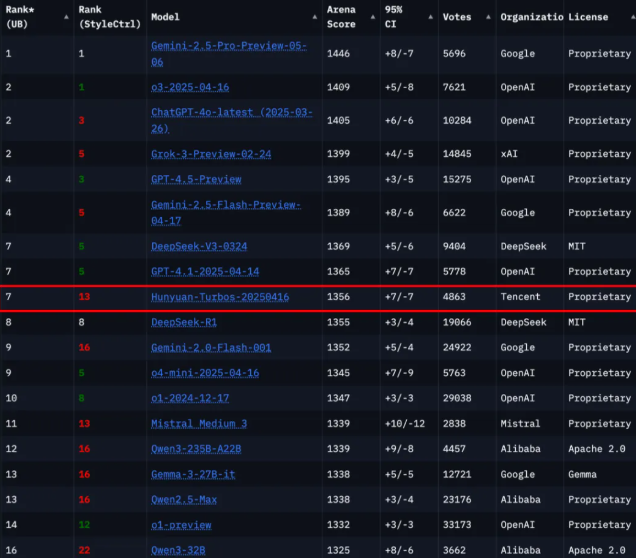

Gemäß den neuesten Rankings der weltweit renommierten Große-Modell-Bewertungsplattform Chatbot Arena rangiert die TurboS von Hunsuan auf Platz sieben unter 239 teilnehmenden Modellen und ist damit das zweitbeste Modell im Inland hinter Deepseek sowie weltweit nur hinter Google, OpenAI und xAI zurückzustellen.

Die Architektur des TurboS-Modells verwendet die innovative Hybrid-Transformer-Mamba-Architektur, die durch diese neuartige Kombination die Effizienz bei der Verarbeitung langer Sequenzen durch das Mamba-Design und die Kontextverständnisstärke des Transformer-Designs ausgleicht. Das Modell umfasst insgesamt 128 Schichten und hat eine Aktivierungsparameteranzahl von 56 Milliarden, was das erste große in der Industrie bereitgestellte Transformer-Mamba-Experten-Hybridmodell (MoE) darstellt. Dank dieser architektonischen Innovation erreichte TurboS im internationalen autoritativen Test eine Gesamtnote von 1356.

Zur weiteren Verbesserung der Modellleistung führte die TurboS von Hunsuan ein adaptives Lang-/Kurzgedankenketten-Mechanismus ein, der es dem Modell ermöglicht, basierend auf der Komplexität der Frage automatisch die Antwortmodus zu wechseln. Dieses Mechanismus sorgt dafür, dass das Modell bei einfachen Fragen schnell reagiert, während es bei komplexeren Problemen tiefergehende Analysen durchführt und hochgenaue Antworten liefert. Zusätzlich entwarf das Team einen Nachtrainingsprozess mit vier Schlüsselmodulen, einschließlich Supervised Fine-Tuning und adaptiver Lang-/Kurz-CoT-Fusion, um die Leistung des Modells weiter zu steigern.

In der Vorverarbeitungsphase wurde das TurboS-Modell mit einer Korpusgröße von 16 Billionen Tokens trainiert, um die Datenqualität und Vielfalt zu gewährleisten. Seine Kernarchitektur enthält Transformer-, Mamba2- und Feedforward-Neuralnetzwerk (FFN)-Komponenten, die in ihrer Hierarchie optimal optimiert sind, um die Effizienz bei Trainieren und Inferenz zu maximieren.

Die Veröffentlichung dieses Technologieberichts zeigt nicht nur Tencents technische Fähigkeiten im Bereich der Großsprachmodelle, sondern bietet auch neue Ansätze und Richtungen für die Zukunft der Modellentwicklung.

Papierlink: https://arxiv.org/abs/2505.15431

Herauszuschreiben:

🌟 Das TurboS-Modell rangierte auf Platz sieben in Chatbot Arena und demonstrierte seine starke Wettbewerbsfähigkeit.

💡 Die innovative Hybrid-Transformer-Mamba-Architektur erreichte den besten Ausgleich zwischen Leistung und Effizienz.

🔍 Der adaptive Lang-/Kurzgedankenketten-Mechanismus verbesserte die Reaktionsfähigkeit des Modells bei Problemen unterschiedlicher Komplexität.