Con el rápido desarrollo de las tecnologías de inteligencia artificial, el rendimiento de los grandes modelos en el campo de la ampliación de imágenes ya es asombroso, y convertir imágenes de baja resolución en imágenes de alta resolución ya no es un problema. Sin embargo, en el campo de la superresolución de videos (RealVSR), mantener la fluidez entre cuadros mientras se mejora significativamente la claridad siempre ha sido un desafío técnico. Recientemente, el marco DLoRAL desarrollado conjuntamente por la Universidad Politécnica de Hong Kong y el Instituto OPPO ha aparecido, ofreciendo una solución abierta para la digitalización de videos con su arquitectura dual LoRA innovadora y su capacidad eficiente de generación en un solo paso, lo que ha generado un gran interés en la industria. A continuación, AIbase le ofrece una interpretación exclusiva de las características y potencial de esta tecnología revolucionaria.

Enlace al proyecto: https://github.com/yjsunnn/DLoRAL

Arquitectura dual LoRA innovadora, equilibrando tiempo y espacio

El marco DLoRAL (Dual LoRA Learning) se basa en modelos de difusión preentrenados (Stable Diffusion V2.1) y logra un avance revolucionario en la superresolución de videos mediante una arquitectura dual LoRA única. Su núcleo son dos módulos LoRA diseñados específicamente:

CLoRA: se enfoca en la consistencia temporal entre los cuadros del video. Al extraer características temporales del video de entrada de baja calidad, CLoRA garantiza que las transiciones entre cuadros adyacentes sean naturales, evitando fenómenos como parpadeos o saltos comunes en métodos tradicionales.

DLoRA: se encarga de mejorar los detalles espaciales del video. DLoRA mejora significativamente la nitidez y la representación de detalles al optimizar información de alta frecuencia, otorgando a videos de baja resolución una sensación de alta definición.

Este diseño dual de LoRA desacopla los objetivos de consistencia temporal y mejora de detalles espaciales, integrando módulos ligeros en modelos de difusión preentrenados, lo que reduce el costo computacional y mejora el resultado de generación.

Estrategia de entrenamiento en dos etapas, logrando eficiencia y calidad

El proceso de entrenamiento de DLoRAL utiliza una estrategia innovadora en dos etapas, dividida en una etapa de consistencia y una etapa de mejora, optimizando alternadamente para lograr el mejor rendimiento:

Etapa de consistencia: optimiza la coherencia temporal entre cuadros mediante el módulo CLoRA y el módulo CrossFrame Retrieval (CFR), combinado con funciones de pérdida relacionadas con la consistencia. Esta etapa asegura que el video sea fluido incluso en escenas dinámicas.

Etapa de mejora: se congela CLoRA y CFR, y se enfoca en entrenar DLoRA, utilizando técnicas como la distilación de puntuaciones de clasificadores (CSD) para mejorar aún más los detalles de alta frecuencia, logrando una imagen más nítida y clara.

Este método de entrenamiento alternado permite a DLoRAL optimizar objetivos diferentes, y finalmente, en la fase de inferencia, fusiona CLoRA y DLoRA en una red UNet de difusión congelada, logrando una salida de video de alta calidad y eficiente. En comparación con métodos tradicionales de superresolución con múltiples pasos iterativos, la velocidad de inferencia de DLoRAL aumenta aproximadamente 10 veces, demostrando una ventaja sorprendente en eficiencia.

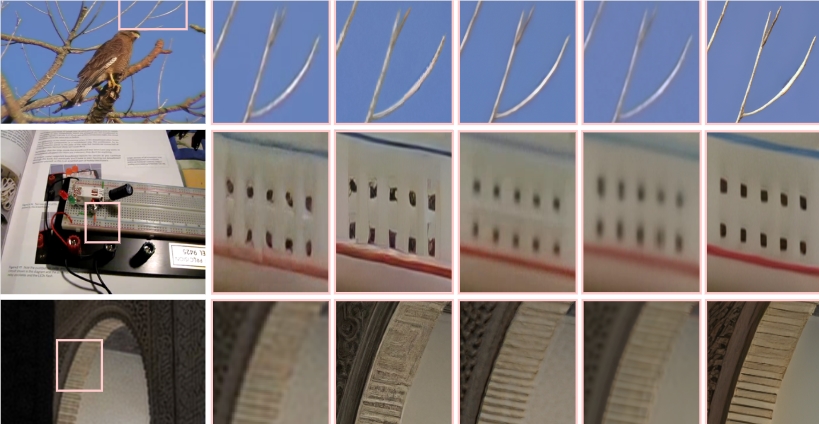

Apertura para impulsar la academia e la industria

La publicación abierta de DLoRAL trae alivio tanto a la comunidad académica como a la industria. Su código, datos de entrenamiento y modelos preentrenados fueron públicos en GitHub el 24 de junio de 2025, y la página del proyecto también incluye un video explicativo de 2 minutos detallado y una amplia gama de efectos visuales. DLoRAL no solo supera a los métodos existentes de RealVSR en términos de calidad visual, sino que también muestra un excelente rendimiento en indicadores como PSNR y LPIPS. Sin embargo, debido a que hereda el variational autoencoder (VAE) de submuestreo de 8 veces de Stable Diffusion, DLoRAL aún tiene ciertas limitaciones en la recuperación de detalles muy finos como texto pequeño, y el espacio para mejoras futuras es prometedor.

La dirección del futuro de la superresolución de videos