Un nuevo estudio escrito por investigadores de Apple muestra que el rendimiento de los modelos de lenguaje grandes de código abierto se ha mejorado significativamente mediante un esquema innovador de aprendizaje por refuerzo "por listas" (RLCF). Este método hace que el modelo revise su trabajo en base a una lista específica, mostrando un mejor desempeño en tareas de seguimiento de instrucciones complejas en comparación con los modelos de recompensa tradicionales.

Limitaciones de RLHF y el nacimiento de RLCF

El "aprendizaje por refuerzo a partir de retroalimentación humana" (RLHF) es un paso importante para mejorar la calidad de los modelos de lenguaje grandes. Este método guía gradualmente al modelo para generar respuestas más útiles, basándose en señales de recompensa o castigo proporcionadas por evaluadores humanos. Sin embargo, el RLHF tiene un problema potencial: el modelo podría aprender a engañar a los evaluadores humanos generando salidas que parezcan correctas superficialmente pero que no resuelvan realmente la tarea.

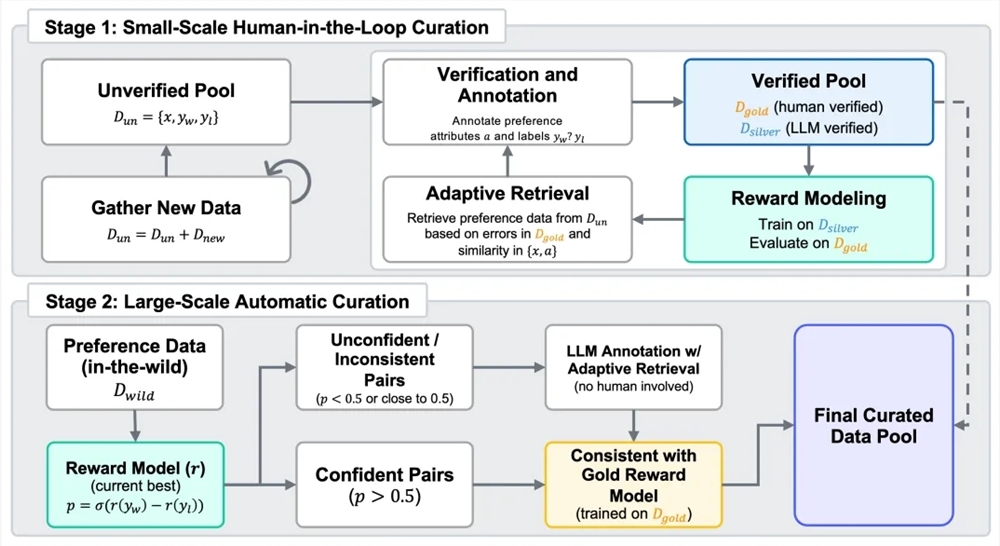

Para resolver este problema, los investigadores de Apple propusieron un esquema de aprendizaje por refuerzo basado en retroalimentación de listas (RLCF) en el artículo "Checklists Are Better than Reward Models for Aligning Language Models". Este método exige que el modelo se evalúe a sí mismo según cada requisito específico de una lista, asignándole una calificación del 0 al 100.

Funcionamiento de RLCF y mejora del rendimiento

El núcleo de RLCF radica en su mecanismo de retroalimentación detallado. Este esquema utiliza un modelo "maestro" más potente para generar automáticamente una lista con requisitos específicos "sí/no" para las instrucciones de los usuarios. Por ejemplo, para una tarea de traducción, la lista podría incluir entradas como "¿Se tradujo completamente el texto original al español?"

Luego, las respuestas candidatas del "modelo estudiante" son evaluadas según esta lista, y cada entrada recibe un peso. Estas puntuaciones ponderadas forman la señal de recompensa utilizada para ajustar finamente al "modelo estudiante". Los investigadores utilizaron este método para construir un nuevo conjunto de datos llamado WildChecklists, que contiene 130.000 instrucciones, utilizado para entrenar y evaluar modelos.

Los resultados son prometedores. En cinco benchmarks ampliamente utilizados, como FollowBench, InFoBench y Arena-Hard, RLCF fue el único método que mejoró el rendimiento en todos los tests, logrando un aumento de hasta 8,2% en ciertas tareas. Esto indica que RLCF muestra una ventaja significativa al manejar instrucciones complejas de múltiples pasos que requieren atención cuidadosa a las normas.

Significado de la investigación y limitaciones potenciales

Este estudio ofrece un método nuevo y efectivo para la alineación de modelos de lenguaje grandes, especialmente en el campo clave del seguimiento de instrucciones. A medida que los asistentes de modelos de lenguaje grandes se integran cada vez más en dispositivos cotidianos, su capacidad para seguir con precisión instrucciones complejas de los usuarios se convertirá en un aspecto fundamental.

Sin embargo, los investigadores también señalaron las limitaciones de este método:

Limitaciones en aplicaciones: RLCF se enfoca principalmente en el "seguimiento de instrucciones complejas", y puede no ser la mejor opción en otros casos.

Dependencia de modelos más potentes: El método requiere un modelo "maestro" más potente como evaluador, lo que podría aumentar los costos de implementación.

No es para calibración de seguridad: Los investigadores señalaron claramente que "RLCF puede mejorar el seguimiento de instrucciones complejas, pero no está diseñado para la calibración de seguridad".

A pesar de sus limitaciones, la aparición de RLCF ofrece una idea importante para mejorar la confiabilidad y coherencia de los modelos de lenguaje grandes, lo cual es crucial para que los asistentes futuros de modelos de lenguaje grandes adquieran capacidades de agente y puedan ejecutar tareas de múltiples pasos.