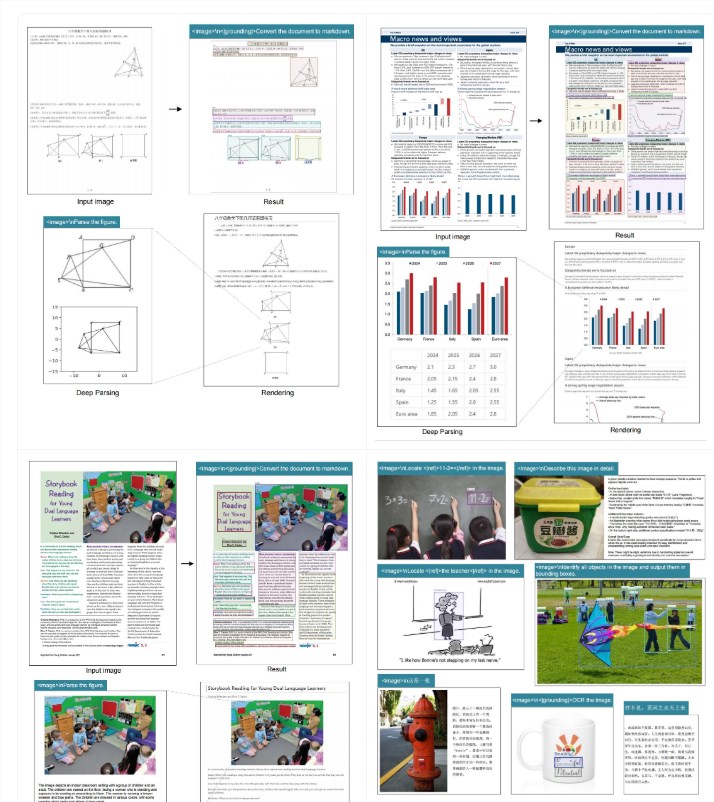

Une entreprise de technologie de l'intelligence artificielle, DeepSeek, a récemment lancé un nouveau modèle de reconnaissance optique de caractères (OCR) appelé « DeepSeek-OCR ». Ce modèle est un modèle vision-langage (VLM) à bout à bout conçu pour analyser efficacement les documents en compressant le texte long en un petit ensemble de jetons visuels, puis en les décodant à l'aide d'un modèle de langage.

L'équipe de recherche a déclaré que le modèle a atteint une précision de décodage de 97 % sur le benchmark Fox. Même lorsque le ratio des jetons de texte par rapport aux jetons visuels était de 10 fois, la précision restait bonne, et elle montrait encore des caractéristiques utiles à 20 fois de compression. En outre, DeepSeek-OCR s'est bien comporté sur le benchmark OmniDocBench, utilisant bien moins de jetons visuels que les modèles traditionnels.

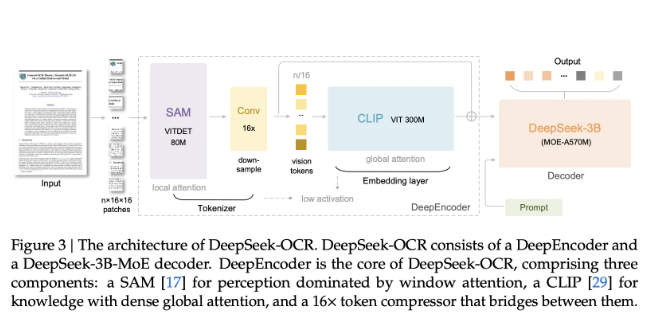

L'architecture de DeepSeek-OCR se compose de deux composants principaux : un encodeur visuel pour les entrées à haute résolution appelé DeepEncoder et un décodeur de mélange d'experts nommé DeepSeek3B-MoE-A570M. L'encodeur utilise un mécanisme d'attention de fenêtre de perception locale basé sur SAM et un algorithme de compression convolutive, qui contrôle efficacement la mémoire d'activation à haute résolution et réduit le nombre de jetons de sortie. Le décodeur est un modèle de 3 milliards de paramètres, avec environ 570 millions de paramètres actifs par jeton.

Lors de l'utilisation de différents modes, DeepEncoder fournit plusieurs options de résolution, notamment les modes Tiny, Small, Base et Large, chacun correspondant à un nombre différent de jetons visuels et de résolutions. Il existe également des modes dynamiques appelés Gundam et Gundam-Master, qui peuvent ajuster flexiblement le budget de jetons en fonction de la complexité de la page.

Pendant l'entraînement, l'équipe DeepSeek a utilisé un processus d'entraînement par phases, d'abord entraînant DeepEncoder pour la prédiction du prochain jeton, puis effectuant un entraînement complet du système sur plusieurs nœuds. Enfin, il peut générer plus de 200 000 pages de documents par jour. Pour les applications pratiques, l'équipe recommande de commencer par le mode Small, et si la page contient des petits caractères denses ou un grand nombre de jetons, le mode Gundam peut être sélectionné.

Le lancement de DeepSeek-OCR marque une avancée importante dans le domaine de l'intelligence artificielle documentaire. Son efficacité et sa flexibilité en font un outil adapté au traitement de divers types de documents.

Mémoire : https://github.com/deepseek-ai/DeepSeek-OCR/blob/main/DeepSeek_OCR_paper.pdf

Huggingface : https://huggingface.co/deepseek-ai/DeepSeek-OCR

Points clés :

🌟 DeepSeek-OCR est un nouveau modèle vision-langage de 3 milliards de paramètres, doté de capacités efficaces de OCR et d'analyse de documents.

📊 Le modèle a atteint une précision de décodage de 97 % sur le benchmark Fox et maintient de bonnes performances même avec une compression importante.

🔧 DeepEncoder propose plusieurs modes et choix de résolution pour s'adapter à différentes complexités et besoins de documents.