El equipo de procesamiento del lenguaje natural de Alibaba anunció el lanzamiento de WebWatcher, un agente inteligente de investigación profunda multimodal de código abierto, diseñado para superar las limitaciones de los sistemas cerrados actuales y los agentes de código abierto en el campo de la investigación multimodal profunda. WebWatcher, al integrar diversas herramientas como la navegación web, la búsqueda de imágenes, el intérprete de código y el OCR interno, puede manejar tareas complejas multimodales como un investigador humano, demostrando una fuerte comprensión visual, razonamiento lógico, recuperación de conocimientos, programación de herramientas y capacidad de validación propia.

El equipo de desarrollo de WebWatcher señaló que aunque los sistemas cerrados actuales, como DeepResearch de OpenAI, muestran un buen rendimiento en investigación textual profunda, la mayoría están limitados al entorno de texto puro y tienen dificultades para manejar imágenes, gráficos y contenido mixto del mundo real. Por otro lado, los agentes de código abierto también enfrentan dos cuellos de botella: uno es el agente enfocado en la recuperación de texto, que puede integrar información pero no puede manejar imágenes; otro es el agente visual, que puede identificar imágenes pero carece de capacidad de razonamiento entre modalidades y colaboración de múltiples herramientas. WebWatcher fue diseñado específicamente para resolver estos cuellos de botella.

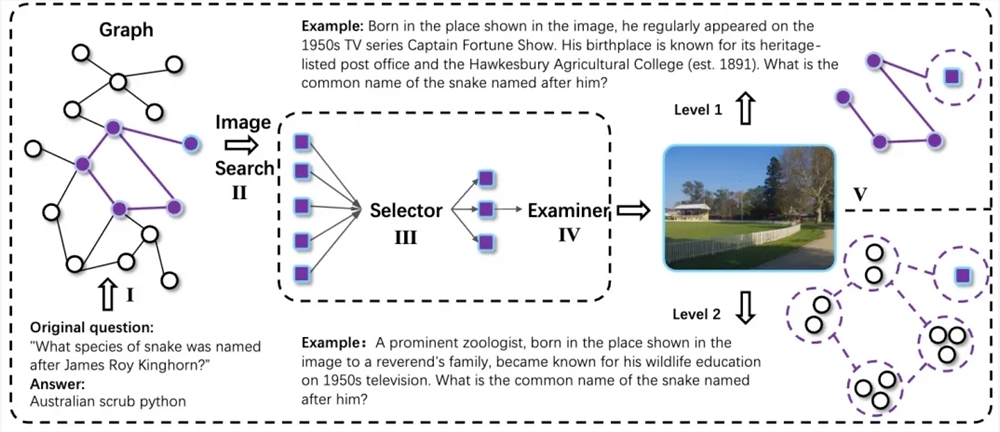

La solución técnica de WebWatcher abarca toda la cadena desde la construcción de datos hasta la optimización del entrenamiento. Su objetivo principal es permitir que los agentes multimodales tengan flexibilidad para razonar y colaborar con múltiples herramientas en tareas de investigación multimodal de alta dificultad. Para ello, el equipo de investigación diseñó un proceso automático de generación de datos multimodales, recolectando cadenas de conocimiento transmodal mediante caminatas aleatorias y introduciendo tecnologías de difuminación de información para aumentar la incertidumbre y complejidad de las tareas. Todos los ejemplos de problemas complejos se expandieron a versiones multimodales mediante el módulo QA-to-VQA, mejorando aún más la capacidad del modelo para comprender entre modalidades.

En cuanto a la construcción de trayectorias de razonamiento de alta calidad y la posterior formación, WebWatcher utilizó un método de generación de trayectorias basado en Action-Observation, recopilando trayectorias reales de interacción con múltiples herramientas y realizando ajuste fino supervisado (SFT), para que el modelo adquiera rápidamente los patrones básicos de razonamiento ReAct multimodal y llamada de herramientas en etapas iniciales de entrenamiento. Posteriormente, el modelo entra en una fase de aprendizaje por refuerzo, mejorando aún más la capacidad de toma de decisiones del agente multimodal en entornos complejos mediante GRPO.

Para validar completamente las capacidades de WebWatcher, el equipo de investigación propuso BrowseComp-VL, una versión ampliada de BrowseComp para tareas de visión-lenguaje, con el objetivo de acercarse al nivel de dificultad de las tareas de investigación transmodal de expertos humanos. En evaluaciones estrictas en múltiples rondas, WebWatcher superó ampliamente a los modelos actuales de gran tamaño multimodal de código abierto y cerrado en tareas como razonamiento complejo, recuperación de información, integración de conocimientos y optimización de información agrupada.

Concretamente, en el benchmark HLE-VL, un examen multietapa de razonamiento complejo, WebWatcher obtuvo un puntaje de Pass@1 del 13,6%, superando ampliamente a modelos representativos como GPT-4o (9,8%), Gemini2.5-flash (9,2%) y Qwen2.5-VL-72B (8,6%). En la evaluación MMSearch, que es más cercana a la búsqueda multimodal real, WebWatcher alcanzó un puntaje de Pass@1 del 55,3%, superando significativamente a Gemini2.5-flash (43,9%) y GPT-4o (24,1%). En la evaluación LiveVQA, el puntaje de Pass@1 de WebWatcher fue del 58,7%, superando a otros modelos principales. En el benchmark más desafiante BrowseComp-VL, WebWatcher obtuvo un promedio de puntuación del 27,0% (Pass@1), superando a otros modelos en más del doble.

Dirección del repositorio: https://github.com/Alibaba-NLP/WebAgent