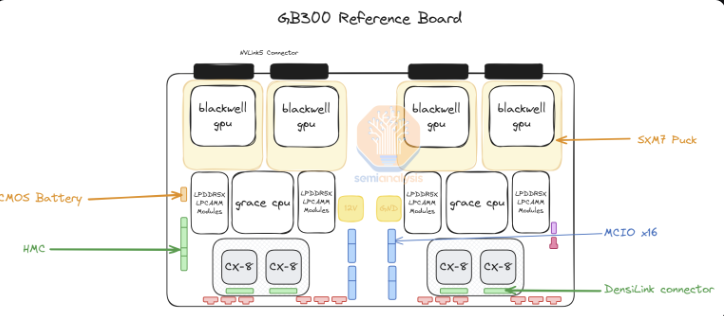

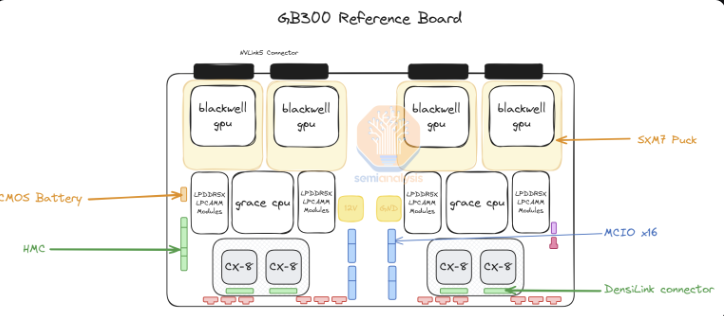

英伟达在GB200和B200发布仅6个月后,再次推出全新GPU——GB300和B300。这看似只是小幅升级,实则蕴含着巨大的变革,尤其是推理模型性能的显著提升,将给整个行业带来深远的影响。

英伟达在GB200和B200发布仅6个月后,再次推出全新GPU——GB300和B300。这看似只是小幅升级,实则蕴含着巨大的变革,尤其是推理模型性能的显著提升,将给整个行业带来深远的影响。

欢迎来到【AI日报】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。

AI 编程公司 Replit 近日成功完成了一轮2.5亿美元的 C 轮融资,使其估值达到了约30亿美元。这一消息反映了投资者对利用人工智能推动软件开发公司的浓厚兴趣。在过去一年中,Replit 的年收入从280万美元飙升至1.5亿美元,目前用户数量已达到4000万,显示出其在市场中的快速增长势头。图源备注:图片由AI生成,图片授权服务商Midjourney此次融资由 Prysm Capital 主导,参与投资的还有 Amex Ventures 和谷歌的 AI Futures Fund。此外,Replit 的现有投资者,包括 Y Combinator、Craft Ventures、Andreessen Horowitz、Coatue

快手推出的 Kwali AI 视频制作助手通过云端多 Agent 框架,简化了视频制作流程。用户只需输入需求,Kwali 即可自动拆解卖点、受众和情境标签,并生成脚本、匹配镜头、剪辑合成,大幅提升了效率。

9月11日,腾讯优图实验室开源了Youtu-GraphRAG,这是一个全新的图检索增强生成框架,旨在通过大语言模型+RAG模式,将知识组织成图谱,再交给大语言模型进行检索和推理,从而提高模型在处理复杂问答任务时的准确性和可追溯性。Youtu-GraphRAG特别适用于企业知识库问答、科研文档解析、个人知识管理等知识密集型场景。 Youtu-GraphRAG通过

Replit,作为广受开发者欢迎的在线编程平台,近日宣布推出其全新产品——Agent3,一款具备更高自主性的智能编程助手。相较于前代产品,Agent3在代码生成、调试和项目管理方面的能力显著提升,据称其自主性较之前提高了10倍。Agent3:更智能、更自主的编程伙伴根据Replit在X平台发布的消息,Agent3是一款基于先进大语言模型打造的AI编程助手,相较于此前的版本,其自主性得到了大幅提升。Agent3不仅能够根据用户输入的自然语言需求生成代码,还能主动分析项目上下文,提出优化建议,甚至

近日,哔哩哔哩(B 站)Index 团队宣布全面开源其自主研发的文本转语音(TTS)系统 ——IndexTTS-2.0。该系统具有情感可控和时长可调的特点,标志着零样本 TTS 技术的实用化迈出了重要一步。在语音合成领域,时长控制和情感表达一直是行业内的技术难题。为了克服这些问题,IndexTTS-2.0引入了两项核心创新:首先是时间编码机制。这一机制在自回归 TTS 架构中首次应用,极大提升了语音时长控制的精度,使得生成的语音更加稳定和自然,语音节奏得以精准调控。其次是音色与情感解耦建模。该系

在人工智能领域,尤其是在大规模语言模型(LLM)的推理与训练中,模型权重的实时更新一直是一个技术挑战。最近,月之暗面(MoonshotAI)开源了一个名为 “Checkpoint Engine” 的新中间件,专为 LLM 推理引擎而设计。这一创新工具的发布,标志着在强化学习等应用场景中,模型的权重可以实现更为高效的原地热更新。“Checkpoint Engine” 具备了惊人的性能,可以在大约20秒内完成对1万亿参数的 Kimi-K2模型的权重同步。更令人惊讶的是,这一过程可以在数千个 GPU 上同时进行,大大降低了强化学习训

9月11日,在2025Inclusion·外滩大会开幕主论坛上,源码资本投资合伙人、美国国家工程院外籍院士张宏江分享了他对于大语言模型、AI 智能体和智能体经济的思考。他表示,大模型的“规模定律(Scaling Law)”仍然有效,而智能体与经济结构转型将深刻重塑社会。规模定律被看作大模型性能提升的第一性原则,即大模型参数越高,性能就越好。虽然业界认为预训练模型的规模定律在逐渐放缓,但张宏江特别指出,推理模型的出现,塑造了大规模发展的新曲线——“推理规模定律(reasoning scali

随着人工智能技术的不断发展,如何开发能够独立完成复杂任务的大规模语言模型(LLM)代理,已成为研究的热点。为了让这些代理像人类一样,通过探索和与环境互动来学习,研究者们需要一个强大而统一的强化学习(RL)框架。然而,目前的研究中,尚缺乏一种有效的训练方法,能够在多样化的真实环境中,从零开始训练代理,而不依赖于监督微调(SFT)。为了解决这一问题,字节跳动Seed研究团队推出了名为 AgentGym-RL 的新框架,专注于通过强化学习训练 LLM 代理,使其能够进行多轮互动

前OpenAI首席技术官Mira Murati创办的Thinking Machines Lab近日发布重要技术突破,成功解决了困扰AI行业多年的模型输出不确定性问题。该实验室在最新发布的研究报告中宣布,他们已经实现了大语言模型推理过程的完全确定性输出。这项名为《在LLM推理中战胜不确定性》的研究报告指出,即使在温度参数设为0的情况下,传统大语言模型仍会对相同输入产生不同输出。研究团队通过深入分析发现了造成这一现象的根本原因,并提出了有效的解决方案。研究团队识别出两个主要的技术原因。首先是

硅谷最神秘的AI实验室终于撕开了面纱的一角。自从前OpenAI首席技术官Mira Murati带着 20 亿美元的惊人种子资金和一众顶级研究人员创立思维机器实验室以来,整个科技圈都在屏息以待,想要一探这个全明星团队究竟在酝酿什么样的技术革命。现在,答案开始浮出水面。周三,思维机器实验室在其全新发布的研究博客上抛出了一个令人震撼的研究方向:他们正在试图彻底解决AI模型回答不可预测的根本问题。这个看似简单的技术挑战背后,却隐藏着可能颠覆整个AI行业的深远影响。每一个使用