Google a récemment fait un nouveau pas en avant dans le domaine de l'IA en lançant son dernier modèle, Gemini 1.5. Cette version comprend une variante plus légère, Gemini 1.5 Flash-8B, ainsi que Gemini 1.5 Flash et Gemini 1.5 Pro, tous deux « significativement améliorés ».

Selon Google, les performances ont été améliorées par rapport à de nombreux tests internes. Gemini 1.5 Flash a bénéficié d'une « énorme amélioration » de ses performances globales, tandis que 1.5 Pro se montre bien meilleur en mathématiques, en codage et pour les invites complexes.

Logan Kilpatrick, responsable des produits IA chez Google, a déclaré sur les réseaux sociaux : « Gemini 1.5 Flash est désormais le meilleur choix pour les développeurs du monde entier ! » Les modèles de la série Gemini 1.5 sont capables de traiter de longs textes et peuvent effectuer des raisonnements sur plus de 10 millions de jetons d'informations, ce qui leur permet de gérer un grand nombre d'entrées multimodales, telles que des documents, des vidéos et des audios.

« Dernière itération expérimentale » du modèle Gemini

Google a lancé Gemini 1.5 Flash, une version légère de Gemini 1.5, en mai. Les modèles de la série Gemini 1.5 sont conçus pour gérer les longs contextes et peuvent effectuer des raisonnements sur des informations granulaires provenant de 10 millions de jetons et plus. Cela permet aux modèles de traiter de grandes quantités d'entrées multimodales, notamment des documents, des vidéos et des audios.

Google a cette fois-ci lancé une version allégée de Gemini 1.5 Flash avec 8 milliards de paramètres. Le nouveau Gemini 1.5 Pro présente des améliorations notables en termes de codage et de traitement des invites complexes. Kilpatrick a indiqué que Google lancerait une version prête pour la production dans les prochaines semaines et espère proposer davantage d'outils d'évaluation.

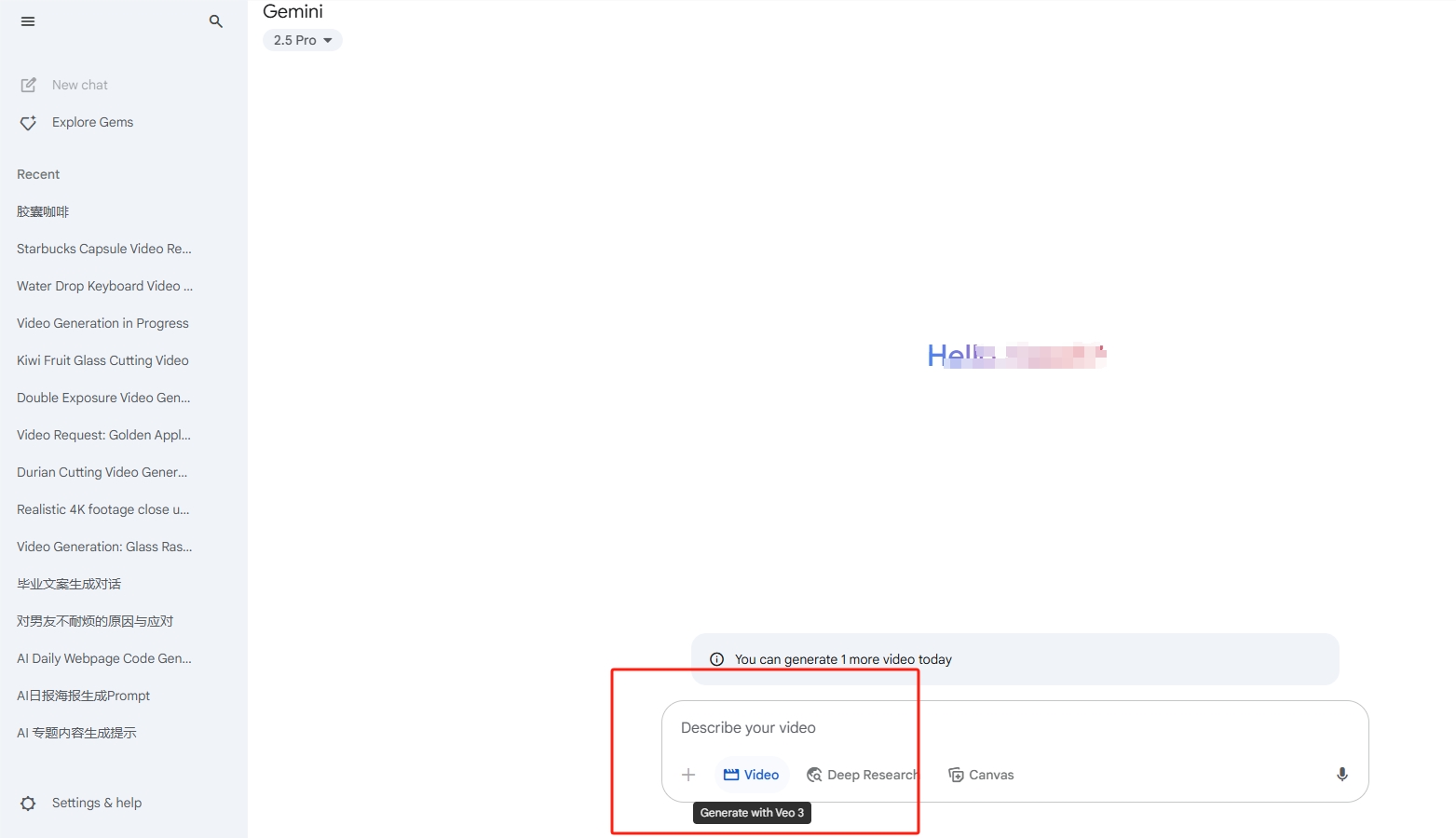

Selon Kilpatrick, le lancement de ces modèles expérimentaux vise à recueillir des commentaires afin de fournir plus rapidement les dernières mises à jour aux développeurs. Il a révélé que les nouveaux modèles seraient mis gratuitement à la disposition des développeurs pour des tests via Google AI Studio et l'API Gemini, et qu'ils seraient également disponibles ultérieurement via les points de terminaison expérimentaux de Vertex AI.

Quelques heures seulement après sa sortie, l'organisation Large Model Systems Organization (LMSO) a publié une mise à jour de son classement des chatbots, basée sur 20 000 votes de la communauté. Gemini 1.5-Flash a réalisé un « bond énorme », passant de la 23e à la 6e place, au même niveau que Llama, surpassant ainsi le modèle ouvert Gemma de Google.

À partir du 3 septembre, Google redirigera automatiquement les requêtes vers le nouveau modèle et supprimera les anciennes versions afin d'éviter toute confusion. Kilpatrick se montre enthousiaste quant à ce nouveau modèle et espère voir les développeurs l'utiliser pour créer davantage d'applications multimodales.

Cependant, avec le lancement du nouveau modèle, les premiers retours sont mitigés. Certains utilisateurs se montrent perplexes face à la fréquence des mises à jour, estimant que les utilisateurs attendent plutôt une version Gemini 2.0 plus complète. Parallèlement, d'autres utilisateurs saluent la rapidité et les performances des mises à jour, considérant que cela permet à Google de conserver son avance dans le domaine de l'IA.

Points clés :

✨ Les nouveaux modèles de la série Gemini 1.5 présentent des améliorations significatives en mathématiques, en programmation et pour les invites complexes.

🚀 Gemini 1.5 Flash peut traiter plus de 10 millions de jetons d'entrées multimodales, ce qui lui confère une grande adaptabilité.

🛠️ Les retours des utilisateurs sont mitigés : certains attendent une mise à niveau complète avec Gemini 2.0, tandis que d'autres apprécient les mises à jour actuelles.