Récemment, Answer.AI et LightOn ont conjointement publié ModernBERT, un modèle linguistique open source représentant une amélioration significative de BERT de Google. Selon les développeurs, ModernBERT offre des améliorations notables en termes de vitesse de traitement, d'efficacité et de qualité. Ce modèle est quatre fois plus rapide que son prédécesseur tout en utilisant moins de mémoire.

ModernBERT est conçu pour traiter des textes jusqu'à 8192 jetons, soit 16 fois plus que la limite typique de 512 jetons des modèles d'encodage existants. De plus, ModernBERT est le premier modèle d'encodage de code de programmation largement entraîné, obtenant un score supérieur à 80 sur l'ensemble de données de questions-réponses StackOverflow, établissant un nouveau record pour les modèles d'encodage.

Dans l'évaluation de la compréhension du langage généralisé (GLUE), ModernBERT-Large a atteint le meilleur équilibre entre vitesse et précision de traitement, avec un temps de traitement d'environ 20 millisecondes par jeton et un score de 90. L'équipe de développement compare ModernBERT à une Honda Civic optimisée, soulignant sa fiabilité et son efficacité dans les applications quotidiennes.

Comparé aux grands modèles linguistiques existants tels que GPT-4, ModernBERT réduit considérablement les coûts de traitement de texte à grande échelle. GPT-4 coûte quelques centimes par requête, tandis que ModernBERT peut fonctionner localement, plus rapidement et plus économiquement. Par exemple, le projet FineWeb Edu a dépensé 60 000 dollars pour filtrer 15 milliards de jetons en utilisant le modèle BERT, tandis que même avec le décodeur Gemini Flash de Google, les coûts dépassaient 1 million de dollars.

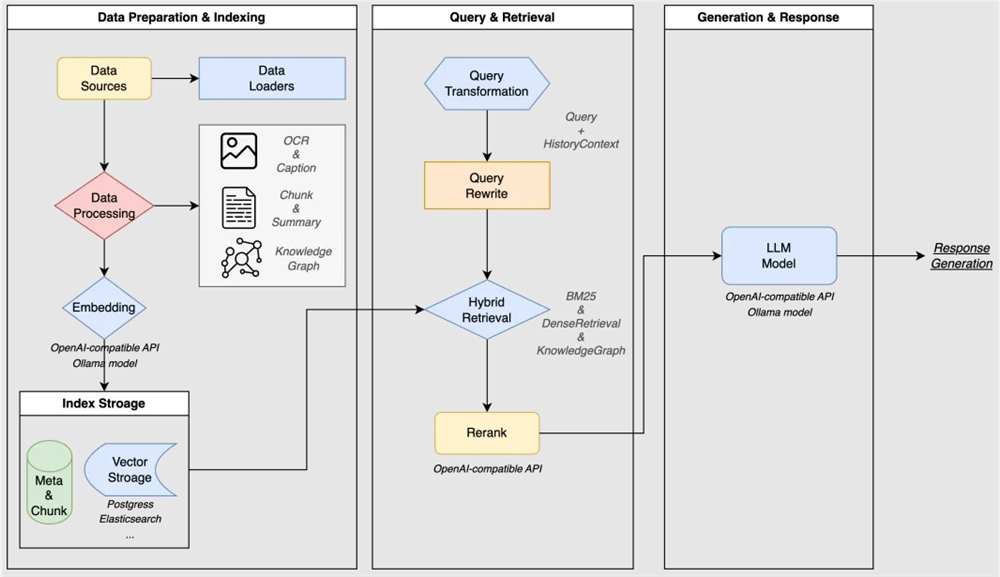

L'équipe de développement indique que ModernBERT est parfaitement adapté à diverses applications pratiques, notamment les systèmes de génération améliorée par la recherche (RAG), la recherche de code et la modération de contenu. Contrairement à GPT-4 qui nécessite un matériel spécialisé, ModernBERT peut fonctionner efficacement sur un GPU de jeu grand public.

Actuellement, ModernBERT est disponible en deux versions : un modèle de base contenant 139 millions de paramètres et un modèle large contenant 395 millions de paramètres. Les deux versions sont désormais disponibles sur Hugging Face, et les utilisateurs peuvent les remplacer directement par les modèles BERT existants. L'équipe de développement prévoit de lancer des versions plus importantes l'année prochaine, mais n'envisage pas de capacités multimodales. Pour encourager le développement de nouvelles applications, ils ont également lancé un concours qui récompensera les cinq meilleures démonstrations par 100 dollars et un abonnement professionnel Hugging Face de six mois.

Depuis le lancement de BERT par Google en 2018, ce modèle est l'un des modèles linguistiques les plus populaires, avec plus de 68 millions de téléchargements par mois sur HuggingFace.

Accès au projet : https://huggingface.co/blog/modernbert

Points clés :

🌟 ModernBERT est quatre fois plus rapide que BERT et peut traiter jusqu'à 8192 jetons.

💰 Par rapport à GPT-4, ModernBERT réduit considérablement les coûts de traitement de texte à grande échelle et est plus efficace.

📊 Ce modèle est particulièrement performant pour le traitement de code de programmation, obtenant un score supérieur à 80 sur l'ensemble de données de questions-réponses StackOverflow, établissant un nouveau record.