Vous avez entendu parler d'OpenAI Sora, le modèle vidéo hors de prix ? Avec un coût de formation s'élevant à plusieurs millions de dollars, il s'agit véritablement de la « Rolls-Royce » de la génération vidéo. Aujourd'hui, Luojian Technology annonce la sortie de son modèle de génération vidéo open source Open-Sora 2.0 !

Pour seulement 200 000 dollars (l'équivalent de 224 GPU), une version commerciale d'un grand modèle de génération vidéo avec 11 milliards de paramètres a été entraînée avec succès.

Des performances qui rivalisent avec « OpenAI Sora »

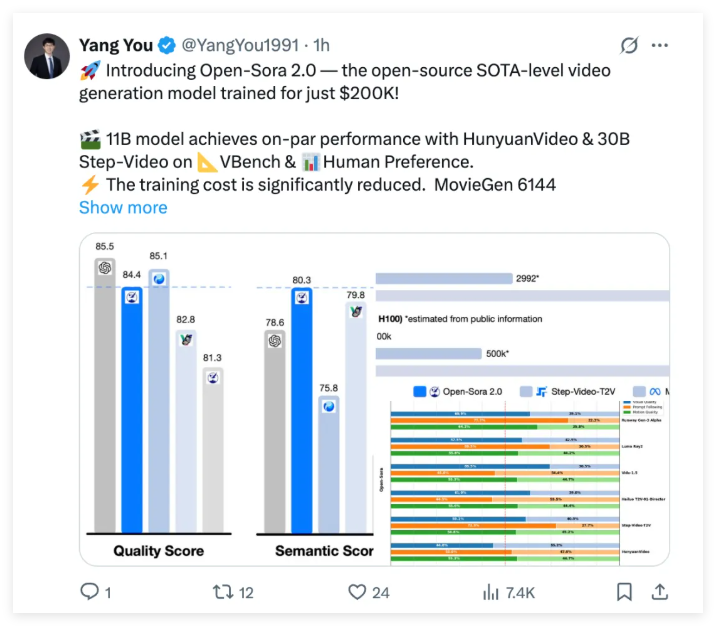

Ne vous laissez pas tromper par son faible coût ; Open-Sora 2.0 n'a rien à envier à ses concurrents. Il ose défier les leaders du secteur tels que HunyuanVideo et Step-Video (300 milliards de paramètres). Lors de tests d'évaluation officiels (VBench) et de tests de préférence utilisateur, Open-Sora 2.0 a impressionné, atteignant des performances comparables à celles des modèles propriétaires entraînés pour plusieurs millions de dollars sur plusieurs critères clés.

Plus impressionnant encore, l'écart de performance entre Open-Sora 2.0 et OpenAI Sora, initialement de 4,52 %, a été considérablement réduit à seulement 0,69 % lors des évaluations VBench ! On peut presque parler d'une égalité de performances !

De plus, Open-Sora 2.0 a même surpassé HunyuanVideo de Tencent au VBench. Une véritable illustration de « l'arrivée de la nouvelle génération », atteignant des performances supérieures à moindre coût et établissant une nouvelle référence pour les technologies de génération vidéo open source !

Dans les tests de préférence utilisateur, Open Sora a surpassé le modèle open source SOTA HunyuanVideo et le modèle commercial Runway Gen-3Alpha sur au moins deux critères clés : rendu visuel, cohérence du texte et qualité des mouvements.

Le secret d'un rapport coût-efficacité exceptionnel

Vous vous demandez sans doute comment Open-Sora 2.0 a pu atteindre de telles performances à un coût aussi bas ? Plusieurs éléments expliquent ce succès. Tout d'abord, l'équipe Open Sora a repris l'architecture du modèle Open-Sora 1.2, en utilisant toujours un encodeur 3D et un cadre d'entraînement par correspondance de flux. Parallèlement, ils ont introduit un mécanisme d'attention globale 3D, améliorant ainsi la qualité de la génération vidéo.

Pour optimiser les coûts au maximum, Open-Sora 2.0 a été optimisé à plusieurs niveaux :

- Sélection rigoureuse des données : garantie de données d'entraînement de haute qualité pour une efficacité optimale dès la source.

- Entraînement prioritaire à basse résolution : apprentissage efficace des informations de mouvement, réduction des coûts de calcul. Il est important de noter que le coût d'un entraînement haute résolution est plusieurs dizaines de fois supérieur à celui d'un entraînement basse résolution !

- Entraînement prioritaire des tâches d'image vers vidéo : accélération de la convergence du modèle et réduction des coûts d'entraînement. De plus, en phase d'inférence, il est possible d'utiliser une approche texte vers image vers vidéo (T2I2V) pour obtenir des effets visuels plus précis.

- Solution d'entraînement parallèle efficace : combinaison de ColossalAI et d'optimisations au niveau du système pour améliorer considérablement l'utilisation des ressources de calcul. Des technologies de pointe telles que le parallélisme de séquences efficace et ZeroDP, le Gradient Checkpointing à grain fin et le mécanisme de reprise automatique de l'entraînement ont permis d'améliorer considérablement l'efficacité de l'entraînement.

On estime que le coût d'entraînement unique des modèles vidéo open source de plus de 10 milliards de paramètres dépasse facilement le million de dollars. Open Sora 2.0 a réduit ce coût de 5 à 10 fois. C'est une véritable aubaine pour le secteur de la génération vidéo, permettant à davantage de personnes de participer à la recherche et au développement de vidéos de haute qualité.

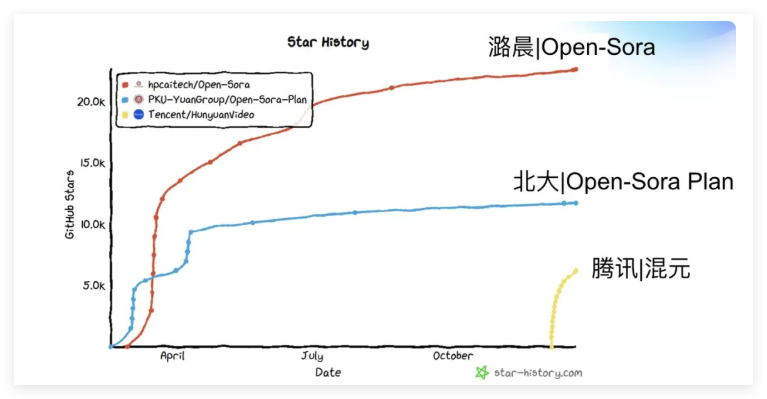

Open source et partage pour un écosystème florissant

Plus remarquable encore, Open-Sora a non seulement publié le code et les poids du modèle en open source, mais également le code d'entraînement complet. Cela contribuera grandement au développement de l'écosystème open source. Comme le montrent les statistiques des plateformes technologiques tierces, les citations de l'article scientifique sur Open-Sora ont atteint près de 100 en six mois, et il occupe une place de choix dans le classement mondial de l'influence open source, devenant l'un des projets de génération vidéo open source les plus influents au monde.

L'équipe Open-Sora explore également activement les applications des encodeurs vidéo auto-encodeurs à haut taux de compression afin de réduire considérablement les coûts d'inférence. Ils ont entraîné un auto-encodeur vidéo à haut taux de compression (4×32×32), réduisant le temps d'inférence d'une vidéo de 768 px et de 5 secondes sur une seule carte de près de 30 minutes à moins de 3 minutes, soit une amélioration de la vitesse d'un facteur 10 ! Cela signifie que nous pourrons générer des contenus vidéo de haute qualité plus rapidement à l'avenir.

Le modèle de génération vidéo open source Open-Sora 2.0 de Luojian Technology, grâce à ses caractéristiques de faible coût, hautes performances et open source complet, apporte un vent de fraîcheur « abordable » au secteur de la génération vidéo. Son apparition a non seulement réduit l'écart avec les meilleurs modèles propriétaires, mais a également abaissé le seuil de la génération vidéo de haute qualité, permettant à davantage de développeurs d'y participer et de contribuer ensemble au développement de la technologie de génération vidéo.

🔗 Dépôt GitHub : https://github.com/hpcaitech/Open-Sora

📄Rapport technique : https://github.com/hpcaitech/Open-Sora-Demo/blob/main/paper/Open_Sora_2_tech_report.pdf