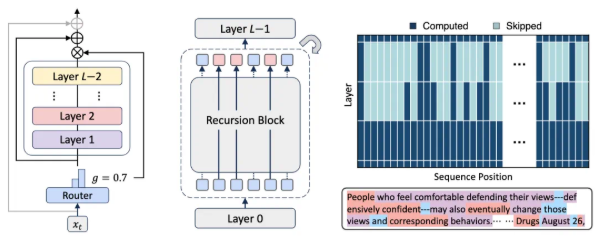

Große Sprachmodelle (LLMs) und die Technik der Denkketten-Prompts (Chain-of-Thought, CoT) haben in NLP-Aufgaben erhebliche Fortschritte erzielt. Forschungen zeigen die entscheidende Rolle der Länge der Inferenzkette für die Leistung von CoT auf. Experimentelle Ergebnisse zeigen einen klaren Zusammenhang zwischen der Länge der Inferenzkette und den Fähigkeiten großer Sprachmodelle innerhalb eines bestimmten Bereichs.

Große Sprachmodelle und Chain-of-Thought-Prompting: Fortschritte in NLP-Aufgaben

站长之家

Dieser Artikel stammt aus dem AIbase-Tagesbericht

Willkommen im Bereich [KI-Tagesbericht]! Hier ist Ihr Leitfaden, um jeden Tag die Welt der künstlichen Intelligenz zu erkunden. Jeden Tag präsentieren wir Ihnen die Hotspots im KI-Bereich, konzentrieren uns auf Entwickler und helfen Ihnen, technologische Trends zu erkennen und innovative KI-Produktanwendungen zu verstehen.