大規模言語モデル(LLM)と思考連鎖(CoT)プロンプト技術は、自然言語処理(NLP)タスクにおいて大きな進歩をもたらしました。研究により、推論チェーンの長さがCoTのパフォーマンスに重要な役割を果たしていることが明らかになりました。

実験結果から、ある範囲内では、推論チェーンの長さと大規模言語モデルの能力間に明確な相関関係があることが示されました。

大規模言語モデル(LLM)と思考連鎖(CoT)プロンプト技術は、自然言語処理(NLP)タスクにおいて大きな進歩をもたらしました。研究により、推論チェーンの長さがCoTのパフォーマンスに重要な役割を果たしていることが明らかになりました。

実験結果から、ある範囲内では、推論チェーンの長さと大規模言語モデルの能力間に明確な相関関係があることが示されました。

【AIデイリー】へようこそ!ここは、毎日人工知能の世界を探求するためのガイドです。毎日、開発者に焦点を当て、技術トレンドを洞察し、革新的なAI製品アプリケーションを理解するのに役立つ、AI分野のホットなコンテンツをお届けします。

浙江大学のTestSprite2.0は、30分でバグなしサイトを自動生成可能なAIテストプラットフォーム。コード精度93%、AIプログラミング向けに自動テスト/デバッグ機能を搭載。6000チームが採用し、開発プロセスを革新。....

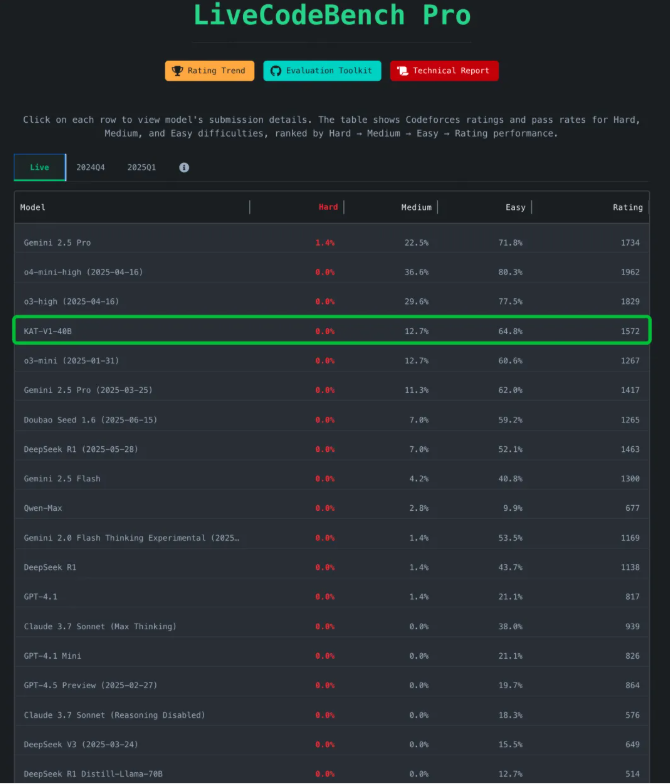

快手がオープンソースしたKAT-V1自動思考大モデルには、40Bおよび200Bの2つのバージョンが含まれます。40BバージョンのパフォーマンスはDeepSeek-R1に近づき、200Bバージョンはいくつかのエリートモデルを上回っています。このモデルは、長所と短所の混合トレーニングアプローチとStep-SRPO強化学習アルゴリズムを独自に採用しており、問題の複雑さに応じて自動的に思考モードを調整し、過度な思考の問題を解決できます。Qwen2.5-32Bに基づき、異質蒸留フレームワークと1000万個の例を用いた前訓練により、科学やコードなどの分野で優れた性能を発揮します

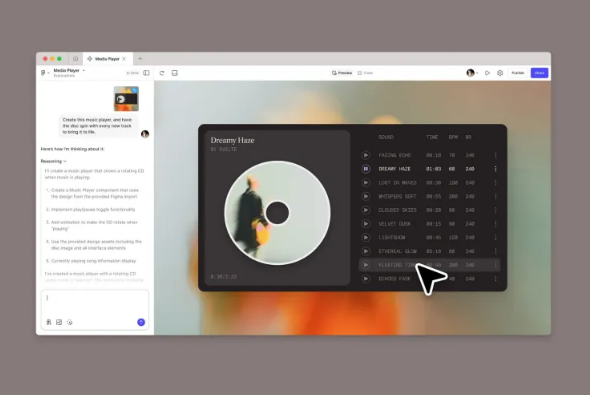

FigmaがAIデザインツール「Figma Make」を全面公開。自然言語でアプリ原型を生成可能。基本機能は無料で利用可だが、全機能は有料プランが必要。AI生成の参考画像アップロードや編集機能も提供。AI利用にクレジット制を導入、有料会員は無制限。画像生成・編集などAI機能も統合し、デザイン支援エコシステムを構築。....

調査によると、アメリカ人の約1/3がChatGPTなどのAIツールをキャリアチェンジに利用。Z世代の57%が転職を検討、AIは履歴書作成(43%)や求人調査(47%)に活用されるが、60%は人間のアドバイザーをより信頼。専門家は5年以内にAIが事務職の半数を代替すると予測。....

Googleが革新的なノーコードAI開発ツール「Opal」を発表。自然言語でAIミニアプリを作成可能。Geminiモデルを活用し、画像処理やコンテンツ作成を自動化。技術的障壁を大幅に低減し、教育・マーケティング分野での活用が見込まれる。現在米国でβテスト中。....

Googleの専門家がAI技術が検索に深く統合されているがSEOの基本は変わらないと指摘。AIは既存のSEO戦略に影響せず、コンテンツの質が重要。AI要約機能で通常の検索結果のクリック率が15%から8%に低下。....

ホワイトハウスはAIの「覚醒」傾向を回避するよう要請。トランプ氏は政府調達AIの中立性を義務付ける大統領令に署名。批判的人種理論などのイデオロギー禁止、歴史的・科学的客観性を優先。120日以内に施行細則を発表予定。....