Das Xiaomi-Modell-Team kündigte die Open-Source-Veröffentlichung des neuesten Multimodal-Modells der nächsten Generation, Xiaomi MiMo-VL-7B-2508, an, das zwei Versionen mit RL und SFT enthält.

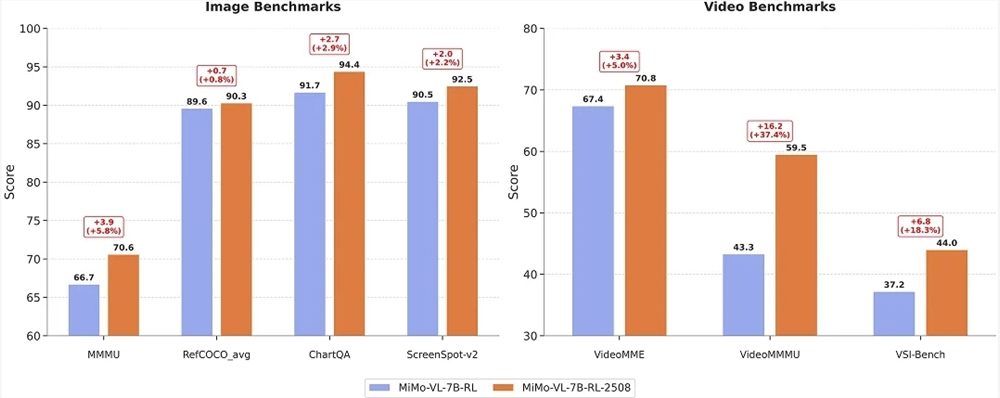

Laut offiziellen Daten erreicht die neue Modellversion in vier Kerneigenschaften – Fachschlussfolgerung, Dokumentenverstehen, Grafik-Interface-Positionierung und Videoverstehen – neue Rekorde. Dabei überschritt die MMMU-Benchmark erstmals die 70-Punkte-Marke, ChartQA stieg auf 94,4, ScreenSpot-v2 erreichte 92,5 und VideoMME stieg auf 70,8.

Diese Iteration verbesserte die Stabilität des Verstärkungslernens und den Prozess der überwachten Feinabstimmung, wodurch das Modell in der internen VLM Arena von 1093,9 auf 1131,2 anstieg.

Besonders auffällig ist, dass Benutzer durch den Befehl „/no_think“ bei Fragen zwischen dem „Denkmodus“ und dem „Nicht-Denkmodus“ wechseln können: Der erste zeigt die gesamte Schlussfolgerungskette an und hat eine Erfolgsrate von 100 %, während der zweite direkt eine Antwort generiert, schneller reagiert und eine Erfolgsrate von 99,84 % hat.

MiMo-VL-7B-RL-2508

Empfohlen wird dieses Modell für die meisten Benutzererfahrungen.

Open-Source-Adresse: https://huggingface.co/XiaomiMiMo/MiMo-VL-7B-RL-2508

MiMo-VL-7B-SFT-2508

Benutzer können basierend auf ihren tatsächlichen Anforderungen dieses Modell für SFT und RL verwenden. Im Vergleich zur vorherigen SFT-Version hat dieses Modell eine höhere RL-Stabilität.

Open-Source-Adresse: https://huggingface.co/XiaomiMiMo/MiMo-VL-7B-SFT-2508