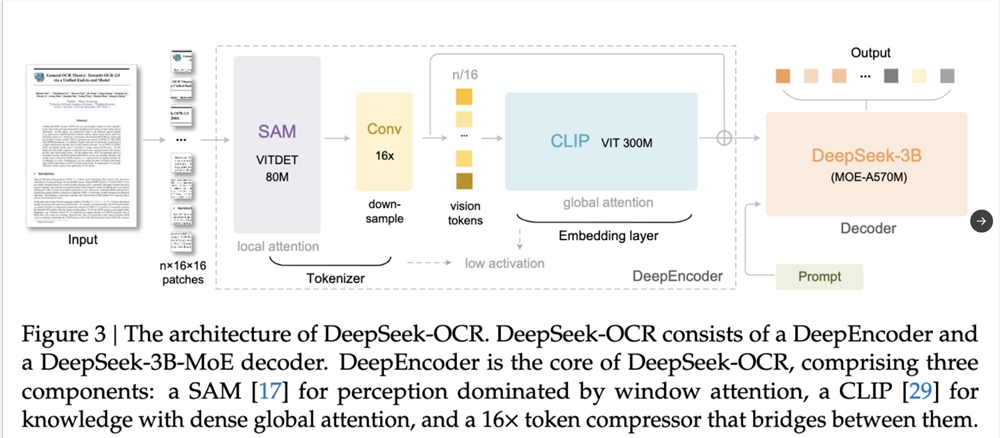

Kürzlich hat DeepSeek ein neues OCR-Dokumentverstehensmodell namens DeepSeek-OCR veröffentlicht. Dieses Modell erreicht nicht nur eine führende Leistung bei der Analyse von Bilddokumenten, sondern führt auch einen mutigen und innovativen Konzept ein: die "Visuelle Gedächtniskompression", um das Problem der explosiven Zunahme von Rechenressourcen bei großen Sprachmodellen (LLM) beim Verarbeiten von sehr langen Kontexten revolutionär zu lösen.

Meilenstein: AI „Bildlesen“ mit effizienter Kompression

Der Kern des DeepSeek-OCR-Modells besteht darin, den menschlichen visuellen Gedächtnisprozess nachzuahmen, indem lange Textinformationen in den Bildraum komprimiert werden, wodurch sich die Verbrauch von „Tokens“ im Sprachmodell erheblich reduziert.

Erklärung des Funktionsprinzips:

Dieses Mechanismus funktioniert dadurch, dass Text in Bilder umgewandelt wird: Zuerst wird der lange Text in ein einzelnes Bild komprimiert; dann wird dieses Bild durch ein visuelles Modell auf die geringste Anzahl an „visuellen Tokens“ (Visual Tokens) komprimiert; schließlich dekodiert das Sprachmodell den Text aus diesen visuellen Tokens.

Mit anderen Worten ermöglicht diese Technologie, dass das Modell **„durch das Betrachten von Bildern lesen“** kann, anstatt traditionell „buchstabieren“ zu müssen, was die Effizienz der Informationsverarbeitung stark erhöht.

Erstaunliche Leistung: 10-fache Kompression und Zukunftspotenzial

DeepSeek zeigt beeindruckende Kompressionsleistungen: Ein Artikel mit 1000 Wörtern wird nach der Kompression in ein Bild umgewandelt und benötigt nur 100 visuelle Tokens (eine 10-fache Kompression) zur Darstellung. Das Modell kann dabei noch 97 % des Originaltextes während der Dekompression wiederherstellen.

Diese bahnbrechende Leistung demonstriert nicht nur die Effektivität der „visuellen Gedächtniskompression“, sondern offenbart auch ihr großes Potenzial für die Zukunft der KI:

Lösung von Speicherbeschränkungen bei LLM: Es könnte zur Schlüsseltechnik für die Lösung der „Speicherbeschränkung“ bei großen Modellen werden und es der KI ermöglichen, mit weniger Rechenleistung **„hunderte Seiten“** umfassende, sehr lange Kontexte zu verarbeiten.

Zukünftige KI-Gedächtnis-Speicherung: In Zukunft könnten KI-Algorithmen alte Erinnerungen in Bilder umwandeln, um sie effizient zu archivieren.

Analogie zur menschlichen „Verlustrate“: Hochauflösende und niedrigdichte Erinnerungen

DeepSeek vergleicht dieses visuelle Kompressionsmechanismus mit der menschlichen **„Verlustrate“**, und simuliert geschickt den natürlichen Gedächtnis- und Vergessensprozess des Menschen:

Hochauflösende Erinnerungen: Der jüngste Kontext wird als hochauflösendes Bild gespeichert, also als hochwertige Information.

Niedrigdichte Erinnerungen: Ältere Kontexte werden in verschwommene Bilder komprimiert, also als niedrigdichte Informationen.