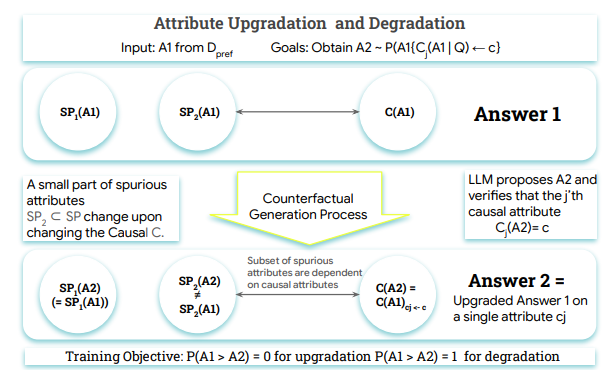

Una investigación del MIT ha revelado las asombrosas capacidades de los modelos lingüísticos grandes (LLM), incluyendo su habilidad para discernir entre afirmaciones verdaderas y falsas, y para cambiar sus "creencias". El estudio demuestra que los LLM poseen una clara inclinación hacia la verdad, y que los humanos incluso podrían manipular las "creencias" de un LLM mediante intervenciones neuronales, haciéndolo aceptar afirmaciones falsas o rechazar afirmaciones verdaderas.

Esta investigación proporciona una comprensión profunda de la comprensión y la veracidad de los modelos lingüísticos grandes, lo que tiene una importancia significativa.