Kürzlich hat Midjourney bekannt gegeben, dass es einen Videoupscaler sowie ein speziell für Anime-Stil konzipiertes Niji-Videomodell entwickelt. Dies hat weltweit Kreativem und AI-Technologiebegeisterten heftige Diskussionen ausgelöst. Die Redaktion von AIbase hat die neuesten Entwicklungen zusammengefasst und vertieft in die Potenzial und Zukunftsperspektiven dieser beiden bahnbrechenden Technologien eingegangen.

Midjourney Videoupscaler: Qualität steigern, Kreativität vergrößern

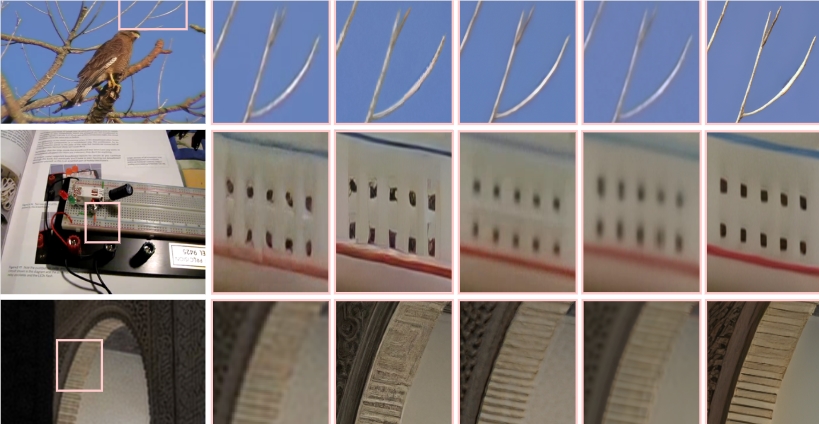

Der Videoupscaler von Midjourney zielt darauf ab, mit fortschrittlichen KI-Algorithmen niedrigauflösende Videos auf höhere Auflösung zu verbessern, wobei Details erhalten bleiben und visuelle Effekte verbessert werden. Ähnlich wie sein Bild-Upscaler-Tool (Upscale2x und 4x) wird der Videoupscaler erwartungsgemäß von Standard- bis HD-Auflösung und sogar bis 4K-Qualität verbessern, was Schaffenden eine bessere Auswahl an hoher Qualitätsoptionen bietet.

Nach öffentlichen Informationen kann die Bild-Upscaler-Technologie von Midjourney bereits 1024x1024 Pixel-Bilder auf 2048x2048 oder 4096x4096 Pixel hochstufen und durch "Subtle" und "Creative"-Modi das Erhalt von Details und die Erzeugung neuer Details balancieren. Der Videoupscaler könnte diese technologischen Vorteile fortführen und Probleme wie Pixelisierung oder Unschärfe nach dem Vergrößern von Videoinhalten lösen, insbesondere für Kurzmovies, Montagematerial und Film-Postproduktion geeignet sein.

Niji Videomodell: Das neue Zeitalter dynamischer Anime-Stile

Gleichzeitig arbeitet Midjourney an einem Niji-Videomodell, das sich auf die Generierung von animierter Inhalten im Anime-Stil spezialisiert. Das Niji-Modell hat seit seiner Einführung durch seine hervorragende Leistung bei der Erstellung von Anime-, Illustrations- und Cartoon-Bildern breite Anerkennung erfahren. Das im April 2023 veröffentlichte Niji5-Modell unterstützt Parameter wie "cute", "expressive" und "scenic", um Benutzern vielfältige Gestaltungsmöglichkeiten anzubieten.

Die Entwicklung des Niji-Videomodells markiert den Schritt von Midjourney von statischen Bildern zu dynamischen Videos in der Anime-Generierung. In Kombination mit dem bestehenden V1-Videomodell von Midjourney (das Bild-zu-Video-Generierung unterstützt und kurze Videoausschnitte von 5 bis 20 Sekunden pro Erstellung erzeugt), wird das Niji-Videomodell erwartungsgemäß die hohe Qualität der künstlerischen Stilistik fortführen, besonders geeignet für Anime-Kurzmovies, Charakteranimationen oder Spieltrailers. Nach Mitteilungen der Community kann das aktuelle V1-Videomodell bereits 24 fps, 480p-Videos erzeugen und unterstützt "hochdynamische" und "niedrigdynamische" Modi, um verschiedene Geschwindigkeitsrhythmen anzupassen. Das Niji-Videomodell könnte die Auflösung und Stil-Konsistenz weiter verbessern.

Technisches Kernstück und Ökosystemintegration

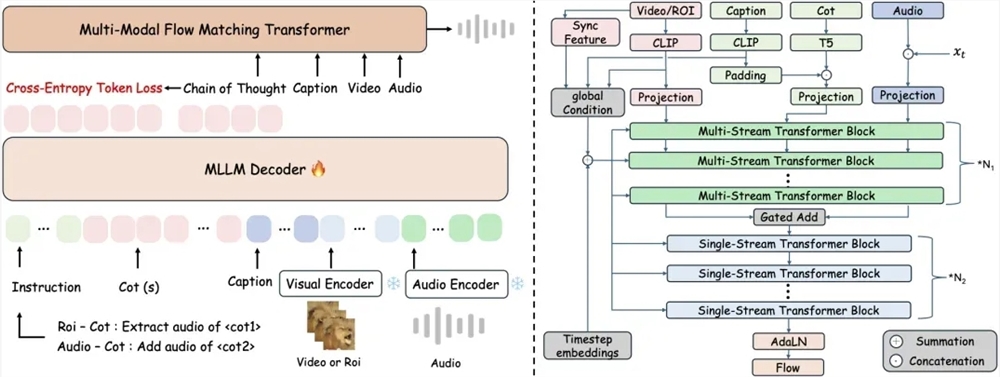

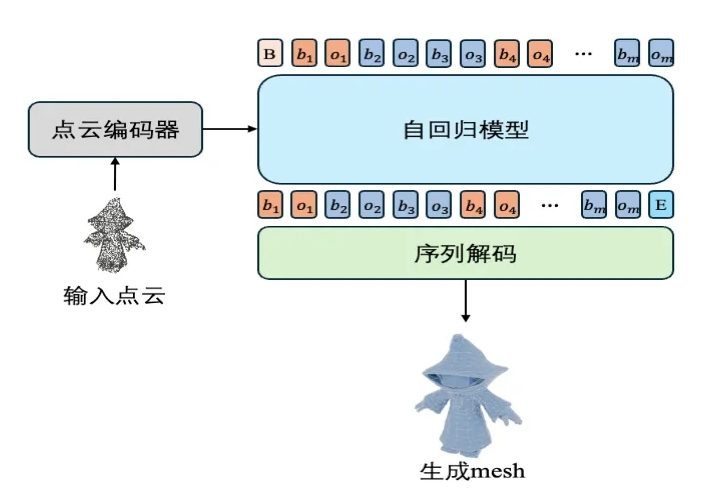

Sowohl der Videoupscaler als auch das Niji-Videomodell von Midjourney basieren auf ihrer starken AI-Architektur und GPU-Beschleunigungstechnologie. Der Videoupscaler könnte ähnliche Superauflösungs-Algorithmen wie Gigapixel AI verwenden, um realistischere Details mit tiefenschürfenden Lernen zu generieren und Texturen, Haare und Hintergründe zu optimieren. Das Niji-Videomodell könnte hingegen auf der V6-Architektur von Midjourney basieren und mit der Natürlichen Sprachverarbeitung (NLP) Technologie kombiniert werden, um präzisere Prompts für Kreation zu unterstützen.

Zu beachten ist, dass das Midjourney-Ekosystem bereits eine vollständige Kette von Text-zu-Bild-zu-Video integriert hat. Nutzer können zunächst über Text-Bilder generieren, diese dann in Videos umwandeln und die bald verfügbar kommenden UpScaler zur Optimierung der Ausgabequalität nutzen. Diese nahtlose Integration bietet Schaffenden eine End-to-End-Lösung von Idee bis Produkt.

Branchenbeeinflussung: Dynamisches Umfeld der Videoinhaltserstellung neu gestalten

Diese beiden Entwicklungen von Midjourney werden mehreren Branchen tiefgreifende Auswirkungen haben:

Kurzmovies und Social-Media: Der Videoupscaler könnte die Qualität von Benutzergenerierten Inhalten (UGC) verbessern und das visuelle Erlebnis der Plattform stärken; das Niji-Videomodell bietet Anime-Fans individuelle Gestaltungswerkzeuge.

Film und Werbung: Hohe-Qualitäts Anime-Videos und Upscaler-Technik werden die Produktionskosten senken und kleine und mittlere Unternehmen ermöglichen, professionelle Inhalte schnell zu produzieren.

Spielentwicklung: Das Niji-Videomodell könnte für die Generierung von Charakteranimationen oder Cutscenes verwendet werden und den Entwicklungsvorgang beschleunigen.

AIbase analysiert, dass die Videotechnologie von Midjourney mit Produkten wie Sora von OpenAI und Runway AI direkte Konkurrenz macht. Doch durch ihre einzigartige künstlerische Stilistik und kostengünstige Abonnementmodelle (das V1-Videomodell kostet nur 10 USD pro Monat) gibt sie den Schaffenden in der Gemeinschaft Vorteile.

Zukunftsaussichten: Richtung Echtzeit-Simulation

Der CEO von Midjourney, David Holz, hat gesagt, dass AI-Videomodelle ein wichtiges Schritt für die "Echtzeit-Open-World-Simulation" sind. Die Entwicklung von Videoupscaler und Niji-Videomodell ist nicht nur technische Fortschritte, sondern legt auch die Grundlage für zukünftige 3D-Entwicklung und Stil-Konsistenzoptimierung. Die Community erwartet, dass diese beiden Funktionen in den nächsten Monaten in den Teststadium kommen und schrittweise für Abonnenten verfügbar gemacht werden.

Fazit

Die Entwicklung von Videoupscaler und Niji-Videomodell von Midjourney zeigt die grenzenlose Möglichkeiten von AI im Bereich der dynamischen Inhaltsgenerierung. Von der Verbesserung der Qualität bis hin zur Anime-Videokreation bieten diese Technologien Schaffenden effizientere und künstlerisch anspruchsvollere Werkzeuge.