Die Zhejiang-Universität hat gemeinsam mit vivo eine revolutionäre Video-Virtual-Trying-On-Modellierungstechnologie namens MagicTryOn entwickelt, die durch ihre herausragende räumliche und zeitliche Konsistenz, die Detailtreue der Bekleidung sowie ihre Generalisierungsfähigkeit die Branche in Aufruhr versetzt hat. Diese innovative Technologie unterstützt nicht nur Bild- und Videoversuche, sondern kann auch bei komplexen Szenarien und starken Bewegungen überzeugende Bekleidungsergebnisse erzielen, was neue Möglichkeiten für E-Commerce, Mode und die Erstellung virtueller Inhalte eröffnet.

Weltweit erstes Modell: Video-Versuch anhand einer Diffusions-Transformer-Architektur

MagicTryOn verzichtet auf traditionelle U-Net-Architekturen und nutzt fortschrittliche Diffusions-Transformer (DiT)-Technologie, um das Ausdruckspotenzial des Modells deutlich zu verbessern. In Kombination mit dem vollständigen Aufmerksamkeitsmechanismus ermöglicht dieser Rahmen eine gemeinsame Modellierung von Video in räumlicher und zeitlicher Dimension, was sicherstellt, dass das Versuchsergebnis in dynamischen Szenarien flüssig und konsistent bleibt. Im Vergleich zu traditionellen Methoden vermeidet MagicTryOn effizient räumliche Unregelmäßigkeiten und Verluste an Bekleidungsdetails, wodurch das generierte Ergebnis filmstudienähnlich ist.

Unterstützung vielfältiger Versuchsszenarien, dynamische Darstellung beeindruckt

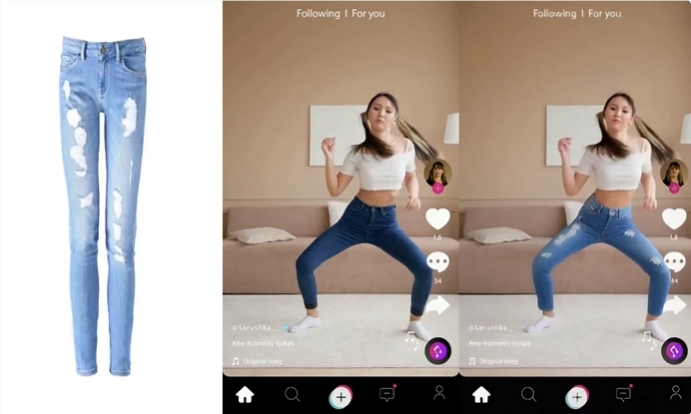

MagicTryOn unterstützt Bildversuche, Videoversuche und individuelle Versuchsansätze und eignet sich sowohl für statische als auch für dynamische Szenarien wie Tanzdarbietungen oder komplexe Hintergründe. Selbst bei starken Bewegungen oder komplizierten Kulissen bleibt die Bekleidung natürlich angepasst und realistisch dynamisch. Außerdem bietet seine starke Generalisierungsfähigkeit nicht nur menschliche Versuchsszenarien, sondern auch die Virtualisierung von Anziehen bei nicht-standardisierten Objekten wie Puppen, was kreative Inhalten neue Möglichkeiten eröffnet.

Neues Werkzeug für E-Commerce-Werbung: Detailtreue, hohe kommerzielle Wertschätzung

Durch eine raffinierte Strategie zur Erhaltung von Kleidungsdetails und Masken-basierte Optimierung der Verlustfunktion hat MagicTryOn die Treue von Bekleidungsmustern, Texturen und Konturen deutlich verbessert. Experimente zeigen, dass dieses Modell bei der Videosimulation virtueller Versuche (VVT) alle bestehenden Technologien übertreffen kann. Die generierten Videos wirken realistisch und stabil und sind direkt für Werbeaktionen im E-Commerce und Mode-Shows geeignet. Diese Technologie hat das Potenzial, physische Versuche und Produktrückgaben zu reduzieren, den Umweltschutz der Modeindustrie zu fördern und gleichzeitig das Online-Einkaufserlebnis der Verbraucher zu verbessern.

Open-Source-Lizenzierung, um Entwickler weltweit zu unterstützen

MagicTryOn wird unter der Apache2.0-Lizenz veröffentlicht und ist auf der Plattform Hugging Face verfügbar, wo Quellcode, vortrainierte Modelle und Gradio-Demos kostenlos ausprobiert und verwendet werden können. Dies zeigt nicht nur die Führung der Zhejiang-Universität und vivo in der Open-Source-Technologie, sondern sorgt auch für neue Impulse in Branchen wie E-Commerce, Virtual Reality und Content-Creation.

Die Veröffentlichung von MagicTryOn markiert einen neuen Höhepunkt in der Entwicklung der Videosimulation virtueller Versuche. Ihre Fortschritte in Bezug auf räumliche und zeitliche Konsistenz, Dynamikanpassung und Detailgenauigkeit setzen neue Maßstäbe für AI-gesteuerte Mode-Technologie. AIbase glaubt, dass MagicTryOn nicht nur den digitalen Umbau von E-Commerce und Mode vorantreiben wird, sondern auch tiefe Auswirkungen auf die Erstellung virtueller Inhalte und Metaverse-Anwendungen haben wird. Mit der weiteren Offenlegung technischer Details und der Mitwirkung der Community wird das Potenzial dieses Modells noch weiter entfaltet.

Projektadresse: https://github.com/vivoCameraResearch/Magic-TryOn/