Une récente étude de Google propose SpatialVLM, une solution pour pallier le manque de raisonnement spatial dans les modèles vision-langage. En s'inspirant des capacités de raisonnement spatial humain, les chercheurs ont conçu SpatialVLM pour lui permettre un raisonnement spatial direct et une pensée en chaîne.

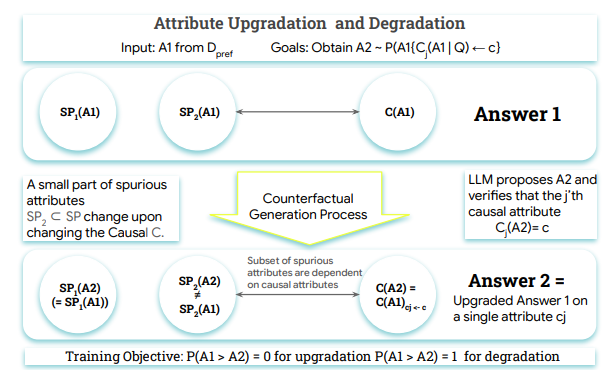

Les chercheurs ont utilisé des modèles de détection d'objets en vocabulaire ouvert, d'estimation de profondeur et de segmentation sémantique pour entraîner SpatialVLM, améliorant ainsi les performances du modèle sur les problèmes spatiaux et les estimations quantitatives. Un cadre complet de génération de données a été conçu pour extraire les informations des entités et générer un ensemble de données VQA spatial à grande échelle, permettant au modèle de réaliser un raisonnement spatial direct et une pensée en chaîne.

Cette recherche ouvre de nouvelles perspectives pour le développement des modèles vision-langage et représente une avancée significative dans le domaine de l'intelligence artificielle.